引言

在人工智能快速发展的今天,模拟人类行为和思维过程一直是研究人员追求的目标之一。generativeAgent_LLM项目为我们提供了一个强大的工具,让我们能够更接近这一目标。本文将深入探讨这个项目的特点、实现方式以及潜在应用。

项目概述

generativeAgent_LLM是一个基于《生成代理:人类行为的交互式模拟》论文的开源实现。该项目由GitHub用户QuangBK开发,旨在创建能够模拟人类行为和思维过程的智能代理。通过结合Guidance、Langchain和本地大型语言模型,该项目提供了一个灵活而强大的框架。

主要特性

generativeAgent_LLM项目支持以下核心功能:

- 本地LLM支持:能够使用本地部署的大型语言模型,提高隐私性和控制力。

- 记忆与检索:代理能够存储和检索过去的经验,模拟人类的记忆过程。

- 反思能力:代理可以对自身行为和经历进行反思,增强学习能力。

- 规划功能:虽然仍需改进,但代理已具备基本的规划能力。

- 反应与重新规划:能够根据环境变化做出反应并调整计划。

- 对话生成:可以生成自然的对话,尽管这一功能仍有提升空间。

- 代理总结:能够对代理的状态和特征进行概括总结。

- 访谈功能:支持对代理进行模拟访谈,了解其"想法"。

- Web UI:通过Gradio提供了友好的Web界面,方便用户交互。

技术实现

核心组件

generativeAgent_LLM项目主要依赖以下几个关键组件:

- Guidance:用于结构化语言模型的输出。

- Langchain:提供了构建基于语言模型的应用的框架。

- GPTQ-for-LLaMa:用于LLaMa模型的量化,提高效率。

- Faiss:用于高效的向量存储和检索。

安装与运行

要运行generativeAgent_LLM项目,需要按照以下步骤进行安装:

- 安装Guidance:

pip install guidance==0.0.63 - 安装GPTQ-for-LLaMa(使用oobabooga的分支)

- 安装Langchain:

pip install langchain==0.0.190 - 安装Faiss(用于向量存储)

项目推荐使用wizard-mega-13B-GPTQ模型,但用户也可以尝试其他兼容的模型。

深入功能解析

生成代理的定义

generativeAgent_LLM允许用户定义具有特定特征的代理。例如:

description = "Sam is a Ph.D student, his major is CS;Sam likes computer;Sam lives with his friend, Bob;Sam's farther is a doctor;Sam has a dog, named Max"

sam = GenerativeAgent(guidance=guidance,

name='Sam',

age=23,

des=description,

trails='funny, like football, play CSGO',

embeddings_model=embeddings_model)

这段代码创建了一个名为Sam的代理,具有特定的背景和特征。

记忆添加

代理可以通过添加观察来积累"记忆":

sam_observations = [

"Sam wake up in the morning",

"Sam feels tired because of playing games",

"Sam has a assignment of AI course",

"Sam see Max is sick",

"Bob say hello to Sam",

"Bob leave the room",

"Sam say goodbye to Bob",

]

sam.add_memories(sam_observations)

这些观察将成为代理的记忆,影响其后续的行为和决策。

代理总结

项目提供了获取代理总结的功能,可以快速了解代理的当前状态:

summary = sam.get_summary(force_refresh=True)

print(summary)

输出的总结包括代理的基本信息、主要特征和近期经历。

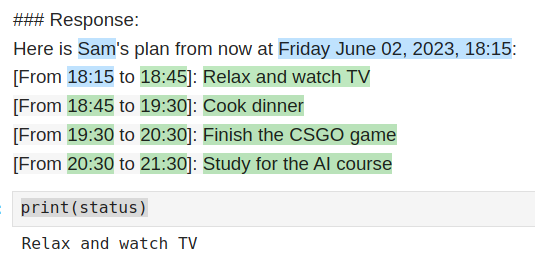

规划与状态更新

generativeAgent_LLM能够根据代理的当前状态和记忆进行规划:

status = sam.update_status()

这个功能模拟了人类根据当前情况制定计划的过程。

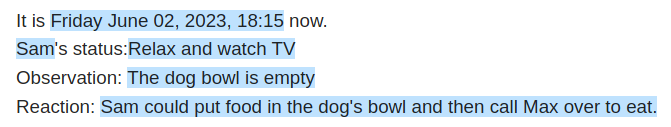

反应生成

代理能够对特定情况做出反应:

bool_react, reaction, context = sam.react(observation='The dog bowl is empty',

observed_entity='Dog bowl',

entity_status='The dog bowl is empty')

print(f"{bool_react}\nReaction: {reaction}\nContext: {context}")

这种反应功能模拟了人类根据环境变化调整行为的过程。

对话生成

项目还支持生成自然的对话:

bool_react, reaction, context = sam.react(observation='Bob come room with a new PC',

observed_entity=bob,

entity_status='Bob is setting up his new PC')

print(sam.dialogue_list[0])

这个功能可以用于模拟代理之间的交互,创造更真实的场景。

访谈功能

通过访谈功能,用户可以直接"询问"代理特定问题:

response = sam.interview('Friend', 'Who do you live with?')

print(response)

这为深入了解代理的"思维"提供了一种直接的方式。

应用前景

generativeAgent_LLM项目为多个领域提供了广阔的应用前景:

- 游戏开发:创建更真实、更有深度的NPC角色。

- 教育模拟:开发智能辅导系统,模拟不同学习场景。

- 社会科学研究:模拟复杂的社会互动和决策过程。

- 心理学研究:探索人类行为和认知过程的计算模型。

- 客户服务:开发更智能、更个性化的客服机器人。

- 创意写作:辅助作家创造丰富、连贯的角色和情节。

局限性与未来发展

尽管generativeAgent_LLM项目展现了巨大的潜力,但仍存在一些局限性:

- 计划功能需要进一步完善,以处理更复杂的场景。

- 对话生成的自然度和连贯性还有提升空间。

- 模型的伦理和偏见问题需要持续关注和改进。

未来,该项目可能会在以下方面继续发展:

- 增强跨域知识整合能力,使代理能够处理更广泛的话题。

- 改进长期记忆和知识累积机制,使代理能够持续学习和进化。

- 引入多模态输入,使代理能够理解和处理图像、音频等信息。

- 开发更复杂的多代理交互系统,模拟更真实的社会环境。

结论

generativeAgent_LLM项目为我们提供了一个强大的工具,让我们能够更接近模拟人类行为和思维过程的目标。通过结合先进的语言模型技术和精心设计的代理架构,该项目为人工智能研究和应用开辟了新的可能性。尽管仍有改进空间,但generativeAgent_LLM无疑是向着更智能、更自然的AI系统迈出的重要一步。

研究人员、开发者和AI爱好者都可以从这个项目中获得启发,并在此基础上进行further深入研究和创新应用。随着技术的不断进步,我们有理由期待在不远的将来,能够看到更加逼真、更加智能的生成代理系统的出现。