Gen.nvim: 让Neovim拥有AI助手的强大能力

在当今人工智能蓬勃发展的时代,如何将AI的能力无缝集成到开发工具中,成为了许多程序员关注的焦点。Gen.nvim作为一款创新的Neovim插件,为开发者提供了在编辑器中直接使用大语言模型(LLM)生成文本的能力,让Neovim拥有了AI助手的超强功能。本文将深入介绍Gen.nvim的特性、安装配置方法以及使用技巧,帮助读者充分发挥这一强大工具的潜力。

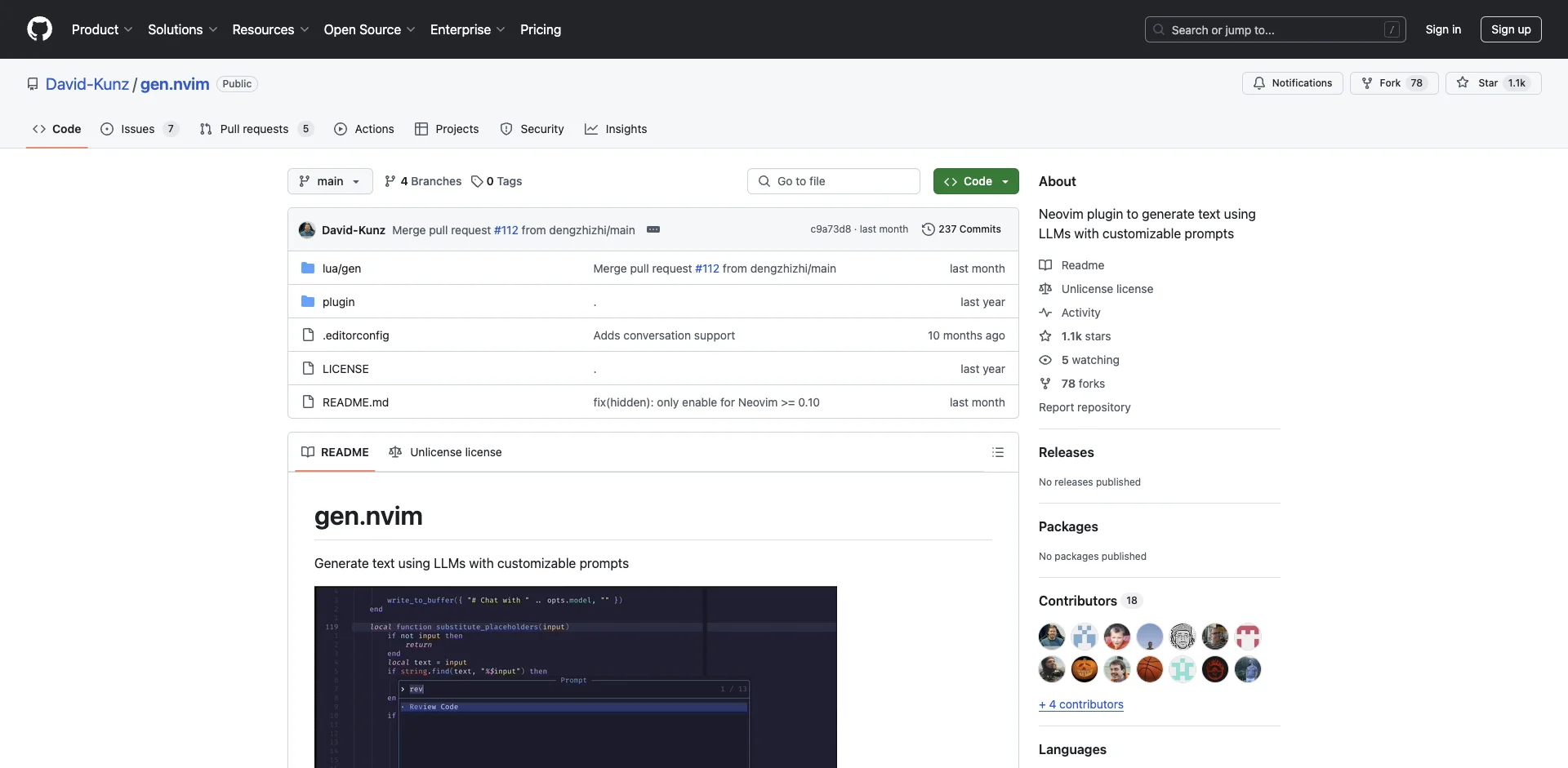

Gen.nvim简介

Gen.nvim是由David Kunz开发的一款开源Neovim插件,旨在让用户能够方便地在Neovim中使用大语言模型生成文本。它支持多种LLM模型,提供了丰富的自定义选项,可以满足不同场景下的文本生成需求。无论是代码补全、文档撰写,还是创意写作,Gen.nvim都能成为你得力的AI助手。

主要特性

-

支持多种LLM模型: Gen.nvim默认使用Mistral模型,同时也支持其他Ollama提供的模型,如llama3.1等。用户可以根据需求选择合适的模型。

-

自定义提示: 插件提供了一系列预定义的提示,同时允许用户自定义提示模板,以适应不同的使用场景。

-

灵活的显示模式: 支持浮动窗口、分割窗口等多种显示方式,让用户可以根据喜好选择最舒适的交互方式。

-

上下文感知: Gen.nvim能够保持对话上下文,允许用户进行连续的交互和提问。

-

集成Telescope: 可以与Telescope插件集成,提供更直观的模型和提示选择界面。

安装与配置

要使用Gen.nvim,首先需要安装Ollama和Curl。Ollama是一个强大的本地LLM运行时,而Curl则用于与Ollama服务进行通信。

安装Gen.nvim可以使用你喜欢的插件管理器。以下是使用lazy.nvim的安装示例:

{

"David-Kunz/gen.nvim",

opts = {

model = "mistral", -- 默认使用的模型

display_mode = "float", -- 显示模式,可选 "float" 或 "split"

show_prompt = false, -- 是否显示提交给Ollama的提示

show_model = false, -- 是否在对话开始时显示使用的模型

no_auto_close = false, -- 是否自动关闭窗口

init = function(options)

pcall(io.popen, "ollama serve > /dev/null 2>&1 &")

end,

-- 更多自定义选项...

}

}

使用方法

-

基本使用: 在Neovim中,可以使用":Gen"命令来启动Gen.nvim。这将打开一个交互窗口,你可以在其中输入提示或选择预定义的提示。

-

快捷键映射: 为了更方便地使用Gen.nvim,可以设置快捷键映射。例如:

vim.keymap.set({ 'n', 'v' }, '<leader>]', ':Gen<CR>') -

使用预定义提示: Gen.nvim提供了多种预定义提示,可以直接使用。例如:

vim.keymap.set('v', '<leader>]', ':Gen Enhance_Grammar_Spelling<CR>') -

自定义提示: 你可以根据需求自定义提示。例如:

require('gen').prompts['Elaborate_Text'] = { prompt = "Elaborate the following text:

$text", replace = true }

5. 模型选择:

可以使用以下命令选择不同的模型:

```lua

require('gen').select_model()

实用技巧

-

代码修复: 创建一个专门用于修复代码的提示:

require('gen').prompts['Fix_Code'] = { prompt = "Fix the following code. Only output the result in format ```$filetype\n...\n```:

$filetype\n$text\n",

replace = true,

extract = "$filetype\n(.-)"

}

2. 文档生成:

使用Gen.nvim快速生成代码文档:

```lua

require('gen').prompts['Generate_Docs'] = {

prompt = "Generate documentation for the following code:\n```$filetype\n$text\n```",

replace = false

}

-

创意写作助手: 设置一个提示来帮助突破写作瓶颈:

require('gen').prompts['Creative_Writing'] = { prompt = "Continue the following story with a creative twist:\n$text", replace = false } -

多语言翻译: 创建一个快速翻译的提示:

require('gen').prompts['Translate'] = { prompt = "Translate the following text to $input:\n$text", replace = true }

性能与隐私考虑

Gen.nvim默认使用本地运行的Ollama服务,这意味着所有的文本生成都在本地完成,无需将数据发送到云端。这不仅保护了用户的隐私,还能提供更快的响应速度。然而,本地运行也意味着对硬件有一定要求,特别是在使用较大模型时。

对于那些对性能要求不高或希望使用更强大模型的用户,Gen.nvim也提供了配置远程API的选项。这允许用户连接到更强大的服务器或云端API,以获得更好的生成效果。

未来展望

随着AI技术的不断发展,Gen.nvim也在持续更新和改进。未来可能会看到更多exciting的特性,如:

- 支持更多的LLM模型和API

- 更智能的上下文理解和代码分析

- 与其他Neovim插件的深度集成

- 更多针对特定编程语言和任务的优化

结语

Gen.nvim为Neovim用户带来了AI辅助编程的强大能力。通过简单的配置和使用,开发者可以在熟悉的编辑环境中享受AI带来的效率提升。无论是日常编码、文档写作,还是创意工作,Gen.nvim都能成为得力助手。

随着更多开发者加入到Gen.nvim的开发和使用中,相信这个项目会变得越来越强大,为Neovim社区带来更多惊喜。如果你是Neovim用户,不妨尝试一下Gen.nvim,感受AI为你的工作流程带来的革命性变化。

最后,欢迎有兴趣的开发者参与到Gen.nvim的开发中来。通过提交issue、贡献代码或分享使用经验,一起推动这个令人兴奋的项目不断前进!

🔗 相关链接: