iTransformer:时间序列预测的革命性突破

在人工智能领域,时间序列预测一直是一个具有挑战性的研究方向。近期,来自清华大学和蚂蚁集团的研究团队提出了一种名为iTransformer的创新模型,在多个具有挑战性的实际数据集上取得了卓越的表现,成为时间序列预测领域的新标杆。本文将深入探讨iTransformer的核心思想、技术创新以及其在实际应用中的潜力。

iTransformer的核心思想

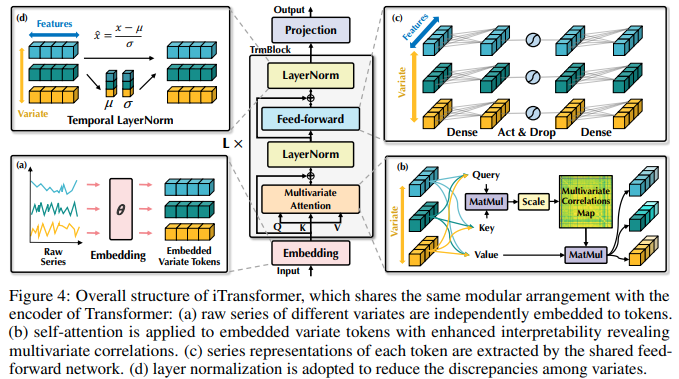

iTransformer的核心创新在于对传统Transformer架构的巧妙改造。传统的Transformer模型在处理时间序列数据时,通常将每个时间步的多个变量组合成一个时间token。然而,这种方法存在两个主要问题:

- 当需要处理较长的回溯窗口时,性能会显著下降,同时计算复杂度也会急剧上升。

- 将多个变量融合到一个token中可能导致无法学习到以变量为中心的表示,从而产生无意义的注意力图。

为了解决这些问题,iTransformer对Transformer的架构进行了颠覆性的改造:

- 将注意力机制和前馈网络应用于颠倒的维度上。

- 将每个变量的时间点嵌入到变量token中,利用注意力机制捕捉多变量之间的相关性。

- 对每个变量token应用前馈网络,学习非线性表示。

这种创新的架构设计使得iTransformer能够更好地处理长序列数据,同时保持了计算效率。

iTransformer的技术细节

iTransformer的实现涉及多个关键技术点:

-

维度颠倒: 不同于传统Transformer将时间步作为序列长度,iTransformer将变量数量作为序列长度。这种颠倒使得模型能够更好地处理多变量之间的关系。

-

可逆实例归一化: iTransformer采用了可逆实例归一化技术,这有助于解决分布偏移问题,提高模型在不同数据分布下的泛化能力。

-

灵活的预测长度: 模型支持多种预测长度,如12、24、36、48个时间步,满足不同应用场景的需求。

-

实验性设置:

- 支持将每个变量投影到多个token上,实现对时间的更细粒度注意力。

- 引入傅里叶token,将时间序列的FFT结果投影到独立的token中,与变量token一起参与注意力计算。

以下是iTransformer的基本使用示例:

import torch

from iTransformer import iTransformer

model = iTransformer(

num_variates = 137,

lookback_len = 96,

dim = 256,

depth = 6,

heads = 8,

dim_head = 64,

pred_length = (12, 24, 36, 48),

num_tokens_per_variate = 1,

use_reversible_instance_norm = True

)

time_series = torch.randn(2, 96, 137) # (batch, lookback len, variates)

preds = model(time_series)

iTransformer的应用前景

iTransformer在多个具有挑战性的实际数据集上取得了state-of-the-art的表现,展现出广阔的应用前景:

-

金融市场预测: 可用于股票价格、汇率等金融时间序列的预测,为投资决策提供支持。

-

能源需求预测: 在电力、石油等能源领域,iTransformer可用于预测未来的能源需求,优化资源分配。

-

气象预报: 利用多变量时间序列数据,提高天气预报的准确性和时效性。

-

工业生产优化: 在制造业中,iTransformer可用于预测设备性能、产品质量等关键指标,实现生产流程的优化。

-

交通流量预测: 帮助城市交通管理部门预测未来的交通流量,实现智能化的交通调度。

未来研究方向

尽管iTransformer已经展现出强大的性能,但仍有多个值得探索的研究方向:

- 进一步增强Transformer架构,融入最新的研究成果。

- 开发跨变量和时间的二维版本,以捕捉更复杂的时空关系。

- 探索将自适应归一化技术与所有变量的统计信息相结合的方法。

- 研究如何将iTransformer与其他深度学习技术(如图神经网络)结合,以处理更复杂的时序数据结构。

结论

iTransformer的出现为时间序列预测领域带来了新的突破。通过巧妙地颠倒Transformer的架构,iTransformer不仅提高了预测性能,还增强了模型对不同变量的泛化能力,以及对任意回溯窗口的利用效率。随着进一步的研究和优化,iTransformer有望成为时间序列预测的基础骨架,为各行各业的预测任务提供强大支持。

作为一个开源项目,iTransformer也为研究人员和开发者提供了宝贵的学习和实验平台。我们期待看到更多基于iTransformer的创新应用和改进方案,共同推动时间序列预测技术的发展。