MelNet简介

MelNet是一种在频域生成音频的神经网络模型,由Prafulla Dhariwal等人在2019年提出。与直接建模时域波形的传统方法不同,MelNet旨在建模音频信号的频率内容,可以用于无条件音频生成(如音乐生成)和条件音频生成(如文本到语音)等任务。

论文资源

代码实现

- Deepest-Project/MelNet - PyTorch实现

- 支持无条件和条件音频生成

- 包含模型训练和采样代码

音频样本

- MelNet音频样本 - 包含以下类型的生成样本:

- 单说话人语音生成

- 多说话人语音生成

- 音乐生成

- 单说话人文本到语音

- 多说话人文本到语音

模型细节

MelNet的一些关键特性包括:

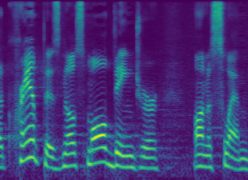

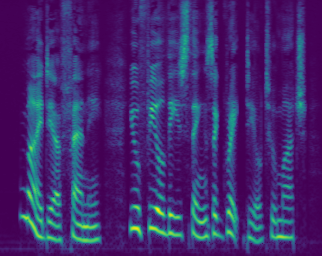

- 使用梅尔频谱图作为音频表示

- 多尺度自回归建模

- 条件生成时使用注意力机制对齐文本和音频

学习资源

- MelNet项目介绍 - 包含模型详细介绍和可视化

- MelNet代码使用说明 - 如何训练和采样

- MelNet相关讨论 - GitHub issues中的问题解答

总结

MelNet作为一种新的频域音频生成模型,在音乐生成和语音合成等任务上展现出了很好的效果。本文汇总的资源可以帮助读者快速上手学习这一模型,欢迎大家探索MelNet的更多潜力! 🎵🎤