TorchExplorer: 开启神经网络内部的探索之旅

在深度学习的世界里,神经网络模型就像一个黑盒子,其内部运作机制往往难以捉摸。为了揭开这个黑盒子的神秘面纱,一款名为TorchExplorer的新工具应运而生,它为研究人员提供了一个交互式的窗口,让我们得以一窥神经网络的内部世界。

什么是TorchExplorer?

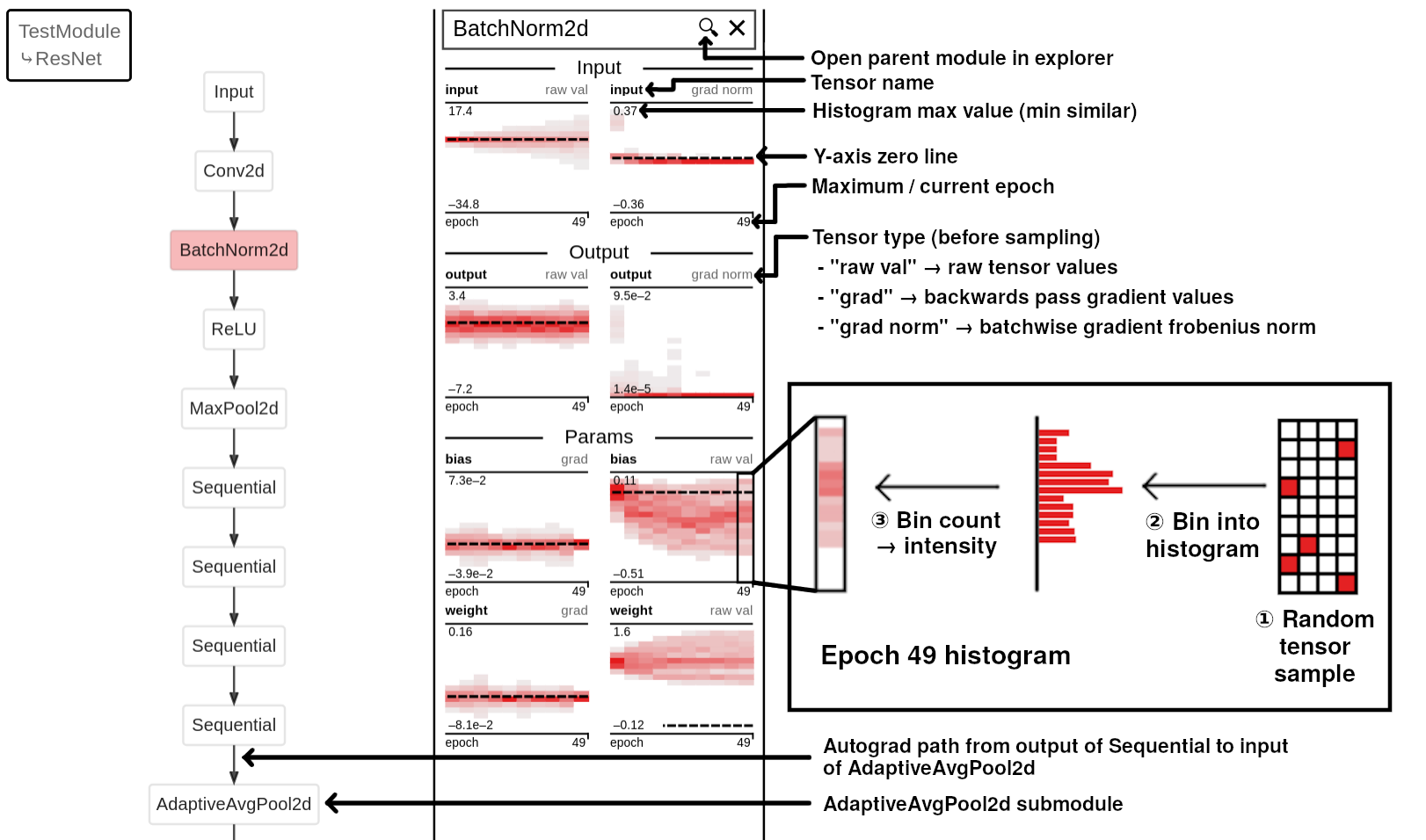

TorchExplorer是一个为PyTorch设计的可视化工具,它允许用户在训练过程中实时检查神经网络中每个nn.Module的输入、输出、参数和梯度。这个工具不仅可以与流行的实验跟踪平台Weights & Biases集成,还可以作为独立解决方案在本地运行。

TorchExplorer的主要特性

-

交互式模型结构可视化: TorchExplorer自动从autograd图中提取模块级图,展示网络的整体结构。用户可以通过点击来展开子模块,深入了解网络的每一层。

-

实时参数与梯度监控: 工具可以捕获并展示模型在训练过程中的输入/输出张量、参数值以及相应的梯度。这些信息以直观的直方图形式呈现,帮助用户快速识别潜在的问题。

-

灵活的使用方式: TorchExplorer可以与Weights & Biases集成,也可以作为独立工具使用。只需几行代码就可以将其添加到现有的训练脚本中。

-

中间张量可视化: 除了自动捕获模块的输入/输出外,用户还可以使用

torchexplorer.attach函数来记录和可视化任意中间张量。

如何使用TorchExplorer

使用TorchExplorer非常简单,只需在你的训练代码中添加几行:

import torchexplorer

# 如果使用wandb,在wandb.init()之前调用

torchexplorer.setup()

model = ... # 你的模型

# 开始监控模型

torchexplorer.watch(model, backend='wandb') # 或者使用'standalone'

# 训练循环...

TorchExplorer的应用场景

TorchExplorer的设计初衷是成为一个通用工具,帮助研究人员了解网络内部发生的情况。它的一些潜在用途包括:

- 检查模型是否存在梯度消失/爆炸问题

- 观察特定模块的输入分布,判断是否需要添加归一化层

- 捕获使用不当的激活函数等常见错误

- 分析多个子模块的梯度流向,了解它们的相对重要性

- 对于多输入模块,通过梯度范数比较各输入的重要程度

- 确保潜在空间/嵌入分布的健康状态

- 使用

torchexplorer.attach功能分析跳跃连接与主网络路径的梯度流向

TorchExplorer的用户界面

TorchExplorer的界面主要分为两部分:

-

左侧探索面板: 展示网络的模块级图。用户可以点击模块来查看其内部结构,也可以通过顶部的导航栏返回上层模块。

-

右侧直方图面板: 用户可以将感兴趣的模块拖放到右侧列中,查看详细的参数和梯度信息。每个直方图都展示了随时间变化的数据分布。

TorchExplorer的优势

-

直观可视化: 通过交互式图形界面,TorchExplorer使复杂的神经网络结构变得一目了然。

-

实时监控: 在训练过程中实时更新参数和梯度信息,帮助及时发现潜在问题。

-

灵活性: 支持多种使用方式,可以轻松集成到现有的工作流程中。

-

深入分析: 提供了丰富的工具来分析网络的内部状态,有助于深入理解模型行为。

结语

TorchExplorer为深度学习研究人员和工程师提供了一个强大的工具,让我们能够更好地理解和调试复杂的神经网络模型。通过直观的可视化和实时监控,它帮助我们揭示了神经网络这个"黑盒子"的内部运作机制。无论你是在设计新的网络架构,还是优化现有模型,TorchExplorer都能成为你的得力助手,为你的深度学习之旅提供新的洞察和可能性。

随着深度学习技术的不断发展,像TorchExplorer这样的工具将发挥越来越重要的作用,帮助我们构建更高效、更可解释的AI模型。让我们一起探索神经网络的奥秘,推动人工智能技术的进步!