Keras-TCN:强大而灵活的时序卷积网络

在深度学习领域,处理时间序列数据一直是一个具有挑战性的任务。传统上,人们通常使用循环神经网络(RNN)如LSTM或GRU来处理这类问题。然而,近年来一种新的网络结构——时序卷积网络(Temporal Convolutional Network, TCN)在多个序列建模任务中展现出了优异的性能。Keras-TCN正是这种网络结构在Keras框架下的一个强大实现。

TCN的优势

相比传统的RNN结构,TCN具有以下几个显著优势:

-

更长的有效记忆:TCN能够捕捉更长距离的时间依赖关系,这在处理长序列时非常有用。

-

并行计算:由于采用了卷积结构,TCN可以充分利用GPU进行并行计算,训练速度更快。

-

灵活的感受野:通过调整卷积核大小和扩张率,可以灵活控制网络的感受野大小。

-

梯度稳定:避免了RNN中常见的梯度消失/爆炸问题,有利于训练更深的网络。

-

固定长度的输入输出:这使得TCN在某些应用场景下更加方便。

Keras-TCN的核心特性

Keras-TCN是由Philippe Remy开发的开源项目,它将TCN的强大功能完美集成到了Keras框架中。主要特性包括:

- 支持因果(causal)和非因果卷积

- 残差连接

- 权重归一化

- 灵活的扩张卷积设置

- 支持skip connections

- 易于集成到现有Keras模型中

安装与使用

Keras-TCN的安装非常简单,只需通过pip进行安装:

pip install keras-tcn

对于MacOS M1用户,可能需要使用以下命令:

pip install --no-binary keras-tcn keras-tcn

使用Keras-TCN构建模型也非常直观,以下是一个简单的示例:

from tensorflow.keras.models import Input, Model

from tensorflow.keras.layers import Dense

from tcn import TCN

input_layer = Input(shape=(timesteps, input_dim))

tcn_layer = TCN(nb_filters=64, kernel_size=3, dilations=[1, 2, 4, 8, 16, 32])(input_layer)

output_layer = Dense(1)(tcn_layer)

model = Model(inputs=[input_layer], outputs=[output_layer])

TCN层的关键参数

在使用TCN层时,有几个关键参数需要特别关注:

-

nb_filters: 卷积层中使用的滤波器数量,类似于LSTM中的单元数。 -

kernel_size: 卷积核的大小,通常在2到8之间。 -

dilations: 扩张率列表,控制TCN的深度和感受野大小。 -

padding: 可选'causal'(因果)或'same'(非因果)。 -

use_skip_connections: 是否使用跳跃连接。 -

dropout_rate: Dropout比率,用于正则化。 -

return_sequences: 是否返回完整序列或仅返回最后一个时间步的输出。

实际应用案例

Keras-TCN在多个序列建模任务中展现出了优异的性能,包括但不限于:

-

语言建模:在WordPTB任务中,TCN的表现优于LSTM。

-

加法任务:给定一个长数组和一个布尔数组,TCN能够准确地找到并相加指定的两个数字。

-

复制内存任务:TCN能够有效地学习复制长序列中的特定部分。

-

序列MNIST:将MNIST图像视为一维序列,TCN能够准确地进行分类。

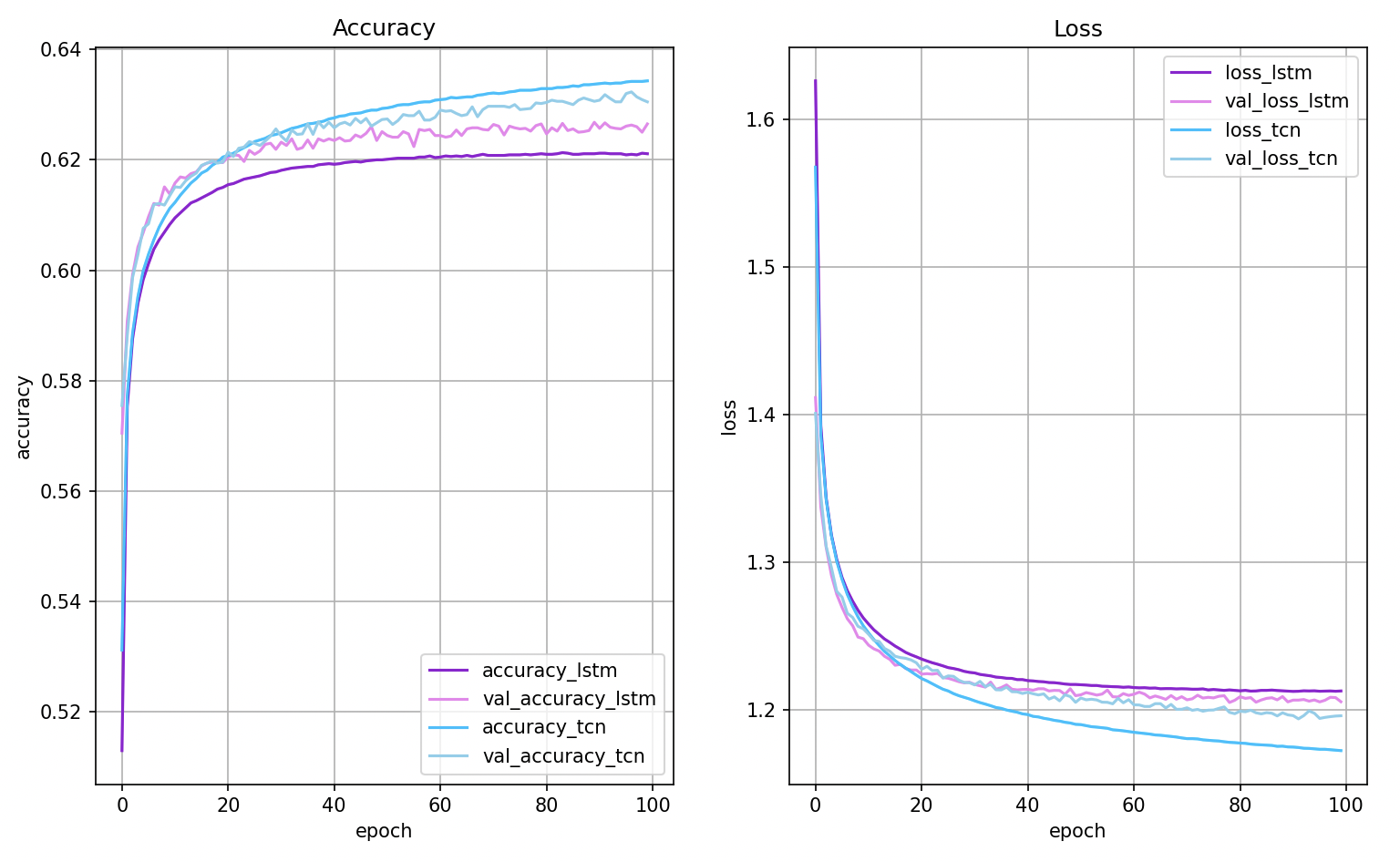

TCN与LSTM在WordPTB任务上的性能对比

调优技巧

在使用Keras-TCN时,以下几点调优技巧可能会有所帮助:

-

感受野大小:确保TCN的感受野大于或等于输入序列的最大长度。

-

扩张率设置:通常使用2的幂次方作为扩张率,如[1, 2, 4, 8, 16, 32]。

-

归一化:对于大型网络,考虑使用层归一化(layer normalization)。

-

跳跃连接:除非性能下降,否则建议启用跳跃连接。

-

Dropout:对于大型数据集,可以尝试使用dropout进行正则化。

结语

Keras-TCN为处理时间序列数据提供了一个强大而灵活的工具。它结合了TCN的优势和Keras的易用性,使得构建高性能的序列模型变得前所未有的简单。无论是在自然语言处理、时间序列预测还是其他序列建模任务中,Keras-TCN都是一个值得尝试的选择。

随着深度学习技术的不断发展,像Keras-TCN这样的工具将继续推动时间序列分析领域的创新。我们期待看到更多基于TCN的突破性应用在各个领域涌现。

参考资源

- Keras-TCN GitHub仓库: https://github.com/philipperemy/keras-tcn

- TCN原理论文: An Empirical Evaluation of Generic Convolutional and Recurrent Networks for Sequence Modeling

- Wavenet论文: WaveNet: A Generative Model for Raw Audio

通过深入学习和实践Keras-TCN,相信你将能够更好地应对各种复杂的序列建模任务,为你的深度学习项目增添新的维度和可能性。