| 1. 使用LoRA和Hugging Face高效训练大型语言模型 | 使用LoRA和Hugging Face高效训练大型语言模型的详细信息和代码。 |  |

| 2. 在Colab笔记本中微调您自己的Llama 2模型 | 在Colab中微调您自己的Llama 2模型的指南。 |  |

| 3. 使用LLaMA-7B模型的Guanaco聊天机器人演示 | 展示由LLaMA-7B模型支持的聊天机器人演示。 |  |

| 4. PEFT微调-Bloom-560m-tagger | PEFT微调-Bloom-560m-tagger的项目详情。 |  |

| 5. 微调Meta_OPT-6-1b_Model_bnb_peft | 使用PEFT和Bloom-560m-tagger微调Meta OPT-6-1b模型的详细信息和指南。 |  |

| 6.使用BNB自监督训练微调Falcon-7b | 使用BNB自监督训练微调Falcon-7b的指南。 |  |

| 7.使用QLoRa微调LLaMa2 | 使用PEFT库和QLoRa方法微调Llama 2 7B预训练模型的指南。 |  |

| 8.在Colab中稳定微调Vicuna13B_8bit | 微调Vecuna 13B_8bit的指南。 |  |

| 9. GPT-Neo-X-20B-bnb2bit训练 | 使用bfloat16精度训练GPT-NeoX-20B模型的指南。 |  |

| 10. MPT-Instruct-30B模型训练 | MPT-Instruct-30B是MosaicML的一种大型语言模型,训练于短篇指令数据集上。它可用于遵循指令、回答问题和生成文本。 |  |

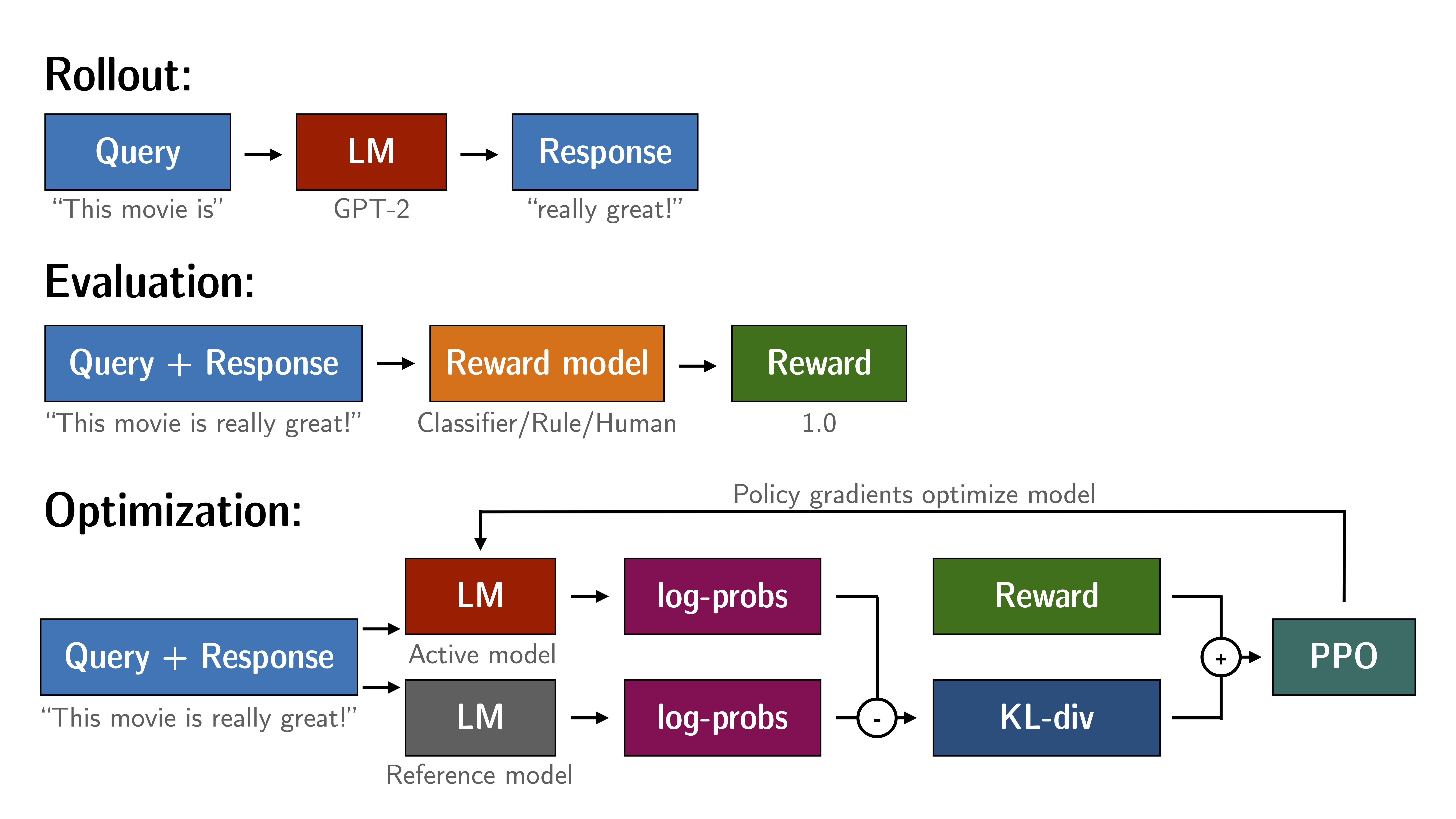

| 11.任何模型的自定义数据集RLHF训练 | 如何使用RLHF训练在任何LLM模型上使用自定义数据集进行训练的指南。 |  |

| 12.在自定义数据集(dialogstudio)上微调Microsoft Phi 1.5b | 如何使用trl SFT训练在自定义数据集上微调Microsoft Phi 1.5模型的指南。 |  |

| 13. 微调 OpenAI GPT3.5 Turbo | 如何在自己的数据上微调 GPT 3.5 |  |

| 14. 使用 Autotrain-advanced 微调 Mistral-7b 模型 | 如何使用 autotrained-advanced 微调 Mistral-7b |  |

| 15. RAG LangChain 教程 | 如何使用 LangChain 进行 RAG |  |

| 16. 使用 LangChain 进行知识图谱 LLM 与 PDF 问答 | 如何通过 PDF 问答构建知识图谱 |  |

| 17. 使用 OpenAI 功能与 Neo4j 和 Langchain Agent 进行文本到知识图谱转换及问答 | 如何从文本或 PDF 文档中构建知识图谱,并通过 PDF 问答实现 |  |

| 18. 使用 Langchain 和 OpenAI 将文档转换为知识图谱 | 本笔记帮助你了解如何通过最简单的方法将任意文档转换为知识图谱,用于下一个基于 RAG 的应用程序 |  |

| 19. 如何使用 LLM 训练 1-bit 模型? | 本笔记帮助你使用 hqq 框架通过 1-bit 和 2-bit 量化方法训练模型 |  |

| 20. Alpaca_+_Gemma2_9b_Unsloth_2x_faster_finetuning | 本笔记帮助你使用 Gemma2 9b 进行模型训练 |  |

| 21. 使用 MLFLOW 评估 RAG 管道的最佳行业实践 | 本笔记提供了使用 MLFLOW 评估 21 个 RAG(检索-再回答生成)管道的综合指南,遵循最佳行业实践。 |  |

22. 使用 mlflow.evaluate() 评估 Hugging Face LLM | 本笔记提供了使用 mlflow_evaluate 评估 Hugging Face 语言学习模型 (LLM) 的综合指南。 |  |