MAP-NEO:一个完全开源的大型语言模型

MAP-NEO是一个完全开源的大型语言模型,包括预训练数据、数据处理流程(Matrix)、预训练脚本和对齐代码。它在4.5T英文和中文令牌上从头训练,展现出与LLaMA2 7B相当的性能。MAP-Neo模型在推理、数学和编码等具有挑战性的任务中表现出与专有模型相当的性能,优于同等规模的同类模型。出于研究目的,我们旨在实现LLM训练过程的完全透明。为此,我们全面发布了MAP-Neo,包括最终和中间检查点、自训练的分词器、预训练语料库以及高效、稳定的优化预训练代码库。

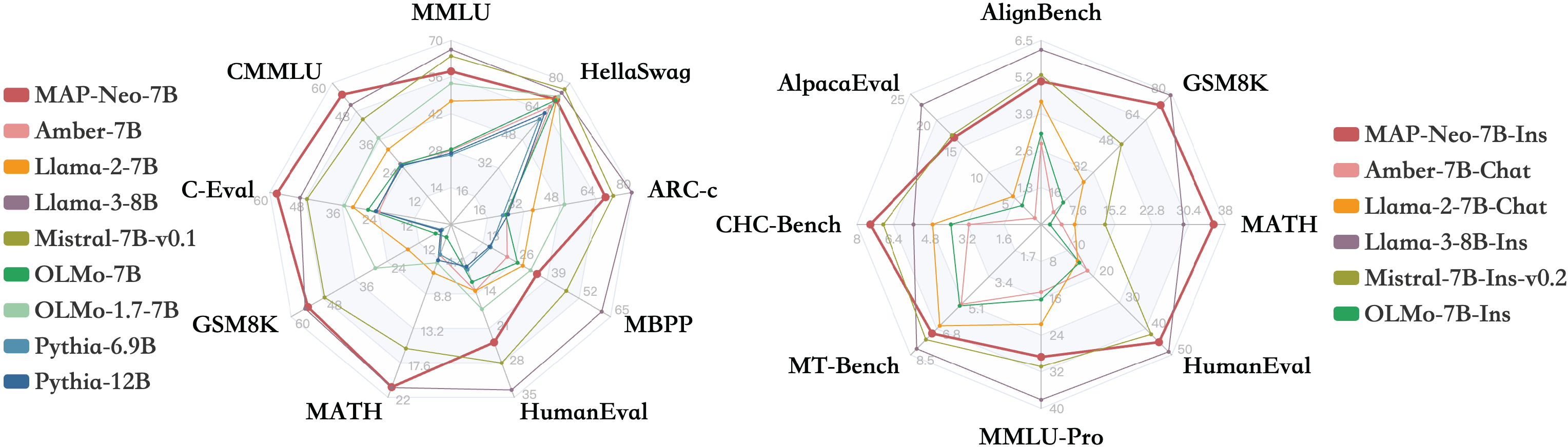

评估结果

MAP-NEO 7B系列

我们在各种基准测试上评估了MAP-Neo 7B系列和其他类似规模的模型,如下所示。

有关不同基准测试性能的更多详细信息,请参阅https://map-neo.github.io/。

模型和数据下载

我们很高兴宣布公开发布MAP-NEO 7B,包括基础模型和一系列中间检查点。此次发布旨在支持学术和商业社区内更广泛、更多样化的研究。请注意,本模型的使用受许可证部分中概述的条款约束。在这些条款下允许商业使用。

Huggingface

| 模型和数据集 | 下载 |

|---|---|

| MAP-NEO 7B 基础 | 🤗 HuggingFace |

| MAP-NEO 7B 指令 | 🤗 HuggingFace |

| MAP-NEO 7B SFT | 🤗 HuggingFace |

| MAP-NEO 7B 中间 | 🤗 HuggingFace |

| MAP-NEO 7B 衰减 | 🤗 HuggingFace |

| MAP-NEO 2B 基础 | 🤗 HuggingFace |

| MAP-NEO 缩放律 980M | 🤗 HuggingFace |

| MAP-NEO 缩放律 460M | 🤗 HuggingFace |

| MAP-NEO 缩放律 250M | 🤗 HuggingFace |

| MAP-NEO 数据 Matrix | 🤗 HuggingFace |

许可证

此代码仓库根据MIT许可证授权。

引用

@article{zhang2024mapneo,

title = {MAP-Neo: Highly Capable and Transparent Bilingual Large Language Model Series},

author = {Ge Zhang and Scott Qu and Jiaheng Liu and Chenchen Zhang and Chenghua Lin and Chou Leuang Yu and Danny Pan and Esther Cheng and Jie Liu and Qunshu Lin and Raven Yuan and Tuney Zheng and Wei Pang and Xinrun Du and Yiming Liang and Yinghao Ma and Yizhi Li and Ziyang Ma and Bill Lin and Emmanouil Benetos and Huan Yang and Junting Zhou and Kaijing Ma and Minghao Liu and Morry Niu and Noah Wang and Quehry Que and Ruibo Liu and Sine Liu and Shawn Guo and Soren Gao and Wangchunshu Zhou and Xinyue Zhang and Yizhi Zhou and Yubo Wang and Yuelin Bai and Yuhan Zhang and Yuxiang Zhang and Zenith Wang and Zhenzhu Yang and Zijian Zhao and Jiajun Zhang and Wanli Ouyang and Wenhao Huang and Wenhu Chen},

year = {2024},

journal = {arXiv preprint arXiv: 2405.19327}

}

联系方式

如需进一步交流,请扫描以下微信和Discord二维码:

| 微信 | Discord |

|  |

访问官网

访问官网 Github

Github Huggingface

Huggingface 论文

论文