Xorbits Inference(简称 Xinference)是一款强大且多功能的库,旨在服务于语言、语音识别和多模态模型。借助 Xorbits Inference,您可以轻松使用单个命令部署和服务您的模型或最新的内置模型。无论您是研究人员、开发者还是数据科学家,Xorbits Inference 都能帮助您释放最前沿 AI 模型的全部潜力。

🔥 热门话题

框架增强

- 支持 Transformers 引擎的连续批处理:#1724

- 支持 Apple Silicon 芯片的 MLX 后端:#1765

- 支持指定工作线程和 GPU 索引启动模型:#1195

- 支持 SGLang 后端:#1161

- 支持 LLM 和图像模型的 LoRA:#1080

- 支持语音识别模型:#929

- 支持指标:#906

新模型

- 内置支持 CogVideoX:#2049

- 内置支持 flux.1-schnell & flux.1-dev:#2007

- 内置支持 MiniCPM-V 2.6:#2031

- 内置支持 Kolors:#2028

- 内置支持 SenseVoice:#2008

- 内置支持 Mistral Large 2:#1944

- 内置支持 llama3.1:#1932

- 内置支持 Mistral Nemo:#1936

集成

- Dify:一个 LLMOps 平台,使开发人员(甚至非开发人员)能够快速构建基于大型语言模型的实用应用程序,确保它们是可视化的、可操作的和可改进的。

- FastGPT:一个基于 LLM 的知识平台,提供现成的数据处理和模型调用功能,允许通过 Flow 可视化进行工作流编排。

- Chatbox:一个适用于多个最新 LLM 模型的桌面客户端,适用于 Windows、Mac 和 Linux。

- RAGFlow:一个基于深度文档理解的开源 RAG 引擎。

主要特点

🌟 模型服务变得简单:简化大型语言、语音识别和多模态模型的服务过程。您可以通过一个命令来设置和部署您的模型,用于实验和生产。

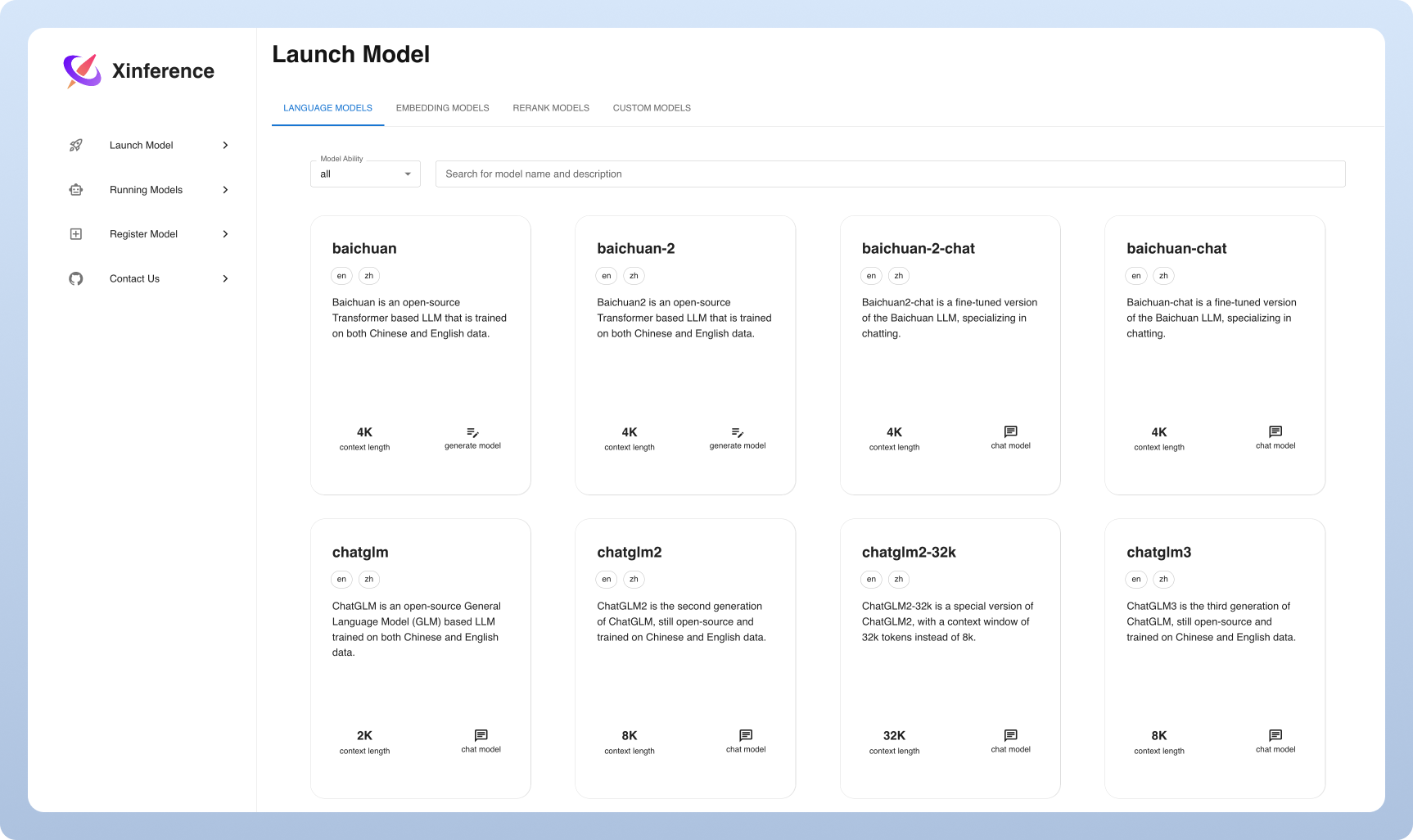

⚡️ 最先进的模型:通过一个命令使用最新的内置模型进行实验。Inference 提供访问最先进的开源模型!

🖥 异构硬件的利用:使用 ggml 充分利用您的硬件资源。Xorbits Inference 智能地使用异构硬件,包括 GPU 和 CPU,加速您的模型推理任务。

⚙️ 灵活的 API 和接口:提供多种接口与您的模型进行交互,支持兼容 OpenAI 的 RESTful API(包括函数调用 API)、RPC、CLI 和 WebUI 进行无缝的模型管理和交互。

🌐 分布式部署:在分布式部署场景中表现出色,允许将模型推理无缝分布到多个设备或机器上。

🔌 与第三方库的内置集成:Xorbits Inference 与流行的第三方库无缝集成,包括 LangChain、LlamaIndex、Dify 和 Chatbox。

为什么选择 Xinference

| 功能 | Xinference | FastChat | OpenLLM | RayLLM |

|---|---|---|---|---|

| OpenAI兼容的 RESTful API | ✅ | ✅ | ✅ | ✅ |

| vLLM 集成 | ✅ | ✅ | ✅ | ✅ |

| 更多推理引擎(GGML, TensorRT) | ✅ | ❌ | ✅ | ✅ |

| 更多平台(CPU, Metal) | ✅ | ✅ | ❌ | ❌ |

| 多节点集群部署 | ✅ | ❌ | ❌ | ✅ |

| 图像模型(文字到图像) | ✅ | ✅ | ❌ | ❌ |

| 文本嵌入模型 | ✅ | ❌ | ❌ | ❌ |

| 多模态模型 | ✅ | ❌ | ❌ | ❌ |

| 音频模型 | ✅ | ❌ | ❌ | ❌ |

| 更多OpenAI功能(函数调用) | ✅ | ❌ | ❌ | ❌ |

入门指南

请在开始之前为我们加星,这样您就能立即收到 GitHub 上每次新发布的通知!

Jupyter Notebook

体验 Xinference 的最轻量方法是试用我们的 Google Colab 上的 Jupyter Notebook。

Docker

Nvidia GPU 用户可以使用 Xinference Docker 镜像 启动 Xinference 服务器。在执行安装命令之前,请确保您的系统上已设置 Docker 和 CUDA。

docker run --name xinference -d -p 9997:9997 -e XINFERENCE_HOME=/data -v </on/your/host>:/data --gpus all xprobe/xinference:latest xinference-local -H 0.0.0.0

通过 helm 安装到 K8s

确保您的 Kubernetes 集群中有 GPU 支持,然后按如下步骤安装。

# 添加仓库

helm repo add xinference https://xorbitsai.github.io/xinference-helm-charts

# 更新索引并查询 xinference 版本

helm repo update xinference

helm search repo xinference/xinference --devel --versions

# 安装 xinference

helm install xinference xinference/xinference -n xinference --version 0.0.1-v<xinference_release_version>

有关 K8s 上更自定义的安装方法,请参阅 文档。

快速开始

请按如下所示使用 pip 安装 Xinference。(有关更多选项,请参阅 安装页面。)

pip install "xinference[all]"

要启动本地 Xinference 实例,请运行以下命令:

$ xinference-local

一旦 Xinference 运行起来,您可以通过多种方式试用它:通过 web UI,cURL,命令行,或者通过 Xinference 的 python 客户端。请查看我们的 文档 查阅指南。

参与

| 平台 | 目的 |

|---|---|

| Github Issues | 报告错误和提交功能请求。 |

| Slack | 与其他 Xorbits 用户合作。 |

| 获取新功能的最新信息。 |

贡献者