因果实验室

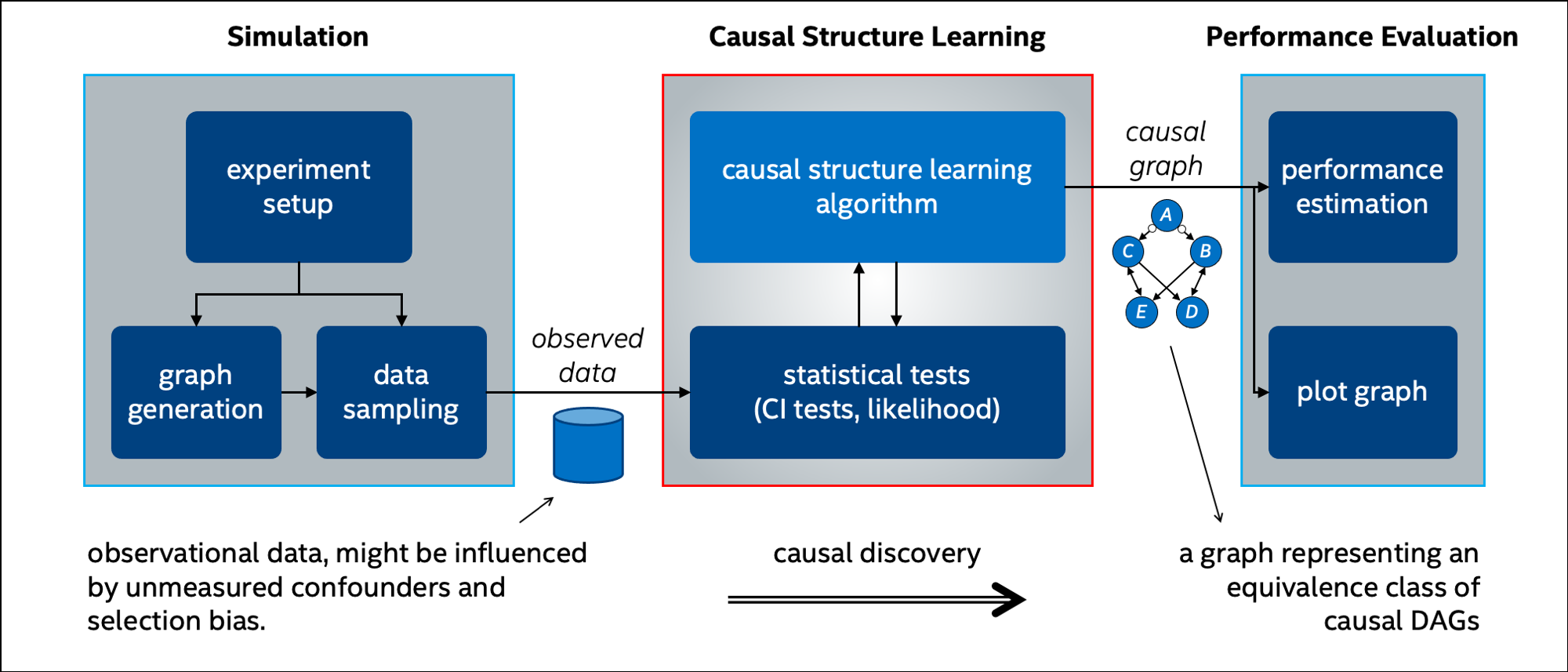

该代码库包含了英特尔实验室开发的新型因果发现算法的研究代码,以及其他常见算法,还有用于开发和检验因果结构学习新算法的类。

更新(2023年12月):CLEANN是在NeurIPS 2023上提出的新算法。它为现有预训练的Transformer神经网络的输出结果生成因果解释。其核心基于论文中提出的自注意力的新型因果解释,并执行基于注意力的因果发现(ABCD)。 这个笔记本通过一个简单的例子演示了如何使用CLEANN。

目录

算法和基线

包含的算法从观测数据中学习因果结构,并使用这些学习到的因果图进行推理。 有三类算法:

-

在因果充分性和贝叶斯网络结构学习下的因果发现

- PC算法(Spirtes等人,2000)

- RAI算法,递归自主性识别(Yehezkel和Lerner,2009)。该算法用于学习B2N算法中的结构(Rohekar等人,NeurIPS 2018b)

- B-RAI算法,用于不确定性估计的Bootstrap/Bayesian-RAI(Rohekar等人,NeurIPS 2018a)。该算法用于学习BRAINet的结构(Rohekar等人,NeurIPS 2019)

-

存在潜在混杂因素和选择偏差时的因果发现

- FCI算法,快速因果推断(Spirtes等人,2000)

- ICD算法,迭代因果发现(Rohekar等人,NeurIPS 2021)

- TS-ICD算法,用于时间序列数据的ICD(Rohekar等人,ICML 2023)

-

因果推理

- CLEANN算法,神经网络注意力的因果解释(Rohekar等人,2023,Nisimov等人,2022)。

开发和检验算法

该代码库包含几个用于实现新算法和测试的类和方法。这些可以分为三类:

-

模拟:

-

因果结构学习:

- 处理图形模型的类(例如,用于图遍历和计算图属性的方法)。支持的图类型:

- 有向无环图(DAG):通常用于表示因果DAG

- 部分有向图(PDAG/CPDAG):在因果充分性下DAG的马尔可夫等价类

- 无向图(UG):通常用于表示图中的邻接关系(骨架)

- 祖先图(PAG/MAG):MAG是DAG的等价类,PAG是MAG的等价类(Richardson和Spirtes,2002)。

- 统计测试(CI测试)对数据进行操作,以及完美CI预言机(参见使用完美预言机的因果发现)

- 处理图形模型的类(例如,用于图遍历和计算图属性的方法)。支持的图类型:

-

性能评估:

- 图结构准确性

- 骨架准确性:FNR,FPR,结构汉明距离

- 方向准确性

- 整体图准确性:BDeu分数

- 计算成本:CI测试计数器(内部缓存确保每个唯一测试只计数一次)

- DAG和祖先图的绘图。

新算法可以通过继承现有算法的类(例如,B-RAI继承RAI)或创建新类来开发。

唯一需要实现的方法是

learn_structure()。对于条件独立性测试, 我们实现了条件互信息、偏相关统计检验和d-分离(完美预言机)。 此外,贝叶斯评分(BDeu)可用于评估给定数据的DAG的后验概率。

- 图结构准确性

安装

此代码已在Ubuntu 18.04 LTS和macOS Catalina上使用Python 3.5进行了测试。 我们建议在virtualenv中安装和运行它。

sudo -E pip3 install virtualenv

virtualenv -p python3 causal_env

. causal_env/bin/activate

git clone https://github.com/IntelLabs/causality-lab.git

cd causality-lab

pip install -r requirements.txt

使用示例

从观察数据中学习因果结构

所有因果结构学习算法都是带有learn_structure()方法的类,该方法用于学习因果图。

学习到的因果图是一个公共类成员,简称为graph,它是图类的一个实例。

结构学习算法不直接访问数据,而是调用访问数据的统计测试。

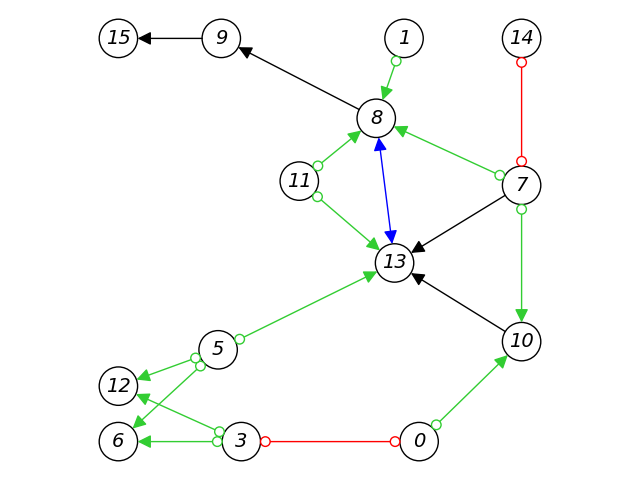

让我们看看以下示例:使用给定数据集进行ICD因果结构学习。

par_corr_test = CondIndepParCorr(dataset, threshold=0.01) # 给定显著性水平的CI测试

icd = LearnStructICD(nodes_set, par_corr_test) # 实例化ICD学习器

icd.learn_structure() # 学习因果图

完整示例请参见存在潜在混杂因素的因果发现和因果充分性下的因果发现笔记本。 然后可以绘制学习到的结构 - 有关创建PAG、计算其属性和绘制的完整示例,请参见部分祖先图笔记本。

参考文献

- Rohekar, Raanan, Yaniv Gurwicz, 和 Shami Nisimov。"预训练Transformer中自注意力的因果解释"。神经信息处理系统进展(NeurIPS) 36,2023。

- Rohekar, Raanan Y., Shami Nisimov, Yaniv Gurwicz, 和 Gal Novik。"在存在潜在混杂因素的情况下从时间到同时迭代因果发现"国际机器学习会议(ICML),2023。

- Nisimov, Shami, Raanan Y. Rohekar, Yaniv Gurwicz, Guy Koren, 和 Gal Novik。"CLEAR:神经推荐系统中基于注意力的因果解释"。RecSys推荐系统因果关系、反事实和序列决策(CONSEQUENCES)研讨会,2022。

- Rohekar, Raanan Y., Shami Nisimov, Yaniv Gurwicz, 和 Gal Novik。"可能存在潜在混杂因素和选择偏差的迭代因果发现"神经信息处理系统进展(NeurIPS) 34,2021。

- Rohekar, Raanan Y., Yaniv Gurwicz, Shami Nisimov, 和 Gal Novik。"通过学习深度神经连接层次来建模不确定性"。神经信息处理系统进展(NeurIPS) 32: 4244-4254,2019。

- Rohekar, Raanan Y., Yaniv Gurwicz, Shami Nisimov, Guy Koren, 和 Gal Novik。"通过递归自助法进行贝叶斯结构学习。"神经信息处理系统进展(NeurIPS) 31: 10525-10535,2018a。

- Rohekar, Raanan Y., Shami Nisimov, Yaniv Gurwicz, Guy Koren, 和 Gal Novik。"通过贝叶斯网络结构学习构建深度神经网络"。神经信息处理系统进展(NeurIPS) 31: 3047-3058,2018b。

- Yehezkel, Raanan, 和 Boaz Lerner。"通过递归自主识别进行贝叶斯网络结构学习"。机器学习研究杂志(JMLR) 10, no. 7, 2009

- Richardson, Thomas, 和 Peter Spirtes。"祖先图马尔可夫模型"。统计年鉴,30 (4): 962–1030,2002。

- Spirtes Peter, Clark N. Glymour, Richard Scheines, 和 David Heckerman。"因果、预测和搜索"。MIT出版社,2000。

访问官网

访问官网 Github

Github Huggingface

Huggingface 文档

文档 论文

论文