🏠 主页|🛠 扩展 VS Code, Jetbrains|🤗 HF 仓库 | 🪧 HF 演示

CodeGeeX4:开源多语言代码生成模型

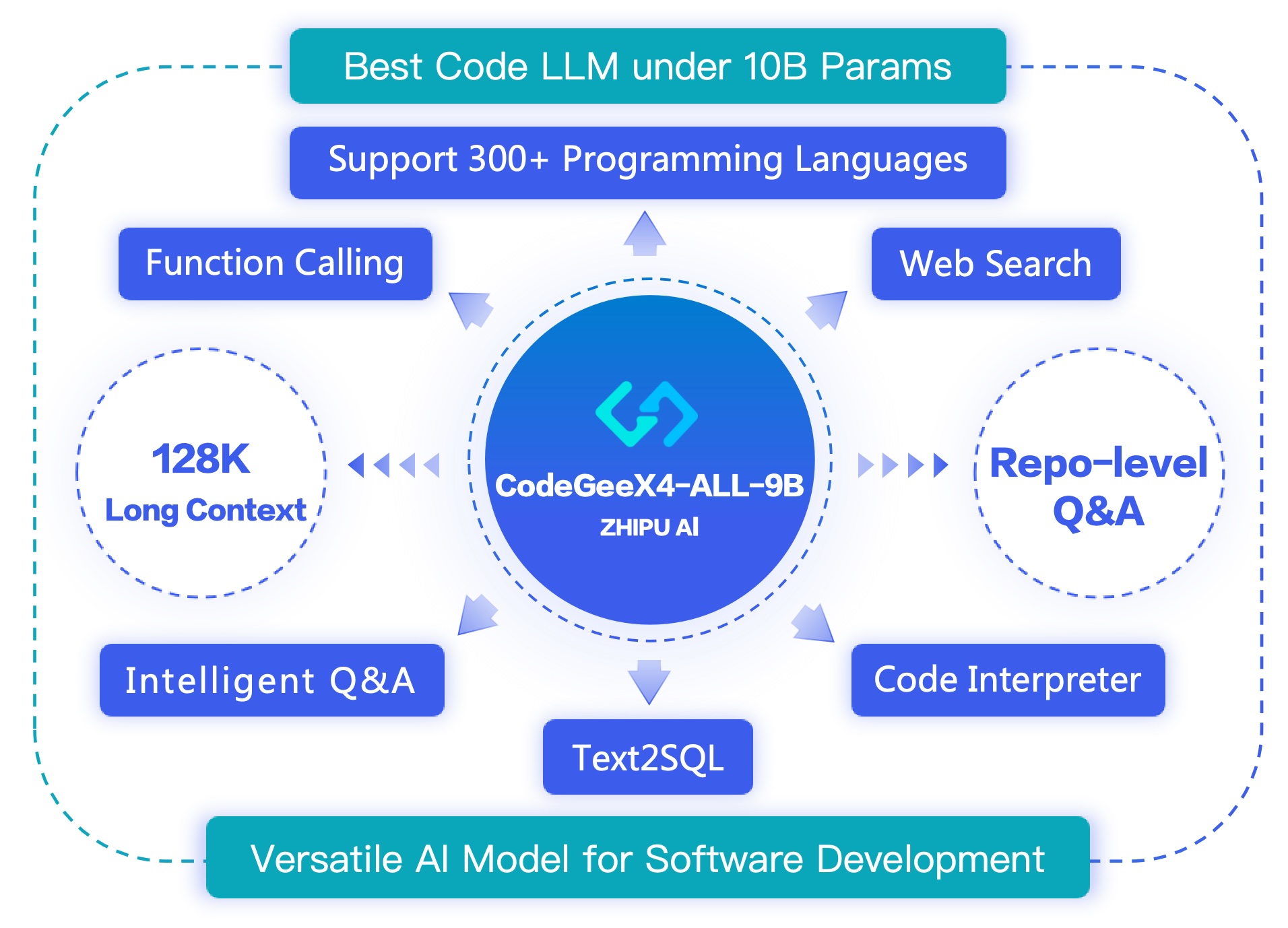

我们推出了CodeGeeX4-ALL-9B,这是最新CodeGeeX4模型系列的开源版本。它是一个基于GLM-4-9B持续训练的多语言代码生成模型,显著提升了其代码生成能力。使用单一的CodeGeeX4-ALL-9B模型,可以支持代码补全和生成、代码解释器、网络搜索、函数调用、仓库级代码问答等全面功能,涵盖软件开发的各种场景。CodeGeeX4-ALL-9B在公开基准测试上取得了极具竞争力的表现,如BigCodeBench和NaturalCodeBench。它目前是参数量少于10B的最强大代码生成模型,甚至超越了许多更大的通用模型,在推理速度和模型性能方面达到了最佳平衡。

模型列表

| 模型 | 类型 | 序列长度 | 下载 |

|---|---|---|---|

| codegeex4-all-9b | 对话 | 128K | 🤗 Huggingface 🤖 ModelScope 🟣 WiseModel |

快速开始

Ollama

CodeGeeX4现已在Ollama上可用! 请安装Ollama 0.2或更高版本,并运行以下命令:

ollama run codegeex4

要将本地模型连接到我们的VS Code / Jetbrains扩展,请查看本地模式指南。

Huggingface transformers

使用4.39.0<=transformers<=4.40.2快速启动codegeex4-all-9b:

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

device = "cuda" if torch.cuda.is_available() else "cpu"

tokenizer = AutoTokenizer.from_pretrained("THUDM/codegeex4-all-9b", trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

"THUDM/codegeex4-all-9b",

torch_dtype=torch.bfloat16,

low_cpu_mem_usage=True,

trust_remote_code=True

).to(device).eval()

inputs = tokenizer.apply_chat_template([{"role": "user", "content": "写一个快速排序"}], add_generation_prompt=True, tokenize=True, return_tensors="pt", return_dict=True ).to(device)

with torch.no_grad():

outputs = model.generate(**inputs)

outputs = outputs[:, inputs['input_ids'].shape[1]:]

print(tokenizer.decode(outputs[0], skip_special_tokens=True))

vLLM

使用vllm==0.5.1快速启动codegeex4-all-9b:

from transformers import AutoTokenizer

from vllm import LLM, SamplingParams

# CodeGeeX4-ALL-9B

# max_model_len, tp_size = 1048576, 4

# 如果内存不足,请减小max_model_len或增加tp_size

max_model_len, tp_size = 131072, 1

model_name = "codegeex4-all-9b"

prompt = [{"role": "user", "content": "你好"}]

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

llm = LLM(

model=model_name,

tensor_parallel_size=tp_size,

max_model_len=max_model_len,

trust_remote_code=True,

enforce_eager=True,

# 如果内存不足,尝试使用以下参数

# enable_chunked_prefill=True,

# max_num_batched_tokens=8192

)

stop_token_ids = [151329, 151336, 151338]

sampling_params = SamplingParams(temperature=0.95, max_tokens=1024, stop_token_ids=stop_token_ids)

inputs = tokenizer.apply_chat_template(prompt, tokenize=False, add_generation_prompt=True)

outputs = llm.generate(prompts=inputs, sampling_params=sampling_params)

print(outputs[0].outputs[0].text)

通过vllm设置OpenAI兼容服务器,详情请查看OpenAI兼容服务器

python -m vllm.entrypoints.openai.api_server \

--model THUDM/codegeex4-all-9b \

--trust_remote_code

Rust-candle

Codegeex4现在支持Candle框架仓库

命令行界面

使用Rust启动codegeex4-all-9b:

cd candle_demo

cargo build -p codegeex4-cli --release --features cuda # 用于Cuda

cargo build -p codegeex4-cli --release # 用于CPU

./target/release/codegeex4-cli --sample-len 512

教程

CodeGeeX4-ALL-9B提供了三个用户指南,帮助用户快速理解和使用模型:

-

系统提示指南:本指南介绍如何在CodeGeeX4-ALL-9B中使用系统提示,包括VSCode扩展官方系统提示、自定义系统提示,以及维护多轮对话历史的一些技巧。

-

代码填充指南:本指南解释了VSCode扩展官方的代码填充格式,涵盖一般填充、跨文件填充以及在仓库中生成新文件。

-

仓库任务指南:本指南演示了如何在CodeGeeX4-ALL-9B中使用仓库任务,包括仓库级别的问答任务以及如何触发CodeGeeX4-ALL-9B的aicommiter功能,以在仓库级别执行文件的删除、添加和修改。

-

本地模式指南:本指南介绍了如何在本地部署CodeGeeX4-ALL-9B,并将其连接到Visual Studio Code / Jetbrains扩展。

这些指南旨在提供全面的理解并促进模型的高效使用。

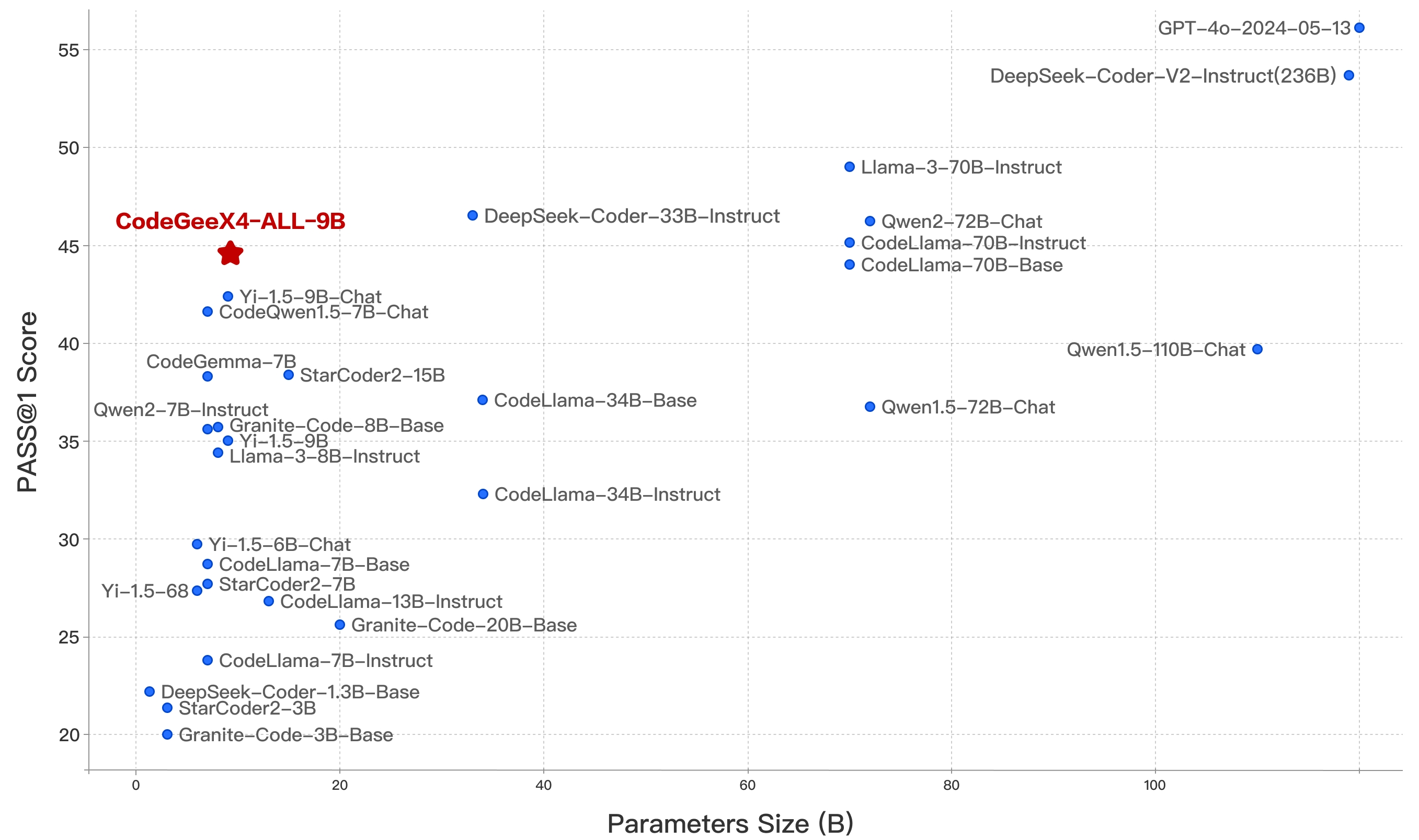

评估

CodeGeeX4-ALL-9B被评为100亿参数以下最强大的模型,甚至超越了几倍于其规模的通用模型,实现了推理性能和模型效果之间的最佳平衡。

| 模型 | 序列长度 | HumanEval | MBPP | NCB | LCB | HumanEvalFIM | CRUXEval-O |

|---|---|---|---|---|---|---|---|

| Llama3-70B-intruct | 8K | 77.4 | 82.3 | 37.0 | 27.4 | - | - |

| DeepSeek Coder 33B Instruct | 16K | 81.1 | 80.4 | 39.3 | 29.3 | 78.2 | 49.9 |

| Codestral-22B | 32K | 81.1 | 78.2 | 46.0 | 35.3 | 91.6 | 51.3 |

| CodeGeeX4-All-9B | 128K | 82.3 | 75.7 | 40.4 | 28.5 | 85.0 | 47.1 |

CodeGeeX4-ALL-9B在BigCodeBench的complete和instruct任务中分别得分为48.9和40.4,这是20亿参数以下模型中的最高分。

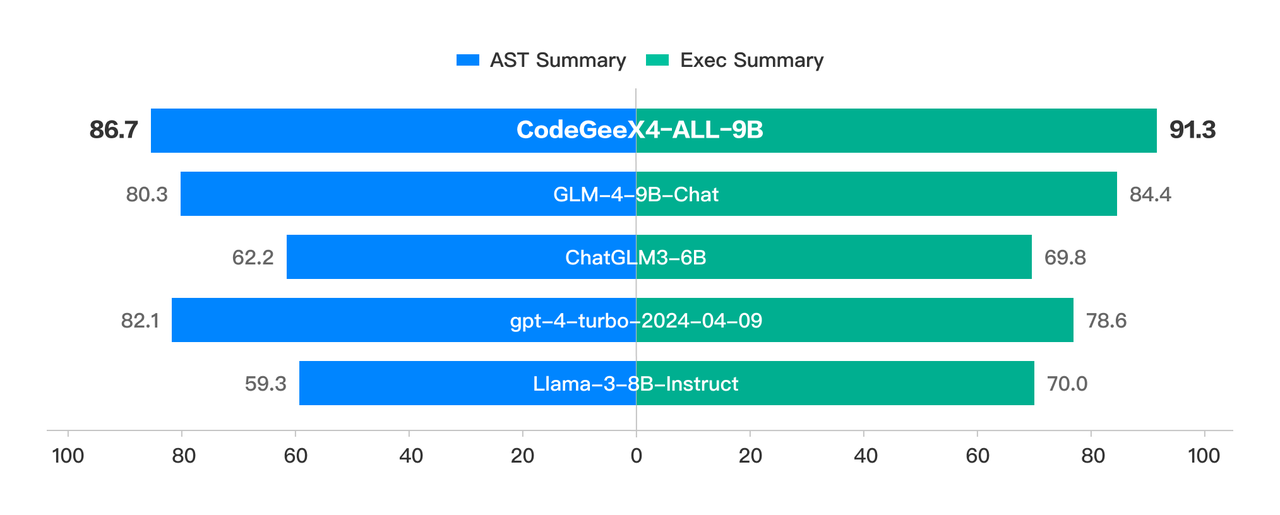

在测试代码推理、理解和执行能力的CRUXEval基准测试中,CodeGeeX4-ALL-9B凭借其COT(思维链)能力展现了显著的结果。从HumanEval和MBPP中的简单代码生成任务,到NaturalCodeBench中的极具挑战性的任务,CodeGeeX4-ALL-9B在其规模上也取得了出色的表现。它目前是唯一支持函数调用功能的代码模型,甚至在执行成功率上超过了GPT-4。

在测试代码推理、理解和执行能力的CRUXEval基准测试中,CodeGeeX4-ALL-9B凭借其COT(思维链)能力展现了显著的结果。从HumanEval和MBPP中的简单代码生成任务,到NaturalCodeBench中的极具挑战性的任务,CodeGeeX4-ALL-9B在其规模上也取得了出色的表现。它目前是唯一支持函数调用功能的代码模型,甚至在执行成功率上超过了GPT-4。

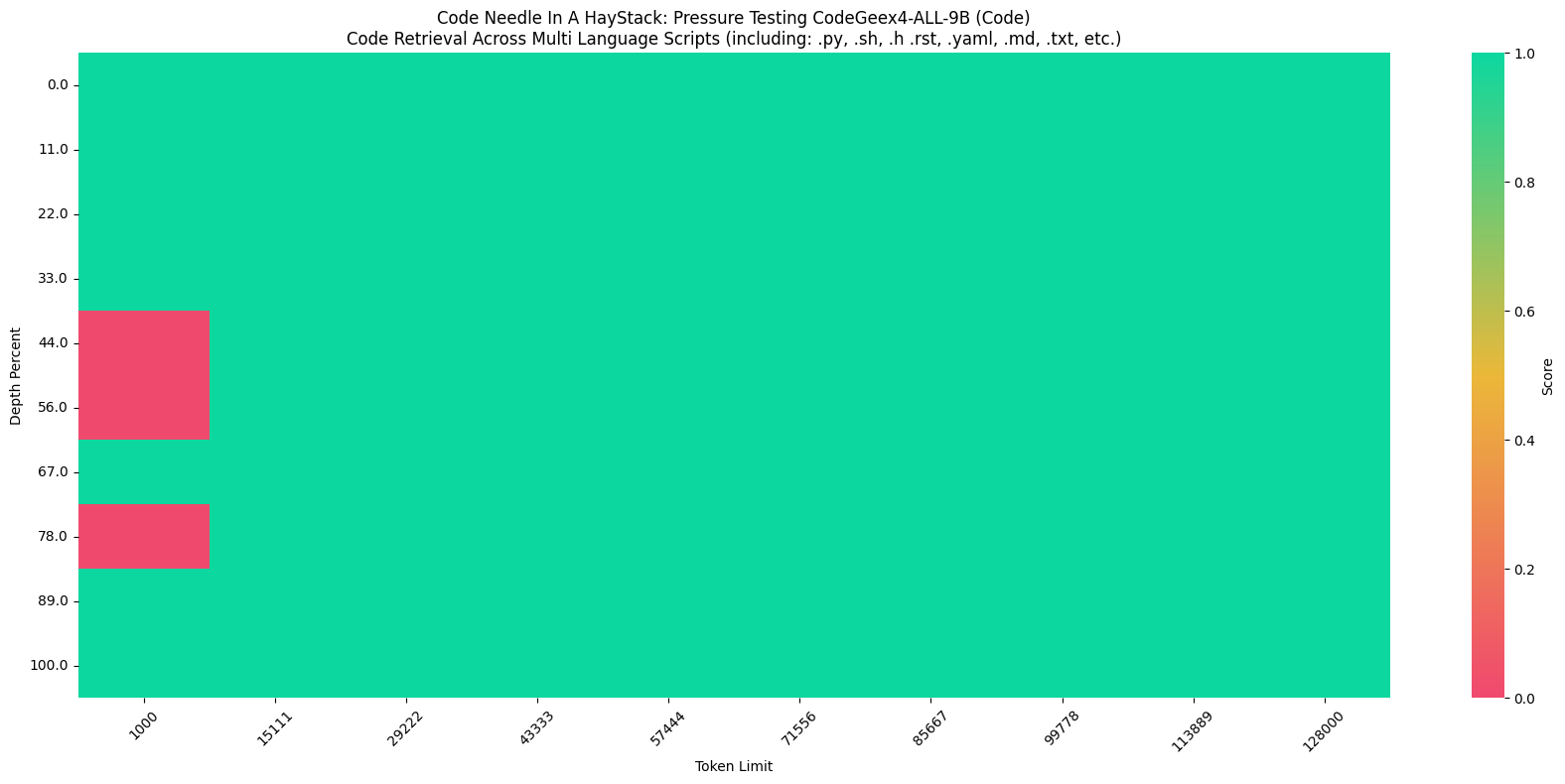

此外,在"Code Needle In A Haystack"(NIAH)评估中,CodeGeeX4-ALL-9B模型展示了其在长达128K的上下文中检索代码的能力,在所有Python脚本中实现了100%的检索准确率。

此外,在"Code Needle In A Haystack"(NIAH)评估中,CodeGeeX4-ALL-9B模型展示了其在长达128K的上下文中检索代码的能力,在所有Python脚本中实现了100%的检索准确率。

评估结果的详细信息可以在**评估**中找到。

许可证

本仓库中的代码根据Apache-2.0许可证开源。模型权重根据模型许可证授权。CodeGeeX4-9B权重对学术研究开放。希望将模型用于商业目的的用户,请填写注册表单。

引用

如果您觉得我们的工作有帮助,请随时引用以下论文:

@inproceedings{zheng2023codegeex,

title={CodeGeeX: A Pre-Trained Model for Code Generation with Multilingual Benchmarking on HumanEval-X},

author={Qinkai Zheng and Xiao Xia and Xu Zou and Yuxiao Dong and Shan Wang and Yufei Xue and Zihan Wang and Lei Shen and Andi Wang and Yang Li and Teng Su and Zhilin Yang and Jie Tang},

booktitle={Proceedings of the 29th ACM SIGKDD Conference on Knowledge Discovery and Data Mining},

pages={5673--5684},

year={2023}

}

访问官网

访问官网 Github

Github Huggingface

Huggingface