:trident: 语音三叉戟 - 卓越语音语言模型

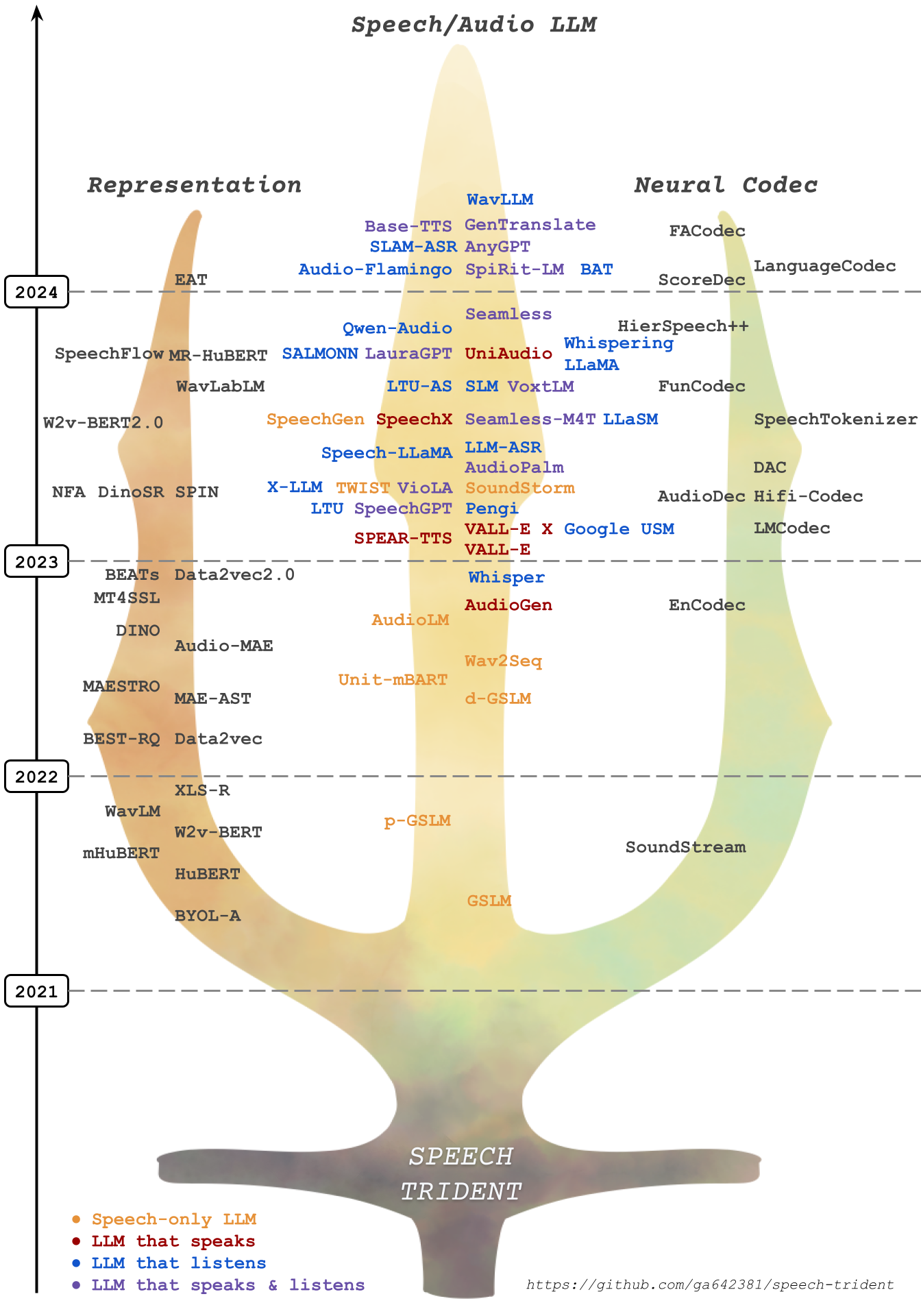

在这个仓库中,我们调研了对语音/音频大型语言模型有重要贡献的三个关键领域:(1) 表征学习,(2) 神经编解码器,以及 (3) 语言模型。

1.⚡ 语音表征模型: 这些模型专注于学习结构化的语音表征,然后可以将其量化为离散的语音标记,通常称为语义标记。

2.⚡ 语音神经编解码器模型: 这些模型旨在学习语音和音频的离散标记,通常称为声学标记,同时保持重建能力和低比特率。

3.⚡ 语音大型语言模型: 这些模型在语音和声学标记之上以语言建模的方式进行训练。它们在语音理解和语音生成任务中展现出高水平的能力。

:trident: 贡献者

:trident: 语音/音频语言模型

| 日期 | 模型名称 | 论文标题 | 链接 |

|---|---|---|---|

| 2024-04 | WavLLM | WavLLM:迈向稳健和自适应的语音大型语言模型 | 论文 |

| 2024-02 | SLAM-ASR | 一种简单有效的具有强大ASR能力的LLM方法 | 论文 |

| 2024-02 | AnyGPT | AnyGPT:基于离散序列建模的统一多模态LLM | 论文 |

| 2024-02 | SpiRit-LM | SpiRit-LM:交错的口语和书面语言模型 | 论文 |

| 2024-02 | BAT | BAT:学习用大型语言模型推理空间声音 | 论文 |

| 2024-02 | Audio Flamingo | Audio Flamingo:具有少样本学习和对话能力的新型音频语言模型 | 论文 |

| 2024-02 | 文本描述到语音 | 使用合成注释引导高保真文本到语音的自然语言 | 论文 |

| 2024-02 | GenTranslate | GenTranslate:大型语言模型作为生成式多语言语音和机器翻译器 | 论文 |

| 2024-02 | Base-TTS | BASE TTS:在10万小时数据上构建十亿参数文本到语音模型的经验教训 | 论文 |

| 2024-02 | -- | 为时不晚:将声学信息融入大型语言模型用于自动语音识别 | 论文 |

| 2024-01 | -- | 大型语言模型是抗噪声语音识别的高效学习者 | 论文 |

| 2023-12 | Seamless | Seamless:多语言表达性和流式语音翻译 | 论文 |

| 2023-11 | Qwen-Audio | Qwen-Audio:通过统一的大规模音频-语言模型推进通用音频理解 | 论文 |

| 2023-10 | LauraGPT | LauraGPT:用GPT聆听、关注、理解和重新生成音频 | 论文 |

| 2023-10 | SALMONN | SALMONN:为大型语言模型实现通用听觉能力 | 论文 |

| 2023-10 | UniAudio | UniAudio:面向通用音频生成的音频基础模型 | 论文 |

| 2023-10 | Whispering LLaMA | Whispering LLaMA:用于语音识别的跨模态生成错误纠正框架 | 论文 |

| 2023-09 | VoxtLM | Voxtlm:统一解码器模型以整合语音识别/合成和语音/文本延续任务 | 论文 |

| 2023-09 | LTU-AS | 联合音频和语音理解 | 论文 |

| 2023-09 | SLM | SLM:弥合语音和文本基础模型之间的细微差距 | 论文 |

| 2023-09 | -- | 使用大型语言模型和任务激活提示进行生成式语音识别错误纠正 | 论文 |

| 2023-08 | SpeechGen | SpeechGen:通过提示释放语音语言模型的生成能力 | 论文 |

| 2023-08 | SpeechX | SpeechX:神经编解码语言模型作为多功能语音转换器 | 论文 |

| 2023-08 | LLaSM | 大型语言和语音模型 | 论文 |

| 2023-08 | SeamlessM4T | 大规模多语言和多模态机器翻译 | 论文 |

| 2023-07 | Speech-LLaMA | 关于语音到文本和大型语言模型集成的仅解码器架构 | 论文 |

| 2023-07 | LLM-ASR(临时) | 提示具有语音识别能力的大型语言模型 | 论文 |

| 2023-06 | AudioPaLM | AudioPaLM:一个能说能听的大型语言模型 | 论文 |

| 2023-05 | Spectron | 使用频谱图驱动的LLM进行口语问答和语音延续 | 论文 |

| 2023-05 | TWIST | 文本预训练的语音语言模型 | 论文 |

| 2023-05 | Pengi | Pengi:用于音频任务的音频语言模型 | 论文 |

| 2023-05 | SoundStorm | 高效并行音频生成 | 论文 |

| 2023-05 | LTU | 联合音频和语音理解 | 论文 |

| 2023-05 | SpeechGPT | 赋予大型语言模型内在的跨模态对话能力 | 论文 |

| 2023-05 | VioLA | 用于语音识别、合成和翻译的统一编解码语言模型 | 论文 |

| 2023-05 | X-LLM | X-LLM:通过将多模态视为外语来引导先进的大型语言模型 | 论文 |

| 2023-03 | Google USM | Google USM:将自动语音识别扩展到100多种语言 | 论文 |

| 2023-03 | VALL-E X | 用你自己的声音说外语:跨语言神经编解码语言建模 | 论文 |

| 2023-02 | SPEAR-TTS | 说、读和提示:最小监督下的高保真文本到语音 | 论文 |

| 2023-01 | VALL-E | 神经编解码语言模型是零样本文本到语音合成器 | 论文 |

| 2022-12 | Whisper | 通过大规模弱监督实现稳健的语音识别 | 论文 |

| 2022-10 | AudioGen | AudioGen:文本引导的音频生成 | 论文 |

| 2022-09 | AudioLM | AudioLM:一种音频生成的语言建模方法 | 论文 |

| 2022-05 | Wav2Seq | Wav2Seq:使用伪语言预训练语音到文本编码器-解码器模型 | 论文 |

| 2022-04 | Unit mBART | 通过自监督预训练和数据增强增强直接语音到语音翻译 | 论文 |

| 2022-03 | d-GSLM | 生成式口语对话语言建模 | 论文 |

| 2021-10 | SLAM | SLAM:通过语音-文本联合预训练实现语音和语言建模的统一编码器 | 论文 |

| 2021-09 | p-GSLM | 无文本的韵律感知生成式口语语言建模 | 论文 |

| 2021-02 | GSLM | 从原始音频生成口语语言建模 | 论文 |

:trident: 语音/音频表示模型

| 日期 | 模型名称 | 论文标题 | 链接 |

|---|---|---|---|

| 2024-01 | EAT | 基于高效音频Transformer的自监督预训练 | 论文 |

| 2023-10 | MR-HuBERT | 多分辨率HuBERT:基于掩蔽单元预测的多分辨率语音自监督学习 | 论文 |

| 2023-10 | SpeechFlow | 基于流匹配的语音生成预训练 | 论文 |

| 2023-09 | WavLabLM | 用于大规模多语言自监督学习的联合预测和去噪 | 论文 |

| 2023-08 | W2v-BERT 2.0 | 大规模多语言和多模态机器翻译 | 论文 |

| 2023-07 | Whisper-AT | 噪声鲁棒的自动语音识别器也是强大的通用音频事件标注器 | 论文 |

| 2023-06 | ATST | 用于片段级和帧级任务的自监督音频教师-学生Transformer | 论文 |

| 2023-05 | SPIN | 通过说话人不变聚类进行自监督微调以改善内容表示 | 论文 |

| 2023-05 | DinoSR | 自蒸馏和在线聚类用于自监督语音表示学习 | 论文 |

| 2023-05 | NFA | 用于解耦句级语音表示的自监督神经因子分析 | 论文 |

| 2022-12 | Data2vec 2.0 | 用于视觉、语音和语言的高效自监督学习与上下文化目标表示 | 论文 |

| 2022-12 | BEATs | 基于声学分词器的音频预训练 | 论文 |

| 2022-11 | MT4SSL | MT4SSL:通过整合多个目标提升自监督语音表示学习 | 论文 |

| 2022-08 | DINO | 非对比自监督学习句级语音表示 | 论文 |

| 2022-07 | Audio-MAE | 会倾听的掩蔽自编码器 | 论文 |

| 2022-04 | MAESTRO | 通过模态匹配实现匹配的语音文本表示 | 论文 |

| 2022-03 | MAE-AST | 掩蔽自编码音频谱图Transformer | 论文 |

| 2022-03 | LightHuBERT | 轻量化且可配置的语音表示学习与一次性隐藏单元BERT | 论文 |

| 2022-02 | Data2vec | 语音、视觉和语言自监督学习的通用框架 | 论文 |

| 2021-10 | WavLM | WavLM:用于全栈语音处理的大规模自监督预训练 | 论文 |

| 2021-08 | W2v-BERT | 结合对比学习和掩蔽语言建模进行自监督语音预训练 | 论文 |

| 2021-07 | mHuBERT | 基于离散单元的直接语音到语音翻译 | 论文 |

| 2021-06 | HuBERT | 通过隐藏单元的掩蔽预测进行自监督语音表示学习 | 论文 |

| 2021-03 | BYOL-A | 用于通用音频表示的自监督学习 | 论文 |

| 2020-12 | DeCoAR2.0 | DeCoAR 2.0:基于向量量化的深度上下文化声学表示 | 论文 |

| 2020-07 | TERA | TERA:用于语音的Transformer编码器表示的自监督学习 | 论文 |

| 2020-06 | Wav2vec2.0 | wav2vec 2.0:语音表示自监督学习框架 | 论文 |

| 2019-10 | APC | 基于自回归预测编码的语音生成预训练 | 论文 |

| 2018-07 | CPC | 基于对比预测编码的表示学习 | 论文 |

:trident: 语音/音频编解码模型

| 日期 | 模型名称 | 论文标题 | 链接 |

|---|---|---|---|

| 2024-05 | HILCodec | HILCodec:高保真度和轻量级神经音频编解码器 | 论文 |

| 2024-04 | SemantiCodec | SemantiCodec:用于通用声音的超低比特率语义音频编解码器 | 论文 |

| 2024-03 | FACodec | NaturalSpeech 3:使用因子化编解码器和扩散模型进行零样本语音合成 | 论文 |

| 2024-02 | Language-Codec | Language-Codec:缩小离散编解码器表示与语音语言模型之间的差距 | 论文 |

| 2024-01 | ScoreDec | ScoreDec:一种保留相位的高保真音频编解码器,配备广义基于分数的扩散后处理滤波器 | 论文 |

| 2023-11 | HierSpeech++ | HierSpeech++:通过分层变分推断弥合语音语义和声学表示之间的差距,用于零样本语音合成 | 论文 |

| 2023-09 | FunCodec | FunCodec:一个基础、可复现且可集成的开源神经语音编解码器工具包 | 论文 |

| 2023-08 | SpeechTokenizer | Speechtokenizer:用于语音大型语言模型的统一语音分词器 | 论文 |

| 2023-06 | Descript-audio-codec | 使用改进的RVQGAN进行高保真音频压缩 | 论文 |

| 2023-05 | AudioDec | Audiodec:一个开源流式高保真神经音频编解码器 | 论文 |

| 2023-05 | HiFi-Codec | Hifi-codec:用于高保真音频编解码的群体残差向量量化 | 论文 |

| 2023-03 | LMCodec | LMCodec:使用因果Transformer模型的低比特率语音编解码器 | 论文 |

| 2022-10 | EnCodec | 高保真神经音频压缩 | 论文 |

| 2021-07 | SoundStream | SoundStream:端到端神经音频编解码器 | 论文 |

:trident: ICASSP 2024教程信息

我(张凯维)将在ICASSP 2024教程中发表演讲,题目为语音和语言基础模型的参数高效和提示学习。主题将涵盖当今的语音/音频大型语言模型。

教程讲者:

- 杨博士(NVIDIA)

- 陈品宇博士(IBM研究院)

- 李宏毅教授(国立台湾大学)

- 张凯维(国立台湾大学)

- 江承翰(国立台湾大学)

首尔见!

:trident: 更新:教程已在ICASSP 2024成功举行。感谢所有与会者的参与。我的演讲幻灯片可在https://kwchang.org/talks/获取。如有任何讨论,欢迎随时与我联系。

:trident: 相关仓库

- https://github.com/liusongxiang/Large-Audio-Models

- https://github.com/kuan2jiu99/Awesome-Speech-Generation

- https://github.com/ga642381/Speech-Prompts-Adapters

- https://github.com/voidful/Codec-SUPERB

- https://github.com/huckiyang/awesome-neural-reprogramming-prompting

引用

如果您觉得这个仓库有用,请考虑引用以下论文。

@article{wu2024codec,

标题={Codec-SUPERB:声音编解码器模型的深入分析},

作者={吴海滨 和 钟浩林 和 林奕政 和 吴元奎 和 陈宣君 和 白宇骐 和 王秀璇 和 张凯为 和 刘亚历山大 H 和 李宏毅},

期刊={arXiv预印本 arXiv:2402.13071},

年份={2024}

}

@article{wu2024towards,

标题={迈向音频语言建模-综述},

作者={吴海滨 和 陈宣君 和 林奕政 和 张凯为 和 钟浩林 和 刘亚历山大 H 和 李宏毅},

期刊={arXiv预印本 arXiv:2402.13236},

年份={2024}

}

Github

Github 论文

论文