BitNet-Transformers:压缩与加速大型语言模型的新方法

近年来,大型语言模型(Large Language Models, LLMs)在自然语言处理领域取得了巨大的成功。然而,随着模型规模的不断扩大,其部署和应用也面临着巨大的挑战,尤其是在计算资源和能源消耗方面。为了解决这一问题,研究人员提出了BitNet,一种可扩展且稳定的1比特Transformer架构,专为大型语言模型设计。本文将详细介绍BitNet-Transformers项目,探讨其实现原理、性能表现以及未来发展方向。

BitNet的核心思想与创新

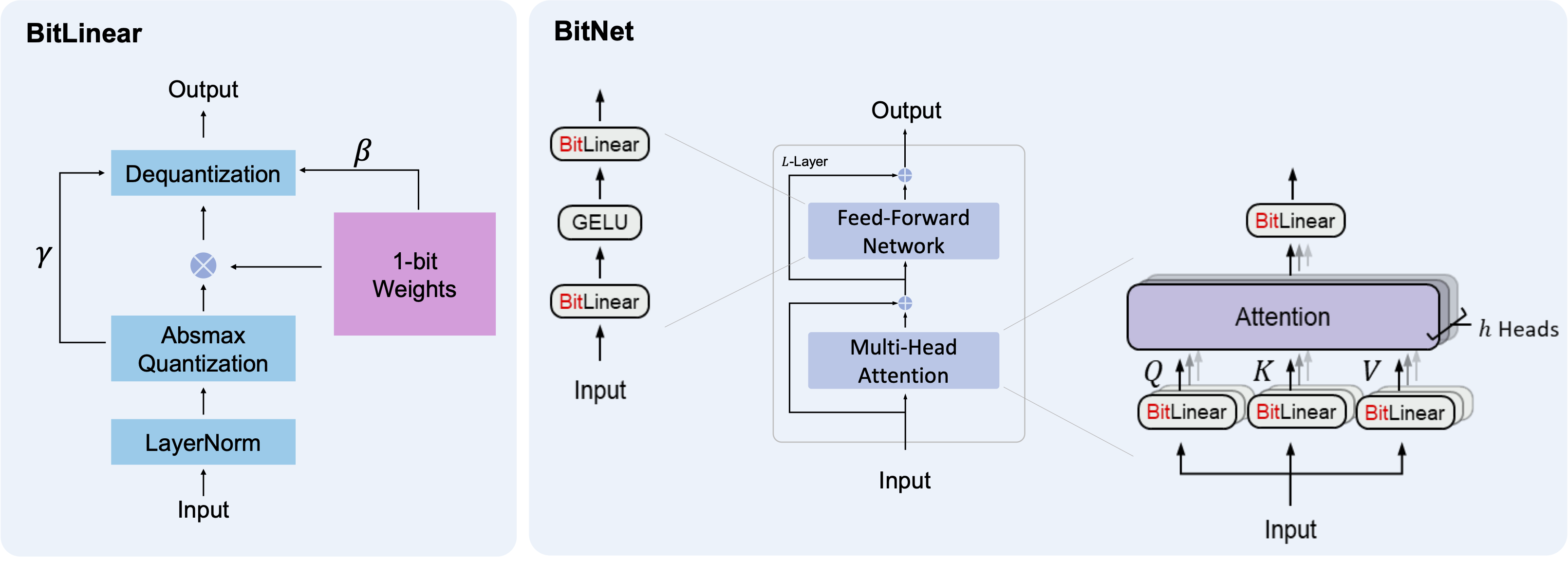

BitNet的核心创新在于引入了BitLinear层,作为传统nn.Linear层的替代。这一改变使得模型能够从头开始训练1比特权重,大大降低了模型的存储需求和计算复杂度。具体来说,BitNet在以下几个方面实现了突破:

-

1比特量化:将模型参数从传统的32位或16位浮点数压缩到仅1比特,极大地减少了模型的存储空间。

-

高效计算:通过使用1比特权重,BitNet能够利用更高效的计算方法,如XNOR运算,显著提高计算速度。

-

可扩展性:实验结果表明,BitNet展现出与全精度Transformer相似的扩展规律,这意味着它有潜力被应用于更大规模的语言模型。

BitNet-Transformers的实现与性能

BitNet-Transformers项目基于Hugging Face的Transformers库,使用PyTorch实现了BitNet架构。该项目主要包含以下关键组件:

-

BitLinear层:这是整个架构的核心,实现了1比特权重的前向传播和反向传播。

-

LLamaForCausalLM模型:集成了BitLinear层的Llama模型变体,用于因果语言建模任务。

-

训练和推理脚本:提供了在WikiText-103数据集上训练模型的示例脚本。

性能方面,BitNet-Transformers展现出了令人印象深刻的结果:

-

内存占用:相比原始16位LLAMA模型占用250MB GPU内存,BitLLAMA混合16位版本仅占用200MB,而8位版本更是只需100MB。

-

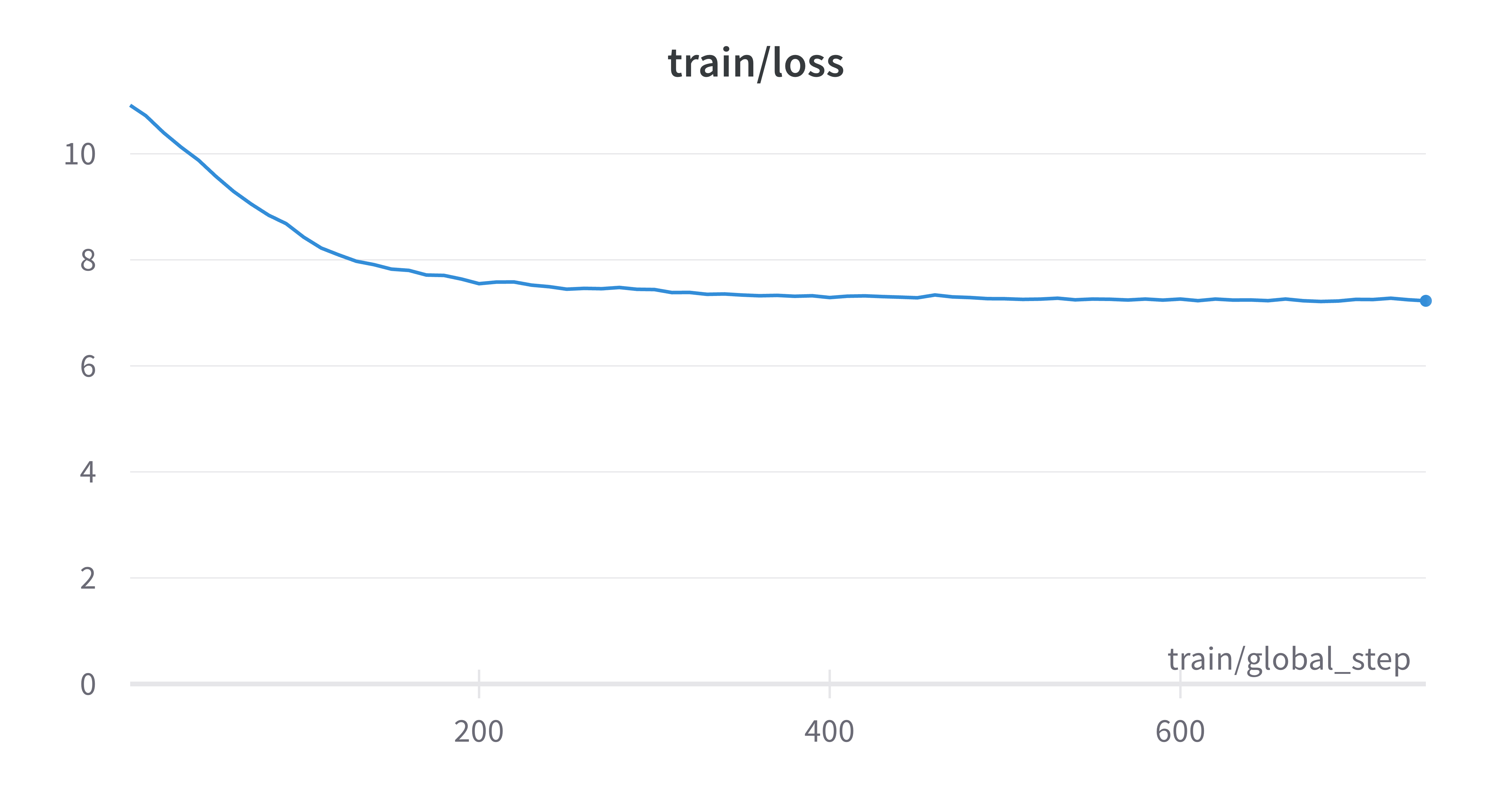

训练效率:使用WikiText-103数据集进行训练时,BitLLAMA展现出良好的收敛性能,损失曲线平稳下降。

-

计算速度:由于采用1比特权重,BitNet在矩阵乘法等核心操作上能够获得显著的速度提升。

BitNet-Transformers的潜在应用

BitNet-Transformers的出现为大型语言模型的应用开辟了新的可能性:

-

移动设备部署:由于极低的内存占用,BitNet使得在智能手机等资源受限设备上运行大型语言模型成为可能。

-

边缘计算:BitNet的高效计算特性使其非常适合在边缘设备上进行实时自然语言处理任务。

-

大规模模型训练:通过降低资源需求,BitNet允许研究人员和开发者使用更少的硬件资源训练更大规模的模型。

-

绿色AI:BitNet的低能耗特性有助于减少AI模型的碳足迹,推动更环保的AI发展。

未来展望与挑战

尽管BitNet-Transformers展现出了巨大的潜力,但要实现其全面应用还面临一些挑战:

-

精度平衡:如何在极端量化的同时保持模型性能是一个需要持续研究的问题。

-

硬件适配:充分发挥1比特运算的优势需要专门的硬件支持,这可能需要一定的时间来实现。

-

训练稳定性:1比特量化可能会影响模型的训练稳定性,需要开发更robust的训练方法。

-

通用性验证:还需要在更多任务和数据集上验证BitNet的性能,以确保其通用性。

结语

BitNet-Transformers项目为解决大型语言模型的资源消耗问题提供了一个极具前景的方向。通过创新的1比特量化技术,它不仅大大降低了模型的存储和计算需求,还保持了令人满意的性能。随着进一步的研究和优化,BitNet有望成为推动大型语言模型走向更广泛应用的关键技术之一。

对于研究人员和开发者来说,BitNet-Transformers项目提供了一个绝佳的平台,用于探索极限量化在自然语言处理领域的应用。我们期待看到更多基于BitNet的创新应用和改进,推动自然语言处理技术向更高效、更环保的方向发展。

图1: BitNet架构示意图

图2: BitLLAMA在WikiText-103数据集上的训练损失曲线

参考文献:

- Wang, H., Ma, S., Dong, L., et al. (2023). BitNet: Scaling 1-bit Transformers for Large Language Models. arXiv preprint arXiv:2310.11453.

- Beomi. (2023). BitNet-Transformers. GitHub repository. https://github.com/Beomi/BitNet-Transformers