EEG-ATCNet:突破性的脑电图运动想象分类模型

近年来,脑-机接口(BCI)技术在人机交互、康复医疗等领域的应用前景引起了广泛关注。其中,基于脑电图(EEG)信号的运动想象(MI)分类是BCI研究的一个重要方向。然而,EEG信号的高维度、低信噪比以及个体差异性给MI分类带来了巨大挑战。为了解决这些问题,来自沙特阿拉伯国王大学智能机器人研究中心的研究团队提出了一种新型深度学习模型——注意力时间卷积网络(ATCNet),为EEG-MI信号分类开辟了新的道路。

ATCNet的创新设计

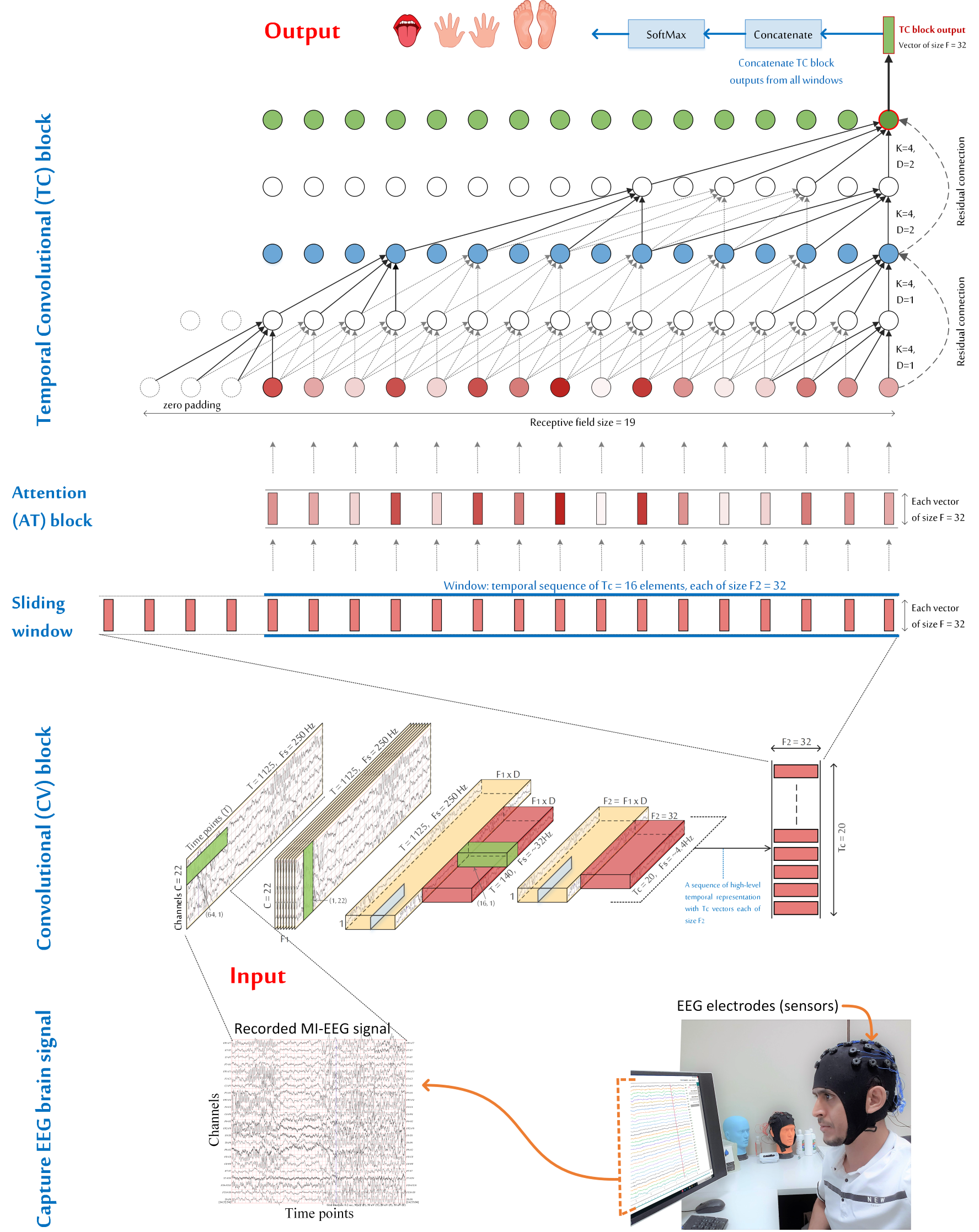

ATCNet的设计灵感部分来源于视觉transformer(ViT),但针对EEG信号的特点做了多项创新:

-

多层非线性投影:不同于ViT使用单层线性投影,ATCNet采用多层卷积投影,专门为EEG信号设计。

-

并行编码器:ATCNet使用并行的编码器结构,各编码器输出拼接在一起,而非ViT的串行堆叠方式。

-

时间卷积网络:在注意力机制之后,ATCNet使用时间卷积网络(TCN)提取高层时序特征,替代了ViT中的多层感知机。

-

滑动窗口:ATCNet引入基于卷积的滑动窗口机制,有效增强了MI数据,提升了分类性能。

ATCNet的整体架构由三个主要模块组成:

-

卷积(CV)模块:通过三个卷积层,将MI-EEG信号中的低层时空信息编码为高层时序表示。

-

注意力(AT)模块:使用多头自注意力机制(MHA),突出时序序列中的重要信息。

-

时间卷积(TC)模块:利用时间卷积层,从注意力突出的信息中提取高层时序特征。

卓越的分类性能

研究团队在BCI竞赛IV-2a数据集上对ATCNet进行了全面评估。结果显示,ATCNet在分类准确率上显著优于现有方法:

| 模型 | 参数数量 | BCI IV-2a准确率(%) | HGD准确率(%) |

|---|---|---|---|

| ATCNet | 113,732 | 81.10 | 92.05 |

| TCNet_Fusion | 17,248 | 69.83 | 89.73 |

| EEGTCNet | 4,096 | 65.36 | 87.80 |

| MBEEG_SENet | 10,170 | 69.21 | 90.13 |

| EEGNet | 2,548 | 68.67 | 88.25 |

| DeepConvNet | 553,654 | 42.78 | 87.53 |

| ShallowConvNet | 47,364 | 67.48 | 87.00 |

值得注意的是,ATCNet在BCI IV-2a数据集上的准确率达到了81.10%,远高于其他对比模型。这一结果充分证明了ATCNet在EEG-MI信号分类任务上的卓越性能。

灵活的注意力机制

ATCNet的另一大亮点是其灵活的注意力机制设计。研究团队在attention_models.py文件中实现了多种注意力方案,包括:

- 多头自注意力(MHA)

- 具有局部性的多头注意力(MHLA)

- 压缩激励注意力(SE)

- 卷积块注意力模块(CBAM)

这种模块化的设计使得研究人员可以方便地尝试不同的注意力机制,为进一步优化模型性能提供了可能。

开源代码与复现

为了促进学术交流和技术创新,研究团队在GitHub上开源了ATCNet的完整代码(https://github.com/Altaheri/EEG-ATCNet)。该仓库不仅包含了ATCNet的实现,还提供了多个对比模型的代码,如EEGNet、EEG-TCNet等。这为研究人员提供了一个统一的平台,便于进行公平的性能对比。

此外,仓库中的preprocess.py文件提供了两种数据处理方法:

- 受试者特定(subject-specific)方法:使用原始BCI IV-2a竞赛的数据划分方式。

- 留一受试者(Leave One Subject Out, LOSO)方法:用于受试者无关的评估。

这两种方法的实现为研究人员提供了更全面的评估选择。

发展前景与应用潜力

ATCNet的成功不仅推动了EEG-MI分类技术的进步,还为BCI系统的实际应用带来了新的可能。其潜在的应用领域包括但不限于:

- 康复医疗:帮助瘫痪患者通过意念控制外部设备。

- 智能假肢:实现更自然、精准的假肢控制。

- 虚拟现实:提供更沉浸式的VR/AR体验。

- 辅助驾驶:通过脑电信号辅助判断驾驶员状态。

然而,将ATCNet应用于实际场景仍面临一些挑战,如:

- 实时性:如何在保持高精度的同时,降低模型的计算复杂度,实现实时分类。

- 鲁棒性:如何提高模型对噪声和个体差异的适应能力。

- 跨会话性能:如何保持模型在不同时间、不同环境下的稳定性能。

这些挑战也为未来的研究指明了方向。

总结与展望

EEG-ATCNet的提出为EEG-MI信号分类带来了突破性进展。其创新的模型架构、灵活的注意力机制设计以及优异的分类性能,为BCI技术的发展注入了新的活力。随着进一步的优化和应用探索,我们有理由相信,ATCNet将在推动脑-机接口技术走向实用化的道路上发挥重要作用。

未来,研究团队计划从以下几个方面继续推进ATCNet的研究:

- 探索更高效的注意力机制,进一步提升模型性能。

- 开发轻量级版本,以适应实时应用场景的需求。

- 结合迁移学习技术,提高模型的跨受试者、跨会话适应能力。

- 拓展到多模态BCI系统,融合EEG与其他生理信号。

EEG-ATCNet的成功为脑-机接口技术的未来描绘了一幅令人期待的蓝图。我们期待看到更多基于ATCNet的创新应用,为改善人类生活质量、促进人机协作做出贡献。

参考文献

-

Altaheri, H., Muhammad, G., & Alsulaiman, M. (2023). Physics-Informed Attention Temporal Convolutional Network for EEG-Based Motor Imagery Classification. IEEE Transactions on Industrial Informatics, 19(2), 2249-2258.

-

Altaheri, H., Muhammad, G., & Alsulaiman, M. (2023). Dynamic convolution with multilevel attention for EEG-based motor imagery decoding. IEEE Internet of Things Journal, 10(21), 18579-18588.

-

Altaheri, H., Muhammad, G., Alsulaiman, M., Amin, S. U., Altuwaijri, G. A., Abdul, W., ... & Faisal, M. (2023). Deep learning techniques for classification of electroencephalogram (EEG) motor imagery (MI) signals: A review. Neural Computing and Applications, 35(20), 14681-14722.