PyTorch源码阅读指南:从零开始理解深度学习框架

PyTorch作为当前最流行的深度学习框架之一,其源码理解对于想要深入学习深度学习技术的开发者来说至关重要。本文将为您提供一份详细的PyTorch源码阅读指南,帮助您从零开始逐步掌握这个强大框架的内部工作原理。

为什么要阅读PyTorch源码?

在开始之前,我们先来思考一下为什么要阅读PyTorch的源代码:

-

深入理解深度学习原理:通过阅读源码,我们可以了解PyTorch是如何实现各种深度学习算法的,从而加深对这些算法的理解。

-

提高debug能力:当遇到问题时,了解源码可以帮助我们更快地定位和解决问题。

-

贡献开源社区:理解源码后,我们就有能力为PyTorch项目做出贡献,比如修复bug或添加新功能。

-

学习优秀的代码设计:PyTorch的源码质量很高,阅读它可以学习到很多优秀的代码设计模式和技巧。

-

为开发自己的深度学习框架打基础:如果将来想开发自己的框架,阅读PyTorch源码是很好的学习资料。

PyTorch源码阅读的五个核心概念

David Bau在GitHub上的"how-to-read-pytorch"项目提供了一个很好的PyTorch源码阅读框架。他将PyTorch的核心概念分为五个部分,通过理解这五个部分,我们就能掌握PyTorch的精髓。让我们来逐一探讨:

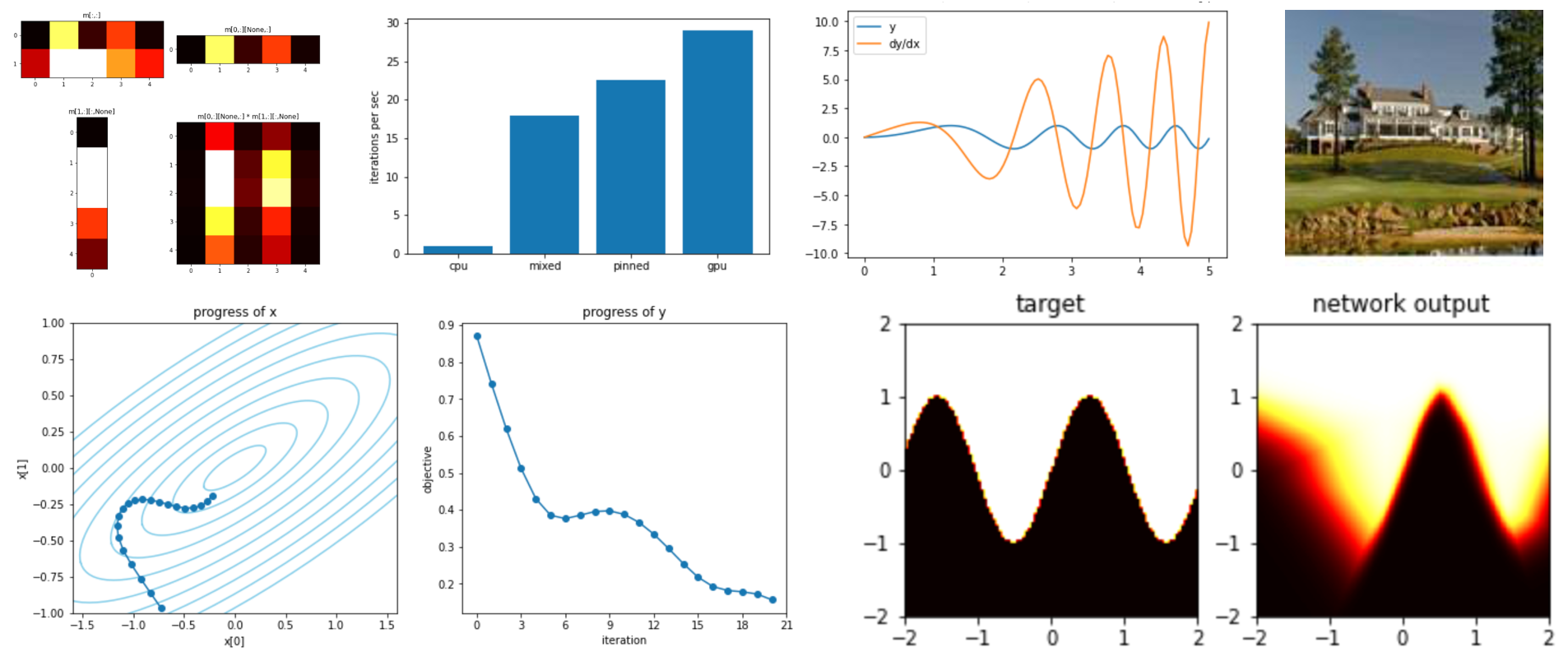

1. 张量运算(Tensor Arithmetic)

张量(Tensor)是PyTorch中最基本的数据结构,理解张量运算是理解PyTorch的第一步。

- 张量的创建和基本操作

- CPU和GPU上的张量运算

- 广播机制(Broadcasting)

- 内存布局和存储方式

例如,以下代码展示了一些基本的张量操作:

import torch

# 创建张量

a = torch.tensor([1, 2, 3])

b = torch.tensor([4, 5, 6])

# 张量运算

c = a + b

d = torch.matmul(a, b)

# GPU运算

if torch.cuda.is_available():

a_gpu = a.cuda()

b_gpu = b.cuda()

c_gpu = a_gpu + b_gpu

理解这些操作背后的原理,如何在CPU和GPU上高效实现,是深入PyTorch的第一步。

2. 自动微分(Autograd)

自动微分是PyTorch最强大的特性之一,它使得我们可以自动计算复杂函数的梯度。

- 计算图的构建

- 前向传播和反向传播

- 梯度计算和累积

- 自定义自动微分函数

看一个简单的例子:

x = torch.tensor([1.0, 2.0, 3.0], requires_grad=True)

y = x * 2

z = y.mean()

z.backward()

print(x.grad) # 输出梯度

理解这段代码背后发生了什么,PyTorch如何追踪计算并自动计算梯度,是掌握自动微分机制的关键。

3. 优化器(Optimizers)

优化器负责更新模型参数,是训练神经网络的核心组件。

- 不同优化算法的实现(SGD, Adam, RMSprop等)

- 学习率调度

- 参数组和参数组特定的学习率

例如,以下代码展示了如何使用优化器:

model = torch.nn.Linear(10, 1)

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)

for epoch in range(100):

optimizer.zero_grad()

output = model(input)

loss = criterion(output, target)

loss.backward()

optimizer.step()

理解优化器如何与自动微分系统交互,如何高效地更新大量参数,是深入PyTorch的重要一步。

4. 神经网络模块(Network Modules)

PyTorch使用nn.Module来表示神经网络中的层和模型。

nn.Module的设计与实现- 参数管理

- 前向传播的定义

- 模型的保存与加载

看一个简单的神经网络定义:

class SimpleNet(nn.Module):

def __init__(self):

super(SimpleNet, self).__init__()

self.fc1 = nn.Linear(10, 5)

self.fc2 = nn.Linear(5, 1)

def forward(self, x):

x = F.relu(self.fc1(x))

return self.fc2(x)

model = SimpleNet()

理解nn.Module如何管理参数,如何实现前向传播,以及如何与优化器和自动微分系统交互,是掌握PyTorch模型定义的关键。

5. 数据加载器(DataLoaders)

高效的数据加载对于训练大型模型至关重要。

- Dataset和DataLoader的设计

- 数据预处理和增强

- 多线程数据加载

- 自定义数据集

例如:

dataset = torchvision.datasets.MNIST(root='./data', download=True, transform=transform)

dataloader = torch.utils.data.DataLoader(dataset, batch_size=32, shuffle=True)

for batch in dataloader:

inputs, labels = batch

# 训练代码

理解DataLoader如何高效地加载和预处理数据,如何实现多线程加载以提高训练速度,是优化PyTorch训练流程的重要一步。

深入理解PyTorch运行时模型

理解了这五个核心概念后,我们就可以更好地理解PyTorch的运行时模型。例如,考虑以下代码:

torch.nn.cross_entropy(model(images.cuda()), labels.cuda()).backward()

optimizer.step()

这短短两行代码背后,PyTorch实际上完成了以下步骤:

- 将图像和标签数据从CPU移动到GPU

- 通过模型运行前向传播

- 计算交叉熵损失

- 构建计算图

- 执行反向传播,计算所有参数的梯度

- 使用优化器更新模型参数

所有这些步骤都是异步在GPU上完成的,而Python解释器只需要发出几个简单的指令就可以触发大量的并行计算。这就是PyTorch能够如此高效的原因。

实践建议

要真正掌握PyTorch源码,光看是不够的,还需要动手实践。以下是一些建议:

-

跟随David Bau的Colab notebooks,亲自运行和修改代码。

-

尝试实现一些简单的深度学习算法,如线性回归或小型神经网络,不使用PyTorch的高级API,而是直接使用张量操作和自动微分。

-

阅读PyTorch官方文档中的从零开始实现自动求导教程,深入理解自动微分的原理。

-

尝试为PyTorch贡献代码,从简单的文档修复开始,逐步过渡到功能改进和bug修复。

-

参与PyTorch社区讨论,向其他开发者学习。

结语

阅读PyTorch源码是一个循序渐进的过程。通过理解张量运算、自动微分、优化器、神经网络模块和数据加载器这五个核心概念,我们就能逐步掌握这个强大框架的内部工作原理。记住,理解源码不是目的,而是让我们能够更好地使用PyTorch,开发更高效、更强大的深度学习模型。

正如David Bau所说:"The brevity of the code is what makes PyTorch code fun to write. But it also reflects why PyTorch can be so fast even though the Python interpreter is so slow." 理解这种简洁背后的复杂性,将使我们成为更好的深度学习工程师。

让我们一起深入PyTorch的世界,探索深度学习的无限可能吧! 🚀🔬🧠

参考资料: