InfLLM:让大语言模型突破长度限制的创新之举

在人工智能和自然语言处理领域,大语言模型(LLMs)已经成为许多实际应用的核心,特别是在处理长序列流式输入的场景中,如LLM驱动的智能代理。然而,现有的LLMs在处理超长序列时往往面临着严重的挑战。最近,来自清华大学自然语言处理实验室(THUNLP)的研究团队提出了一种名为InfLLM的创新方法,旨在解决这一问题,让LLMs能够有效处理极长序列,同时保持捕捉长距离依赖关系的能力。

现有LLMs的局限性

目前大多数LLMs都是在有限长度的序列上进行预训练的,这导致它们在面对超出训练长度的输入时会遇到严重的泛化问题。主要体现在两个方面:

- 域外问题:模型未见过如此长的序列,无法很好地理解和处理。

- 注意力分散:在极长序列中,模型难以聚焦关键信息,容易被无关内容干扰。

为了缓解这些问题,一些现有方法采用滑动注意力窗口或丢弃远距离token的策略来处理超长序列。但这些方法不可避免地会损失序列中的长距离依赖关系,从而影响模型对语义的深入理解。

InfLLM:突破性的解决方案

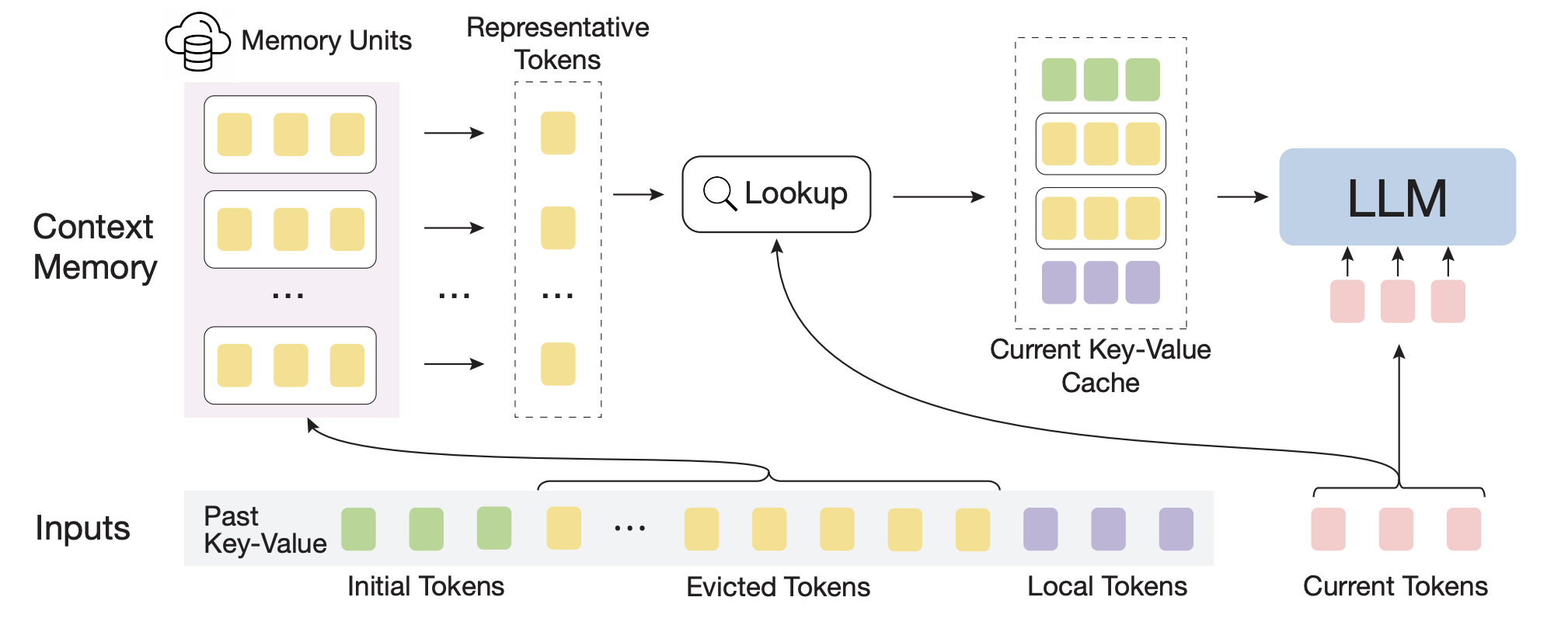

InfLLM提出了一种基于记忆的训练无关方法,巧妙地解决了上述问题。其核心思想是:

- 记忆单元存储:将远距离上下文存储到额外的记忆单元中。

- 高效检索机制:为注意力计算提供一种高效的机制,用于查找与当前token相关的记忆单元。

通过这种方式,InfLLM使LLMs能够高效处理长序列,同时保持捕捉长距离依赖关系的能力。最令人惊喜的是,InfLLM无需任何额外训练,就能让原本只在几千个token序列上预训练的LLMs在处理超长序列时取得优异表现,甚至超越了那些在长序列上持续训练的竞争基线模型。

InfLLM的技术细节

InfLLM的核心组件包括:

- 记忆单元:存储远距离上下文信息。

- 检索机制:根据当前token快速定位相关记忆单元。

- 注意力计算:结合本地上下文和检索到的记忆单元进行注意力计算。

具体实现中,InfLLM采用了以下关键策略:

- 初始token作为注意力汇聚点

- 本地滑动窗口

- Top-k检索:为每个token检索最相关的k个记忆单元

- 记忆单元表示:每个单元选择得分最高的若干个token作为代表元素

- GPU缓存策略:限制GPU内存中存储的最大记忆单元数量

- 执行块:每次查询一定数量的token作为执行单元

这些策略的结合使得InfLLM能够在保持高效率的同时,有效捕捉长距离依赖关系。

实验结果与性能评估

研究团队在多个基准测试上评估了InfLLM的性能,包括InfiniteBench和LongBench。实验结果表明:

- 无需额外训练,InfLLM就能让原本只在短序列上预训练的LLMs在处理超长序列时表现出色。

- 即使在序列长度达到1,024K token时,InfLLM仍能有效捕捉长距离依赖关系。

- 与需要在长序列上持续训练的竞争基线相比,InfLLM展现出了更优秀的性能。

这些结果充分证明了InfLLM在处理超长序列方面的卓越能力和潜力。

InfLLM的应用前景

InfLLM的出现为LLMs在多个领域的应用开辟了新的可能性:

- 长文本理解与生成:如长篇文学作品分析、学术论文撰写等。

- 对话系统:能够保持长时间上下文一致性的智能对话助手。

- 代码分析与生成:处理大型代码库,理解复杂的代码结构和依赖关系。

- 文档摘要:为长篇报告或文献生成准确而全面的摘要。

- 多模态应用:结合长文本和其他模态(如图像、视频)的复杂任务。

使用InfLLM

研究团队已经开源了InfLLM的代码,感兴趣的开发者和研究人员可以通过以下步骤尝试使用:

- 环境准备:确保满足所需的依赖,如PyTorch、Transformers等。

- 配置:使用YAML文件进行配置,可以在

config/目录找到示例配置。 - 评估:使用提供的脚本在InfiniteBench和LongBench数据集上进行评估。

- 聊天机器人:集成了fastchat的CLI聊天功能,可以快速搭建一个基于InfLLM的聊天机器人。

python -m inf_llm.chat \

--model-path mistralai/Mistral-7B-Instruct-v0.2 \

--inf-llm-config-path config/mistral-inf-llm.yaml

未来展望

尽管InfLLM已经展现出了令人瞩目的性能,但仍有一些值得探索的方向:

- 多GPU并行:目前的实现主要针对单GPU,未来可以探索如何在多GPU环境下更好地利用InfLLM。

- 记忆管理策略优化:进一步研究更高效的记忆单元存储和检索策略。

- 与其他技术的结合:探索InfLLM与其他先进技术(如稀疏注意力、模型压缩等)的结合可能性。

- 领域适应:研究如何让InfLLM更好地适应特定领域的长文本处理需求。

结语

InfLLM的提出无疑为解决LLMs处理超长序列的问题提供了一个强有力的解决方案。它不仅展示了令人印象深刻的性能,更重要的是,它为我们思考如何突破AI模型的既有限制提供了新的视角。随着研究的深入和技术的不断优化,我们有理由相信,InfLLM将在未来的AI应用中发挥越来越重要的作用,推动自然语言处理技术向着处理更长、更复杂的文本信息的方向不断前进。

对于研究人员和开发者而言,InfLLM提供了一个绝佳的机会来探索和实现更加强大的长文本处理能力。通过深入研究和应用InfLLM,我们可能会发现更多令人兴奋的可能性,为人工智能在理解和生成长文本方面开辟新的道路。

最后,让我们期待InfLLM及其背后的创新思想能够激发更多的研究灵感,推动大语言模型在处理长序列方面取得更大的突破,最终为用户带来更智能、更自然的语言交互体验。