ddpm-celebahq-256项目介绍

项目背景

ddpm-celebahq-256项目基于“去噪扩散概率模型”(Denoising Diffusion Probabilistic Models,简称DDPM),这是一种受非平衡热力学启发的隐变量模型。这种模型主要用于高质量的图像合成。项目的工作基础来源于一篇论文,“去噪扩散概率模型”,由Jonathan Ho、Ajay Jain和Pieter Abbeel共同撰写。

模型特点

该模型在训练时采用加权变分界,并结合扩散概率模型与Langevin动力学的去噪分值匹配。这使得模型不仅能够进行高质量的图像合成,还支持渐进式损失压缩,这可以被看作是自回归解码的一种推广。

在无条件的CIFAR10数据集上,ddpm模型达到了9.46的Inception分数以及3.17的现有最优FID分数。在256x256分辨率的LSUN数据集上,ddpm产生的样本质量与ProgressiveGAN相当。

推理过程

ddpm模型可以使用多种离散噪声调度器进行推理,例如:

其中,ddpm调度器生成的图像质量最高,但耗时最长。为了在质量和推理速度间取得平衡,可以考虑使用ddim或pndm调度器。

以下是一个简单的Python代码示例:

# !pip install diffusers

from diffusers import DDPMPipeline, DDIMPipeline, PNDMPipeline

model_id = "google/ddpm-celebahq-256"

# 加载模型和调度器

ddpm = DDPMPipeline.from_pretrained(model_id) # 你也可以替换为DDIMPipeline或PNDMPipeline以加快推理速度

# 在推理中运行管道(样本随机噪声并去噪)

image = ddpm()["sample"]

# 保存生成的图像

image[0].save("ddpm_generated_image.png")

更多详细信息可以参考官方推理示例。

训练过程

如果想要训练自己的模型,可以参考官方训练示例。

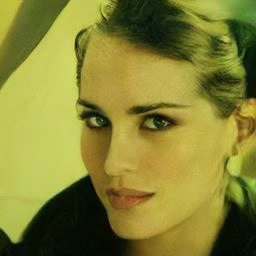

实例样本

以下是模型生成的一些图像示例:

这个项目展示了去噪扩散概率模型在图像合成领域的强大能力,同时提供了灵活的训练和推理选项,适合需要高质量图片生成的应用。

Github

Github Huggingface

Huggingface 论文

论文