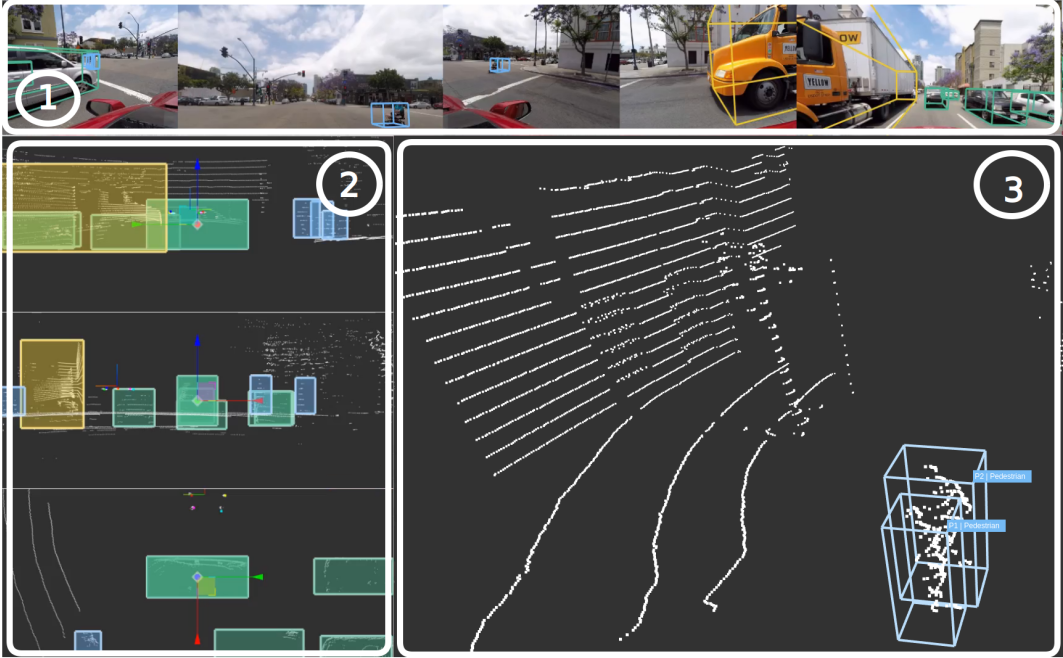

3D边界框标注工具箱

概览 ✨

新闻 📢

- 2024/02:论文被CVPR'24会议接收:TUMTraf V2X协同感知数据集

- 2024/01:支持主动学习。向IV'24会议提交论文:ActiveAnno3D - 多模态3D目标检测的主动学习框架

- 2023/09:🏆 在ITSC'23会议上获得IEEE最佳学生论文奖:TUMTraf交叉路口数据集:城市3D相机-LiDAR路侧感知所需的一切

- 2022/08:AI辅助标注功能

- 2022/04:论文被IV'22会议接收:A9数据集:基于多传感器基础设施的移动研究数据集

- 2021/02:更新版3D边界框标注工具箱(3D BAT 2021)

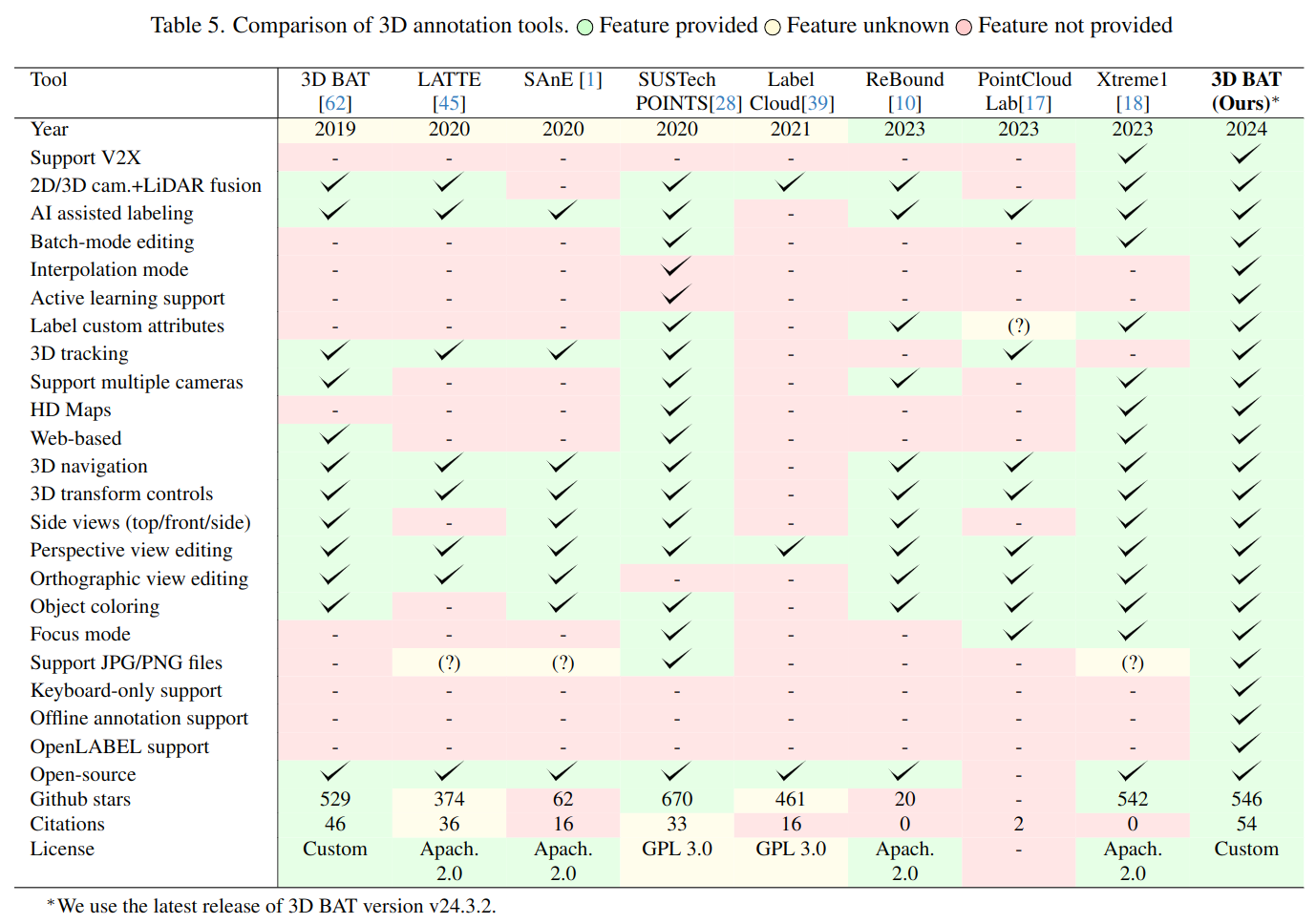

- 2019/04:论文被IV'19会议接收:3D BAT:用于全周围、多模态数据流的半自动、基于Web的3D标注工具箱

- 2019/03:3D边界框标注工具箱首次发布

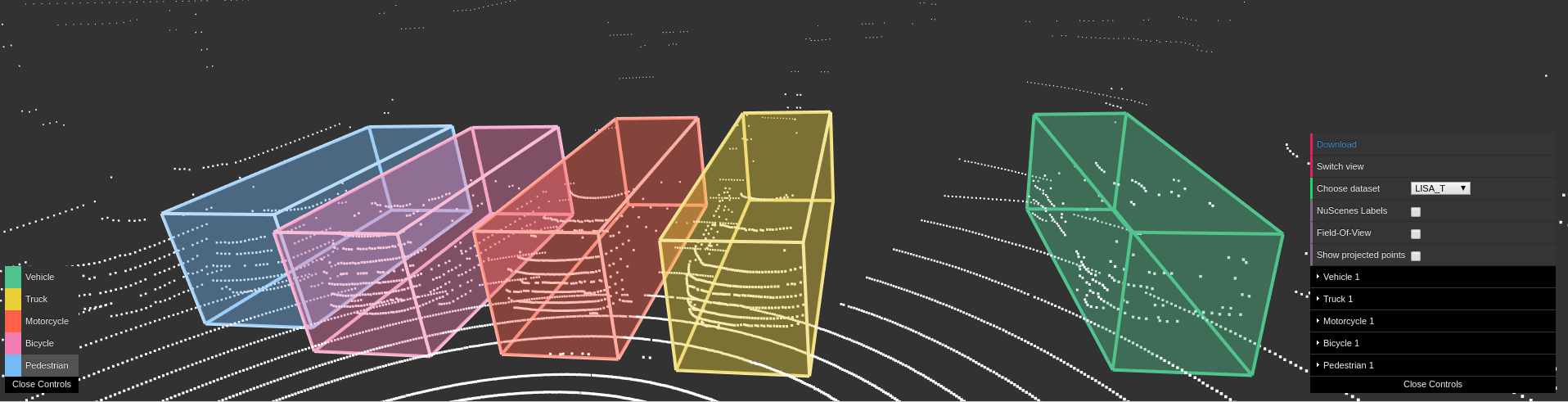

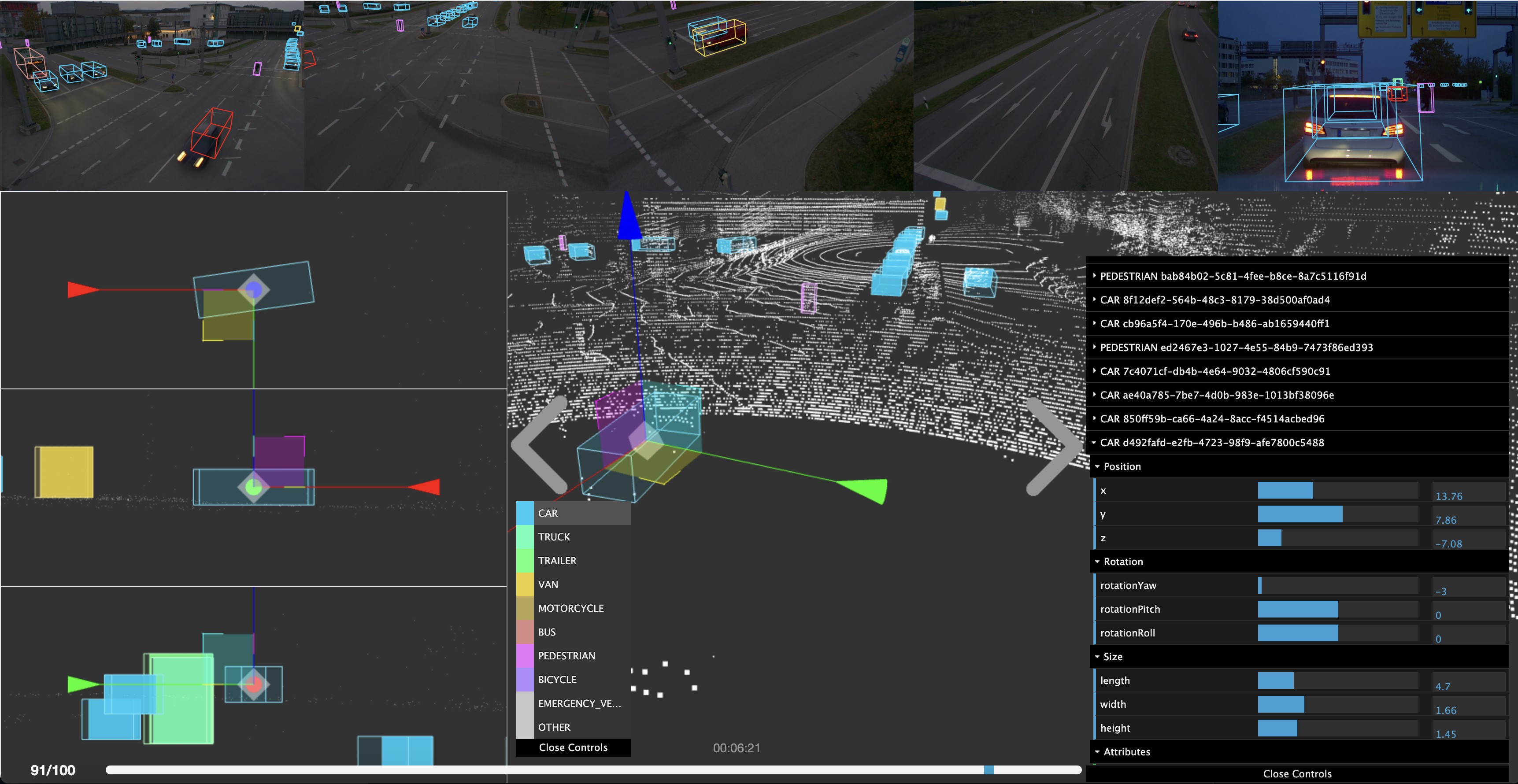

特性 🔥

- 全周围标注

- AI辅助标注

- 批量编辑模式

- 插值模式

- 3D到2D标签转换(投影)

- 自动跟踪

- 侧视图(俯视、正视、侧视)

- 3D导航

- 自动地面检测

- 3D变换控制

- 透视视图编辑

- 正交视图编辑

- 2D和3D标注

- 基于Web(在线访问和跨平台)

- 重做/撤销功能

- 仅键盘标注模式

- 自动保存功能

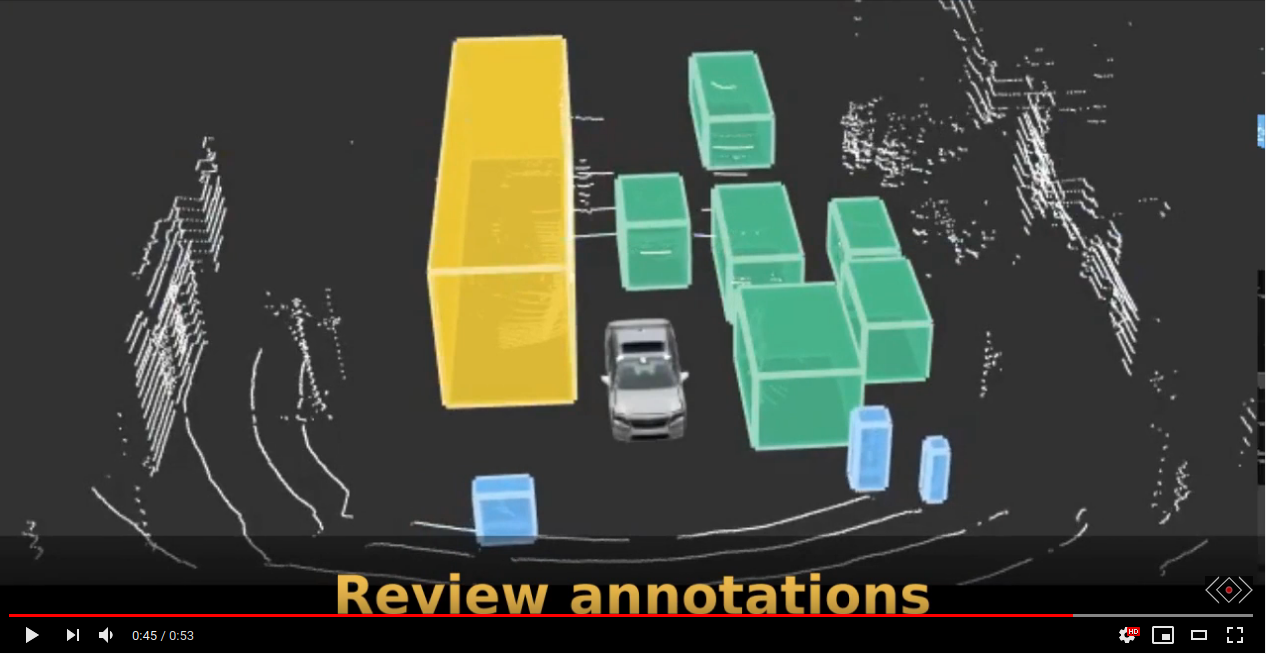

- 审核标注

- 序列模式

- 支持主动学习

- 支持高清地图

- 将标签复制到下一帧

- 在数据集和序列间切换

- 支持自定义数据集

- 支持自定义类别

- 支持自定义属性

- 支持V2X

- 支持OpenLABEL

- 支持多个传感器

- 对象着色

- 聚焦模式

- 支持JPG/PNG文件

- 支持离线标注

- 开源

- 可定制和可扩展

- 图像缩放

发布说明 📝

- 2024/03:3D BAT v24.3.2

- 增加标注V2X数据的支持

- 加载和显示高清地图

- 增加自定义对象类别的支持

- 增加自定义属性的支持

- 增加自定义数据集的支持

- 增加OpenLABEL的支持

- 增加主动学习的支持

- 增加AI辅助标注的支持

- 2019/02:3D BAT v19.2.1

- 首次发布,用于标注全周围车辆数据(3D到2D标签转换、侧视图、自动跟踪、插值模式、批量编辑模式)

快速开始 🚀

1. 安装npm

- Linux:

sudo apt-get install npm - Windows:https://nodejs.org/dist/v10.15.0/node-v10.15.0-x86.msi

- Mac:https://blog.teamtreehouse.com/install-node-js-npm-mac

2. 克隆仓库:

git clone https://github.com/walzimmer/3d-bat.git & cd 3d-bat

3. 安装所需的Python包:

conda create -n 3d-bat python==3.11.3

conda activate 3d-bat

pip install -r requirements.txt

conda install -c conda-forge nodejs==10.13.0

4. 安装所需的Node包:

npm install

5. 启动后端服务器

npm run start-server

6. 启动标注工具应用

npm run start

现在index.html文件应该会在指定的浏览器中打开(默认为chromium-browser)。

可以在package.json文件的第32行更改默认浏览器:

"start": "webpack serve --inline --open chromium-browser",

自定义数据标注 🌟

更多详细信息请参见自定义数据标注。

标注说明 🗒

数据标注说明可以在这里找到。

命令和快捷键 👨🏽💻

更多详细信息请参见命令和快捷键。

教程视频 📹

- 3D边界框标注工具箱 - 教程

- 更多教程视频可在

./tutorial_videos文件夹下找到。- 3D框变换(位置、旋转、缩放)

- 图像和点云标注

- 插值模式

- 使用侧视图(顶视图、前视图、侧视图)

- 重置和撤销/重做功能

📚 文档

readthedocs文档即将推出。

📝 引用

如果您在研究中使用3D边界框标注工具箱,请引用以下论文:

@inproceedings{zimmermann20193d,

title={3D BAT: A Semi-Automatic, Web-based 3D Annotation Toolbox for Full-Surround, Multi-Modal Data Streams},

author={Zimmer, Walter and Rangesh, Akshay and Trivedi, Mohan M.},

booktitle={2019 IEEE Intelligent Vehicles Symposium (IV)},

pages={1--8},

year={2019},

organization={IEEE}

}

@inproceedings{cress2022a9,

author={Creß, Christian and Zimmer, Walter and Strand, Leah and Fortkord, Maximilian and Dai, Siyi and Lakshminarasimhan, Venkatnarayanan and Knoll, Alois},

booktitle={2022 IEEE Intelligent Vehicles Symposium (IV)},

title={A9-Dataset: Multi-Sensor Infrastructure-Based Dataset for Mobility Research},

year={2022},

volume={},

number={},

pages={965-970},

doi={10.1109/IV51971.2022.9827401}

}

@inproceedings{zimmer2023tumtraf,

title={TUMTraf Intersection Dataset: All You Need for Urban 3D Camera-LiDAR Roadside Perception [Best Student Paper Award]},

author={Zimmer, Walter and Cre{\ss}, Christian and Nguyen, Huu Tung and Knoll, Alois C},

publisher = {IEEE},

booktitle={2023 IEEE Intelligent Transportation Systems ITSC},

year={2023}

}

@inproceedings{zimmer2024tumtrafv2x,

title={TUMTraf V2X Cooperative Perception Dataset},

author={Zimmer, Walter and Wardana, Gerhard Arya and Sritharan, Suren and Zhou, Xingcheng and Song, Rui and Knoll, Alois C.},

publisher={IEEE/CVF},

booktitle={2024 IEEE/CVF International Conference on Computer Vision and Pattern Recognition (CVPR)},

year={2024}

}

📜 许可证

版权所有 © 2019 加利福尼亚大学董事会

保留所有权利。特此授予许可,允许出于教育、研究和非营利目的复制、修改和分发此工具,无需费用,也无需书面协议,前提是上述版权声明、本段和以下三段出现在所有副本中。如需获得商业使用此软件的许可,请联系:

创新与商业化办公室

9500 Gilman Drive, Mail Code 0910

加利福尼亚大学

La Jolla, CA 92093-0910

(858) 534-5815

innovation@ucsd.edu

此工具的版权归加利福尼亚大学董事会所有。该代码"按原样"提供,不附带董事会的任何附带服务。董事会不保证工具的操作不会中断或无错误。最终用户理解该工具是为研究目的而开发的,建议不要出于任何原因完全依赖该工具。

在任何情况下,加利福尼亚大学均不对任何一方因使用此工具而造成的直接、间接、特殊、偶然或后果性损害(包括利润损失)负责,即使加利福尼亚大学已被告知可能发生此类损害。加利福尼亚大学特别声明不作任何保证,包括但不限于对适销性和特定用途适用性的暗示保证。此处提供的工具基于"按原样"的基础,加利福尼亚大学没有义务提供维护、支持、更新、增强或修改。