ModelMesh Serving

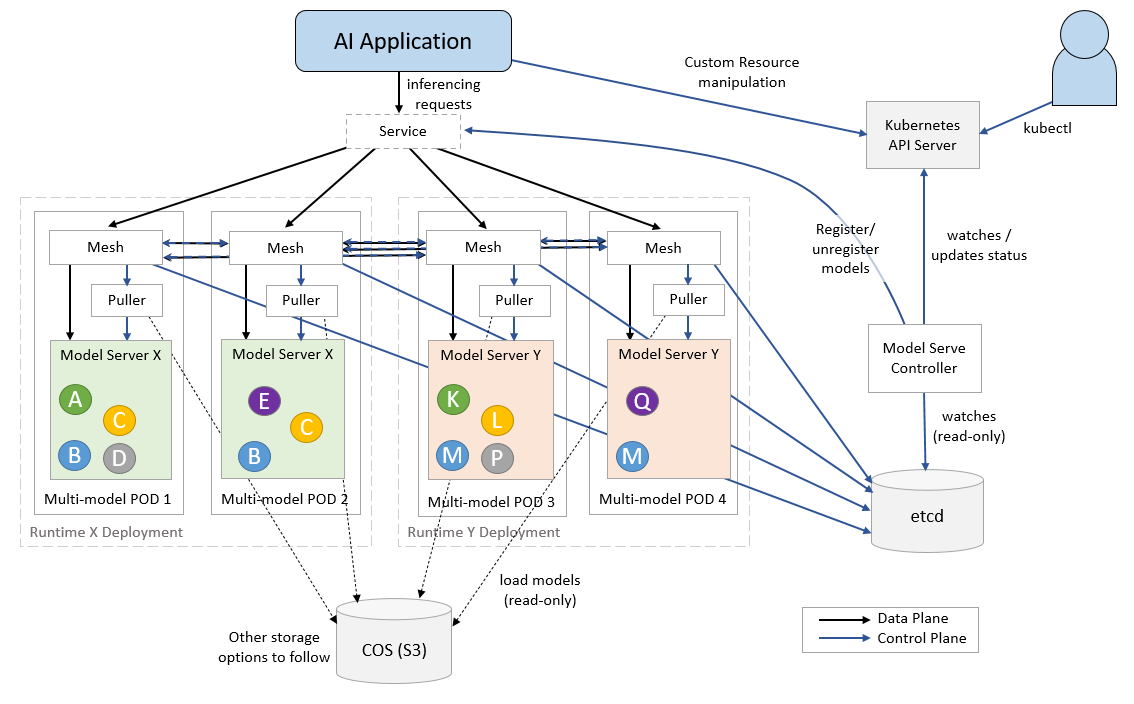

ModelMesh Serving 是用于管理 ModelMesh 的控制器,ModelMesh 是一个通用的模型服务管理/路由层。

入门

要快速开始使用 ModelMesh Serving,请查看快速入门指南。

如需帮助,请在此存储库中提出问题。

组件及其存储库

ModelMesh Serving 目前由分布在多个存储库中的组件组成。最新版本支持的组件版本在这里有详细说明。

所有组件的问题都在此存储库中集中跟踪。

核心组件

- https://github.com/kserve/modelmesh-serving(本存储库)- 模型服务控制器

- https://github.com/kserve/modelmesh - 用于编排模型部署和路由的 ModelMesh 容器

运行时适配器

- modelmesh-runtime-adapter - 在每个模型服务 Pod 中运行的容器,充当 ModelMesh 和第三方模型服务器容器之间的中介。其构建产生一个单一的"多用途"镜像,可用作适配器与开箱即用支持的每个模型服务器配合使用。它还包含"拉取器"逻辑,负责从存储中检索模型,然后将其交给相应的适配器逻辑来加载模型(并在卸载后删除)。该镜像还用于自定义

ServingRuntimePod 的加载/卸载路径中的容器,作为"独立"拉取器。

模型服务运行时

ModelMesh Serving 提供了以下模型服务器的开箱即用集成。

- triton-inference-server - Nvidia 的 Triton 推理服务器

- seldon-mlserver - Seldon 的 Python MLServer

- openVINO-model-server - OpenVINO 模型服务器

- torchserve - TorchServe

ServingRuntime 自定义资源可用于添加对其他现有或自定义构建的模型服务器的支持,请参阅实现自定义服务运行时的文档

补充

- KServe V2 REST 代理 - 一个反向代理服务器,将 RESTful HTTP API 转换为 gRPC。这允许使用 KServe V2 REST 预测协议向当前仅支持 V2 gRPC 预测协议的 ModelMesh 模型发送推理请求。

库

这些是 ModelMesh 组件使用的辅助 Java 库。

- kv-utils - 基于 etcd 和 Zookeeper 抽象的有用 KV 存储方案

- litelinks-core - 基于 Apache Thrift 的 RPC/服务发现库,仅用于 ModelMesh 内部通信。

贡献

请阅读我们的贡献指南以了解贡献的详细信息。

构建镜像

# 构建开发镜像

make build.develop

# 构建开发镜像后,构建运行时镜像

make build

访问官网

访问官网 Github

Github