Android语音活动检测(VAD)库:实现实时高效的语音识别

在移动应用开发中,语音识别和语音交互功能越来越受欢迎。然而,准确检测语音活动的开始和结束是实现高质量语音识别的关键挑战之一。为了解决这个问题,开发者gkonovalov推出了一个功能强大的Android语音活动检测(VAD)库,支持多种先进的VAD模型,为Android应用开发者提供了便捷高效的语音检测解决方案。

VAD库的主要特点

这个开源的Android VAD库具有以下几个突出特点:

-

支持多种VAD模型:包括基于高斯混合模型(GMM)的WebRTC VAD、基于深度神经网络(DNN)的Silero VAD和Yamnet VAD。

-

完全离线运行:所有处理都在移动设备上本地完成,无需网络连接。

-

实时处理:能够实时处理音频流,快速识别语音活动。

-

高度可定制:提供多种参数选项,可根据不同应用场景进行优化调整。

-

易于集成:提供简洁的API,可轻松集成到现有Android项目中。

支持的VAD模型详解

该库支持三种不同的VAD模型,每种模型都有其特点和适用场景:

-

WebRTC VAD

WebRTC VAD基于高斯混合模型(GMM),是一种轻量级但高效的VAD算法。它的主要特点是:

- 处理速度非常快

- 内存占用小,仅158KB

- 在区分噪音和静音方面表现出色

- 相比DNN模型,在区分语音和背景噪音时准确度较低

WebRTC VAD适用于对速度和资源消耗要求较高,但可以稍微牺牲一些准确度的场景。

-

Silero VAD

Silero VAD采用深度神经网络(DNN)模型,使用ONNX Runtime Mobile进行推理。其特点包括:

- 准确度非常高

- 处理速度接近WebRTC VAD

- 能更好地区分语音和背景噪音

Silero VAD适用于需要高准确度语音检测的应用场景。

-

Yamnet VAD

Yamnet VAD同样基于深度神经网络,采用Mobilenet_v1深度可分离卷积架构,使用TensorFlow Lite运行时。它的独特之处在于:

- 可以预测521种音频事件类别,包括语音、音乐、动物声音等

- 在AudioSet-YouTube语料库上训练

- 适用于需要更细粒度音频事件分类的场景

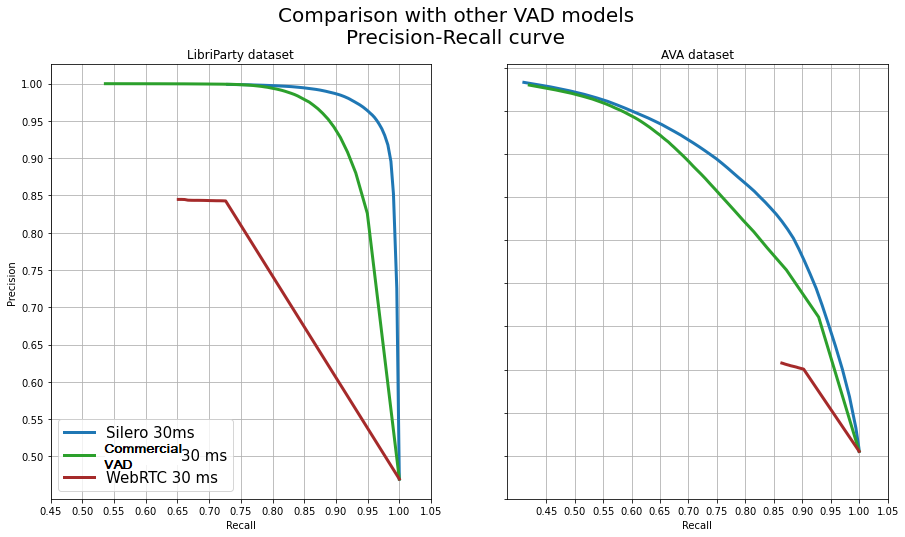

上图展示了不同VAD模型在准确度和速度上的对比。可以看出,Silero VAD在准确度和速度上都达到了很好的平衡。

如何使用VAD库

该VAD库提供了简洁易用的API,以下是几个主要模型的使用示例:

- WebRTC VAD使用示例(Kotlin):

VadWebRTC(

sampleRate = SampleRate.SAMPLE_RATE_16K,

frameSize = FrameSize.FRAME_SIZE_320,

mode = Mode.VERY_AGGRESSIVE,

silenceDurationMs = 300,

speechDurationMs = 50

).use { vad ->

val isSpeech = vad.isSpeech(audioData)

}

- Silero VAD使用示例(Kotlin):

VadSilero(

requireContext(),

sampleRate = SampleRate.SAMPLE_RATE_16K,

frameSize = FrameSize.FRAME_SIZE_512,

mode = Mode.NORMAL,

silenceDurationMs = 300,

speechDurationMs = 50

).use { vad ->

val isSpeech = vad.isSpeech(audioData)

}

- Yamnet VAD使用示例(Kotlin):

VadYamnet(

requireContext(),

sampleRate = SampleRate.SAMPLE_RATE_16K,

frameSize = FrameSize.FRAME_SIZE_243,

mode = Mode.NORMAL,

silenceDurationMs = 30,

speechDurationMs = 30

).use { vad ->

val sc = vad.classifyAudio("Speech", audioData)

when (sc.label) {

"Speech" -> println("语音检测到: " + sc.score)

else -> println("噪音检测到: " + sc.score)

}

}

集成到项目中

要将VAD库集成到您的Android项目中,只需在项目的build.gradle文件中添加以下依赖:

dependencies {

implementation 'com.github.gkonovalov.android-vad:webrtc:2.0.6'

implementation 'com.github.gkonovalov.android-vad:silero:2.0.6'

implementation 'com.github.gkonovalov.android-vad:yamnet:2.0.6'

}

总结

gkonovalov的Android VAD库为开发者提供了一个强大而灵活的工具,可以轻松实现高质量的语音活动检测。无论是需要快速轻量的WebRTC VAD,还是高准确度的Silero VAD,或是多功能的Yamnet VAD,开发者都可以根据具体需求选择合适的模型。这个库的开源性质也使得社区可以不断改进和扩展其功能,为Android平台上的语音识别应用开发提供了坚实的基础。

随着语音交互技术的不断发展,VAD技术在智能手机、智能家居、车载系统等领域都有广阔的应用前景。开发者可以基于这个库开发出各种创新的语音应用,如实时语音翻译、语音助手、语音控制等。同时,由于该库支持完全离线运行,也特别适合对隐私保护要求较高的应用场景。

未来,我们可以期待看到更多基于这个库的创新应用,以及库本身在性能、准确度和功能上的进一步提升。对于有兴趣深入研究或贡献代码的开发者,可以访问项目的GitHub仓库了解更多细节。

语音交互正在成为人机交互的重要方式之一,而高质量的VAD则是实现自然流畅语音交互的基础。借助这个功能丰富的Android VAD库,相信开发者们可以更容易地为用户打造出智能、便捷的语音应用体验。