MVSplat:从稀疏多视图图像高效生成3D高斯散射模型

近年来,3D场景重建和新视角合成技术取得了长足的进步。然而,如何从有限的输入视图高效地生成高质量的3D表示仍然是一个挑战。最近,研究人员提出了一种名为MVSplat的新方法,可以从稀疏的多视图图像中高效地预测3D高斯散射模型,为解决这一问题提供了新的思路。

MVSplat的核心思想

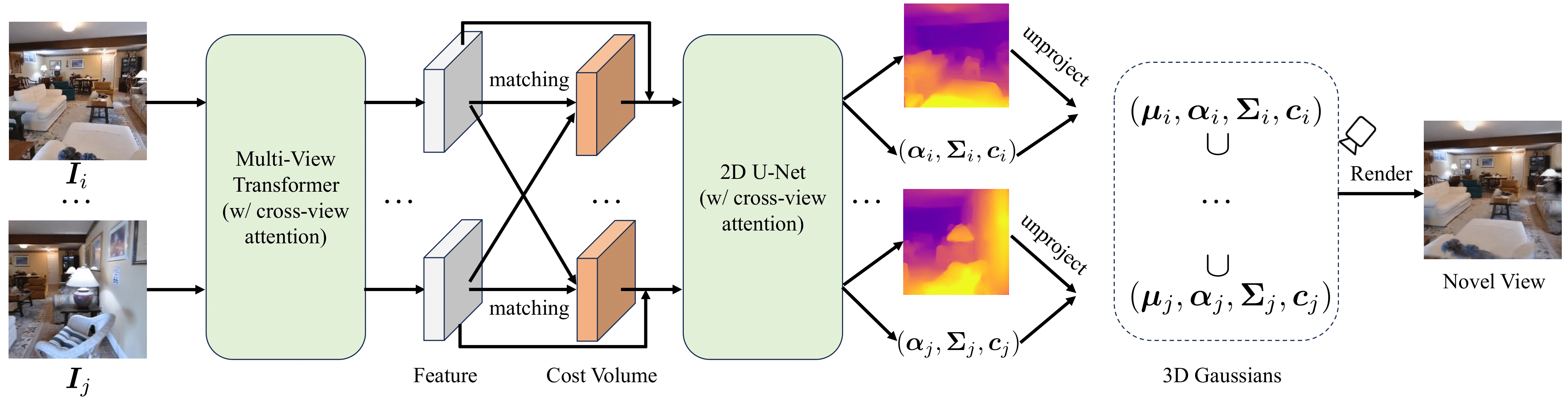

MVSplat的核心思想是利用平面扫描构建成本体积来准确定位高斯中心,并通过光度监督联合学习其他高斯参数。具体来说,该方法包括以下几个关键步骤:

-

多视图特征提取:使用多视图Transformer网络从输入图像中提取特征,该网络包含自注意力和交叉注意力层,可以在视图之间交换信息。

-

成本体积构建:通过平面扫描构建每个视图的成本体积,存储跨视图特征相似度信息,为深度估计提供几何线索。

-

深度估计:使用2D U-Net对成本体积进行细化,并预测每个视图的深度图。

-

高斯中心生成:将每个视图的深度图反投影到3D空间,并通过简单的并集操作合并为3D高斯中心。

-

高斯参数预测:与深度图一起联合预测不透明度、协方差和颜色等其他高斯参数。

-

新视角渲染:使用预测的3D高斯参数通过散射操作渲染新视角图像。

MVSplat的优势

与现有方法相比,MVSplat具有以下几个显著优势:

-

高效:MVSplat采用前向传播方式生成3D高斯,推理速度可达22 fps,比现有最先进方法快2倍以上。

-

轻量:模型参数量仅为现有方法的1/10,大大降低了存储和计算开销。

-

高质量:在RealEstate10K和ACID等大规模基准测试中,MVSplat在外观和几何质量上都优于现有方法。

-

泛化性强:在跨数据集泛化测试中,MVSplat展现出更好的迁移能力。

实验结果

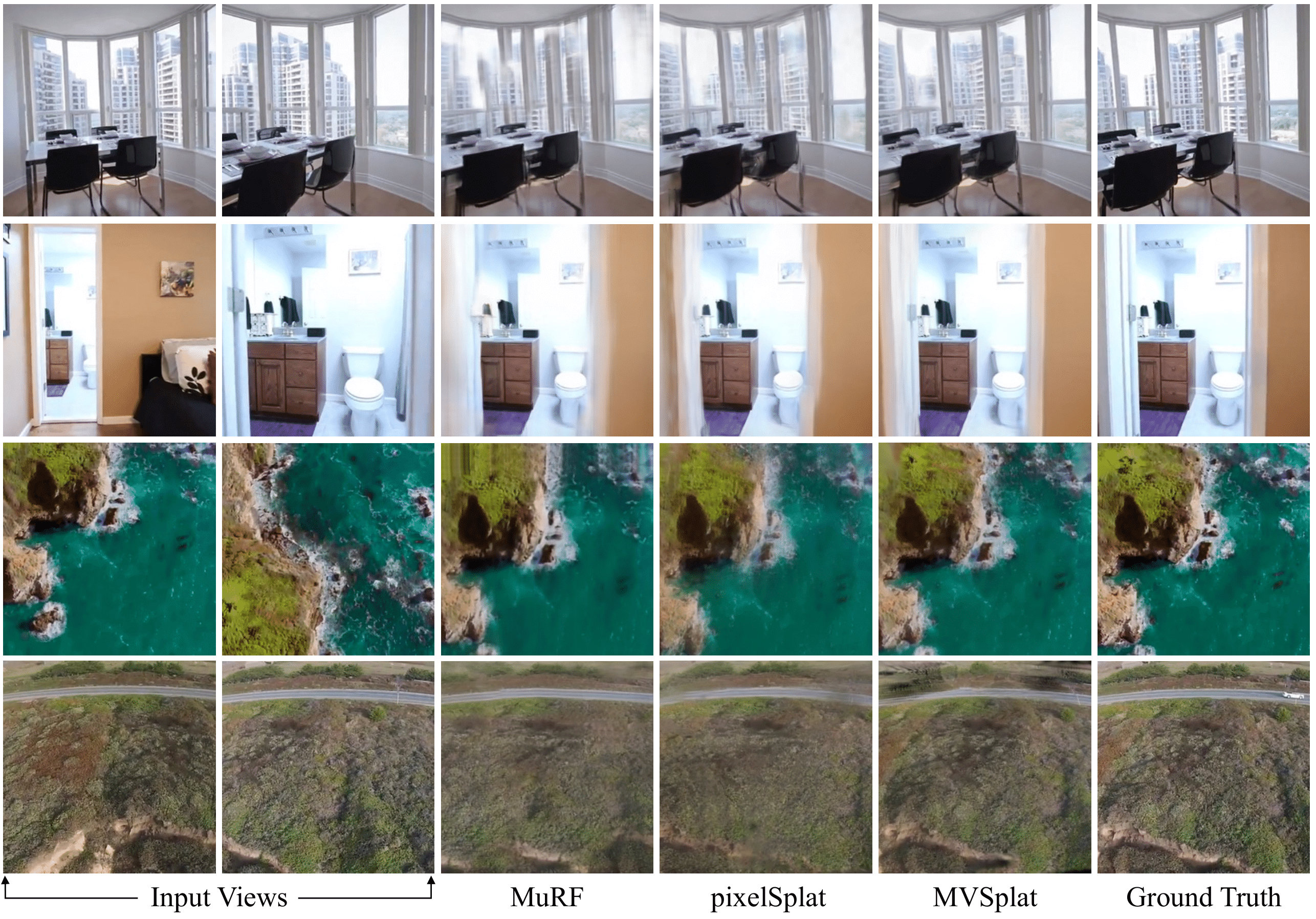

研究人员在多个数据集上进行了广泛的实验,以验证MVSplat的有效性。以下是一些主要的实验结果:

-

在RealEstate10K数据集上,MVSplat在PSNR、SSIM和LPIPS等指标上均优于现有方法,同时推理速度最快。

-

在ACID数据集上,MVSplat同样取得了最佳性能,特别是在几何重建质量方面的优势更为明显。

-

在跨数据集泛化测试中,MVSplat表现出色。例如,在RealEstate10K上训练并在DTU数据集上测试时,MVSplat的性能显著优于其他方法。

-

消融实验表明,成本体积表示对于准确定位高斯中心至关重要,对最终性能有显著影响。

MVSplat的应用前景

MVSplat为高效、高质量的3D场景重建和新视角合成提供了一种新的解决方案,具有广阔的应用前景:

-

虚拟现实和增强现实:可用于快速生成大规模、高质量的3D环境。

-

机器人导航:为机器人提供更准确的3D场景理解。

-

自动驾驶:有助于提升自动驾驶系统的环境感知能力。

-

电影和游戏制作:可用于快速生成虚拟场景和特效。

-

建筑和城市规划:为建筑设计和城市规划提供高效的3D可视化工具。

未来研究方向

尽管MVSplat取得了显著的进展,但仍有一些值得进一步探索的方向:

-

提高模型在动态场景中的适应性。

-

进一步优化网络结构,以在保持性能的同时减少计算复杂度。

-

探索如何更好地利用时序信息,特别是在视频数据上。

-

研究如何将MVSplat与其他3D表示方法(如NeRF)结合,发挥各自优势。

-

开发更多针对特定应用场景的优化策略。

结论

MVSplat为从稀疏多视图图像高效生成3D高斯散射模型提供了一种新的范式。通过巧妙地结合成本体积表示和光度监督,MVSplat在效率、质量和泛化性等方面都取得了显著的进步。这项研究不仅推动了3D场景重建和新视角合成技术的发展,也为相关领域的应用开辟了新的可能性。随着进一步的优化和改进,MVSplat有望在虚拟现实、机器人视觉等领域发挥更大的作用。

参考文献

[1] Chen, Y., Xu, H., Zheng, C., Zhuang, B., Pollefeys, M., Geiger, A., Cham, T.J., & Cai, J. (2024). MVSplat: Efficient 3D Gaussian Splatting from Sparse Multi-View Images. arXiv preprint arXiv:2403.14627.

[2] Wiles, O., Gkioxari, G., Szeliski, R., & Johnson, J. (2020). SynSin: End-to-end view synthesis from a single image. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 7467-7477).

[3] Mildenhall, B., Srinivasan, P.P., Tancik, M., Barron, J.T., Ramamoorthi, R., & Ng, R. (2020). NeRF: Representing scenes as neural radiance fields for view synthesis. In European conference on computer vision (pp. 405-421). Springer, Cham.

[4] Yu, A., Ye, V., Tancik, M., & Kanazawa, A. (2021). pixelNeRF: Neural radiance fields from one or few images. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 4578-4587).

[5] Kerbl, B., Kopanas, G., Leimkühler, T., & Drettakis, G. (2023). 3D Gaussian splatting for real-time radiance field rendering. ACM Transactions on Graphics (TOG), 42(4), 1-14.

致谢

本项目主要基于pixelSplat构建,并借鉴了UniMatch的多处代码片段。在此特别感谢这两个优秀项目的贡献!