Recurrent Memory Transformer: 突破长上下文处理的瓶颈

在自然语言处理领域,如何有效处理长文本一直是一个重要挑战。传统的Transformer模型虽然在多个任务上表现出色,但在处理长序列时却面临着严重的计算复杂度和内存消耗问题。为了突破这一限制,来自DeepPavlov.ai、AIRI和伦敦数学科学研究所的研究团队提出了一种创新的架构 - Recurrent Memory Transformer (RMT),为长上下文处理开辟了新的可能。

RMT的核心思想

Recurrent Memory Transformer的核心思想是将递归记忆机制引入到Transformer模型中。具体来说,RMT通过在输入序列中添加特殊的记忆token,使模型能够在处理长序列时存储和检索关键信息。这种方法不仅大大扩展了模型的有效上下文长度,还保持了较低的计算复杂度。

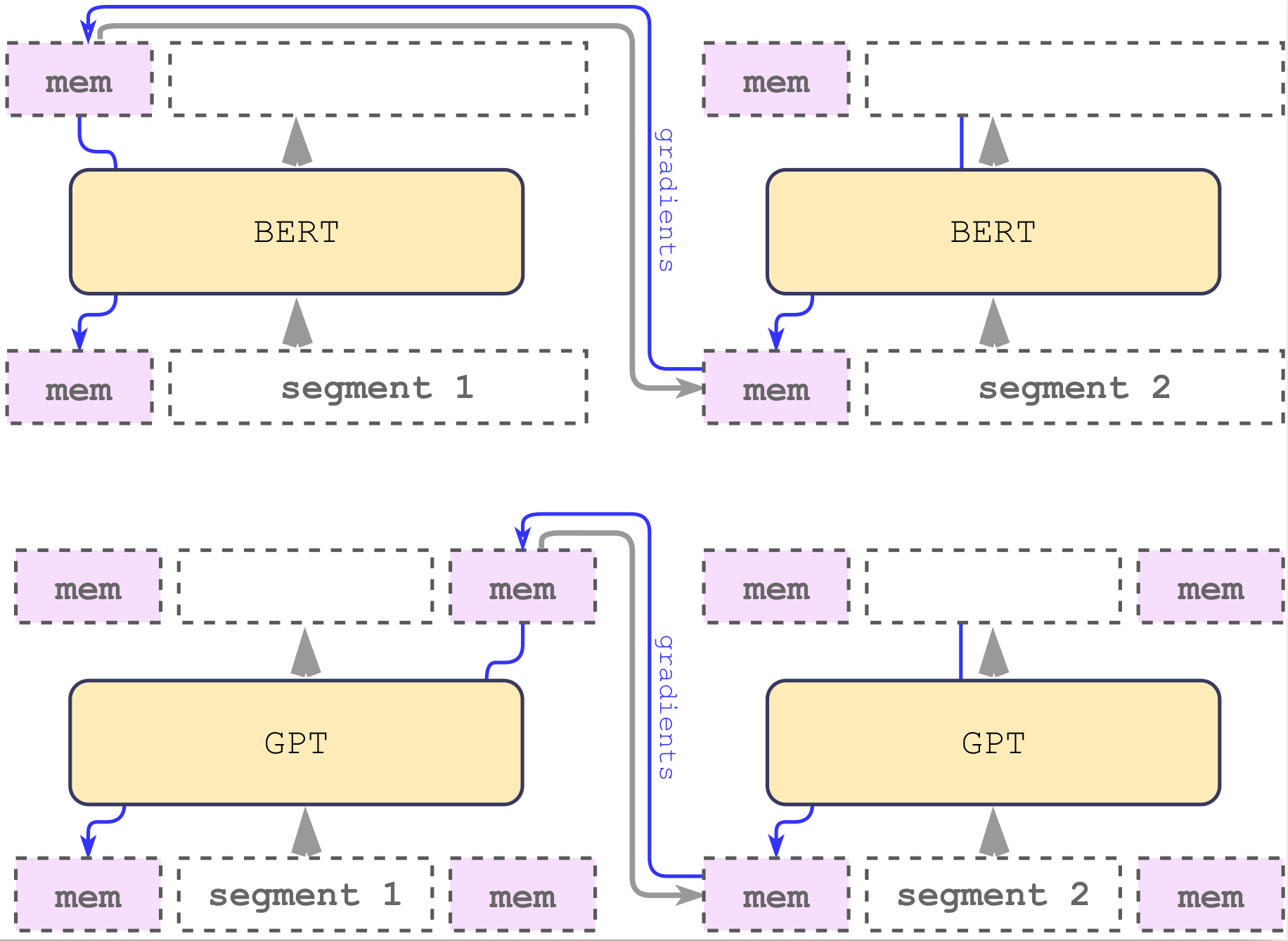

如上图所示,RMT的工作流程可以概括为以下几个步骤:

- 将长输入序列分割成多个段落

- 在每个段落的开头和结尾插入特殊的记忆token

- 模型处理每个段落时,能够通过这些记忆token存储和检索重要信息

- 记忆信息可以在不同段落之间传递,实现长距离依赖的建模

这种设计使得RMT能够在保持较低计算复杂度的同时,有效处理长达200万个token的序列,这是传统Transformer模型难以企及的。

RMT的突出优势

相比传统的Transformer模型,RMT具有以下几个突出优势:

-

超长上下文处理能力: RMT将有效上下文长度扩展到了200万个token,远超传统模型的几千个token限制。

-

高效的内存使用: 尽管处理超长序列,RMT的内存占用仅为3.6GB,这得益于其高效的记忆机制设计。

-

灵活的应用: RMT可以作为一个包装器应用于任何Hugging Face的预训练模型,无需改变原有模型结构。

-

出色的泛化能力: 实验表明,RMT在训练后能够很好地泛化到更长的序列上,甚至可以处理长度是训练时两倍的任务。

-

适应多种任务: RMT不仅在语言建模任务上表现出色,在如arXiv论文分类等下游任务中也展现了强大的性能。

RMT的实际应用

研究团队对RMT进行了广泛的实验和评估,以下是一些典型的应用场景:

-

语言建模: 在大规模语料上进行预训练,RMT展现出优于Transformer-XL等模型的性能。

-

长文本分类: 在arXiv论文分类任务中,RMT能够利用全文信息,显著提升分类准确率。

-

事实记忆与推理: 通过设计的记忆任务,RMT展示了长期记忆事实并进行推理的能力。

-

SCROLLS基准测试: 在这个专门用于评估长文本处理能力的基准上,RMT取得了competitive的结果。

RMT的技术细节

为了更好地理解RMT的工作原理,我们来深入探讨一些技术细节:

-

记忆Token设计: RMT在每个段落的开头和结尾插入特殊的记忆token。这些token在训练过程中学习捕获和传递关键信息。

-

分段处理机制: 长序列被分割成固定长度的段落(如512 token),每个段落独立通过Transformer层,但通过记忆token实现信息传递。

-

注意力机制优化: RMT优化了注意力计算,使得模型能够高效地在当前段落和记忆token之间进行信息交互。

-

梯度累积训练: 为了处理超长序列,RMT采用梯度累积技术,在多个步骤中累积梯度后再更新模型参数。

-

课程学习策略: 研究者发现,采用从短到长的课程学习策略可以显著提升RMT的训练效果和泛化能力。

RMT的局限性与未来展望

尽管RMT在长文本处理方面取得了突破性进展,但它仍然存在一些局限性:

-

训练复杂度: 处理超长序列需要大量的计算资源和时间,这可能限制其在资源受限环境下的应用。

-

模型大小: 为了达到最佳性能,RMT通常需要较大的模型规模,这可能增加部署难度。

-

特定任务优化: 虽然RMT在多个任务上表现出色,但对于某些特定任务可能还需要进一步的优化和调整。

展望未来,RMT为长文本处理开辟了新的研究方向。可能的发展包括:

- 进一步优化记忆机制,提高信息存储和检索的效率

- 探索RMT与其他技术(如稀疏注意力)的结合

- 将RMT应用于更多领域,如长视频理解、跨模态长序列处理等

结论

Recurrent Memory Transformer 无疑是自然语言处理领域的一项重要进展。它不仅突破了传统Transformer模型的长度限制,还为处理超长文本提供了一种高效、灵活的解决方案。随着further研究的深入,我们有理由相信RMT将在更多场景中发挥重要作用,推动AI技术在处理复杂、长文本任务方面的能力不断提升。

对于研究者和开发者而言,RMT提供了一个强大的工具,可以用于探索和解决各种长序列处理问题。随着其在GitHub上的开源实现不断完善,相信会有越来越多的创新应用涌现。而对于整个AI领域来说,RMT的成功也为我们提供了宝贵的启示:通过巧妙的架构设计,我们可以突破看似不可逾越的瓶颈,为AI的发展开辟新的可能性。