GLEE:大规模图像和视频通用目标基础模型

吴俊峰*,姜毅*,刘启豪,袁泽欢,白翔†,白松†

* 同等贡献,†通讯作者

[项目主页] [论文] [HuggingFace演示] [视频演示]

![PWC]

(https://yellow-cdn.veclightyear.com/835a84d5/ab1833a9-54eb-45df-b6f1-73fc1291f67c.svg?url=https://paperswithcode.com/badge/general-object-foundation-model-for-images/multi-object-tracking-on-tao)

[

亮点:

- GLEE被CVPR2024接受为亮点论文!

- GLEE是一个通用对象基础模型,在来自各种基准数据集的超过一千万张图像上进行联合训练,具有多样化的监督水平。

- GLEE能够同时处理广泛的以对象为中心的任务,同时保持最先进的性能。

- GLEE展示了卓越的多功能性和强大的零样本迁移能力,适用于各种对象级图像和视频任务,并能够作为基础组件来增强其他架构或模型。

我们将为GLEE发布以下内容:

- 演示代码

- 模型库

- 全面的用户指南

- 训练代码和脚本

- 详细的评估代码和脚本

- 在新数据集上零样本测试或微调GLEE的教程

入门指南

- 安装:更多详情请参考INSTALL.md。

- 数据准备:更多详情请参考DATA.md。

- 训练:更多详情请参考TRAIN.md。

- 测试:更多详情请参考TEST.md。

- 模型库:更多详情请参考MODEL_ZOO.md。

运行演示应用

试用我们的在线演示应用:[HuggingFace Demo]或在本地使用:

git clone https://github.com/FoundationVision/GLEE

# 支持CPU和GPU运行

python app.py

简介

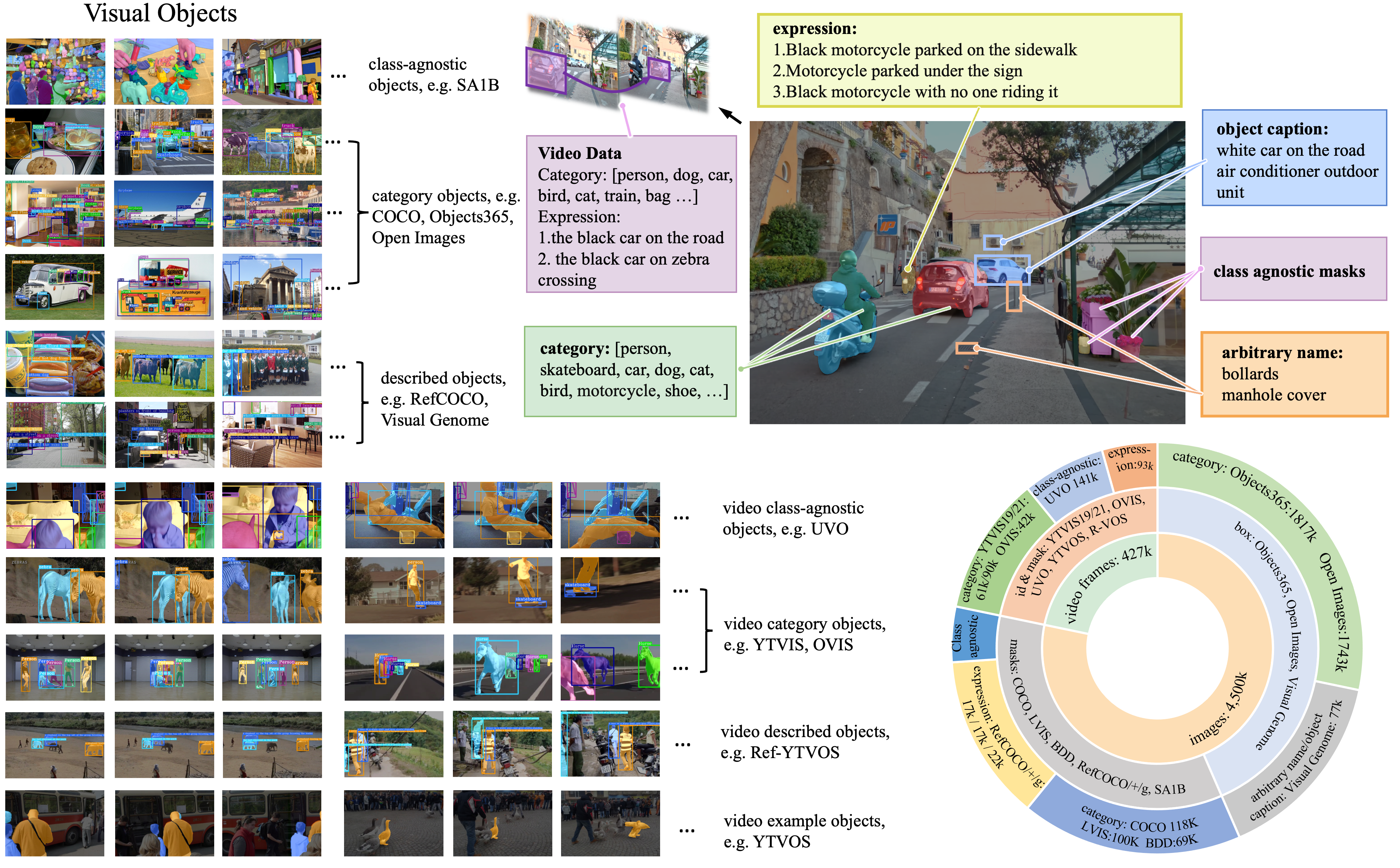

GLEE在来自16个数据集的超过一千万张图像上进行了训练,充分利用了现有的标注数据和具有成本效益的自动标记数据,构建了一个多样化的训练集。这种广泛的训练赋予了GLEE强大的泛化能力。

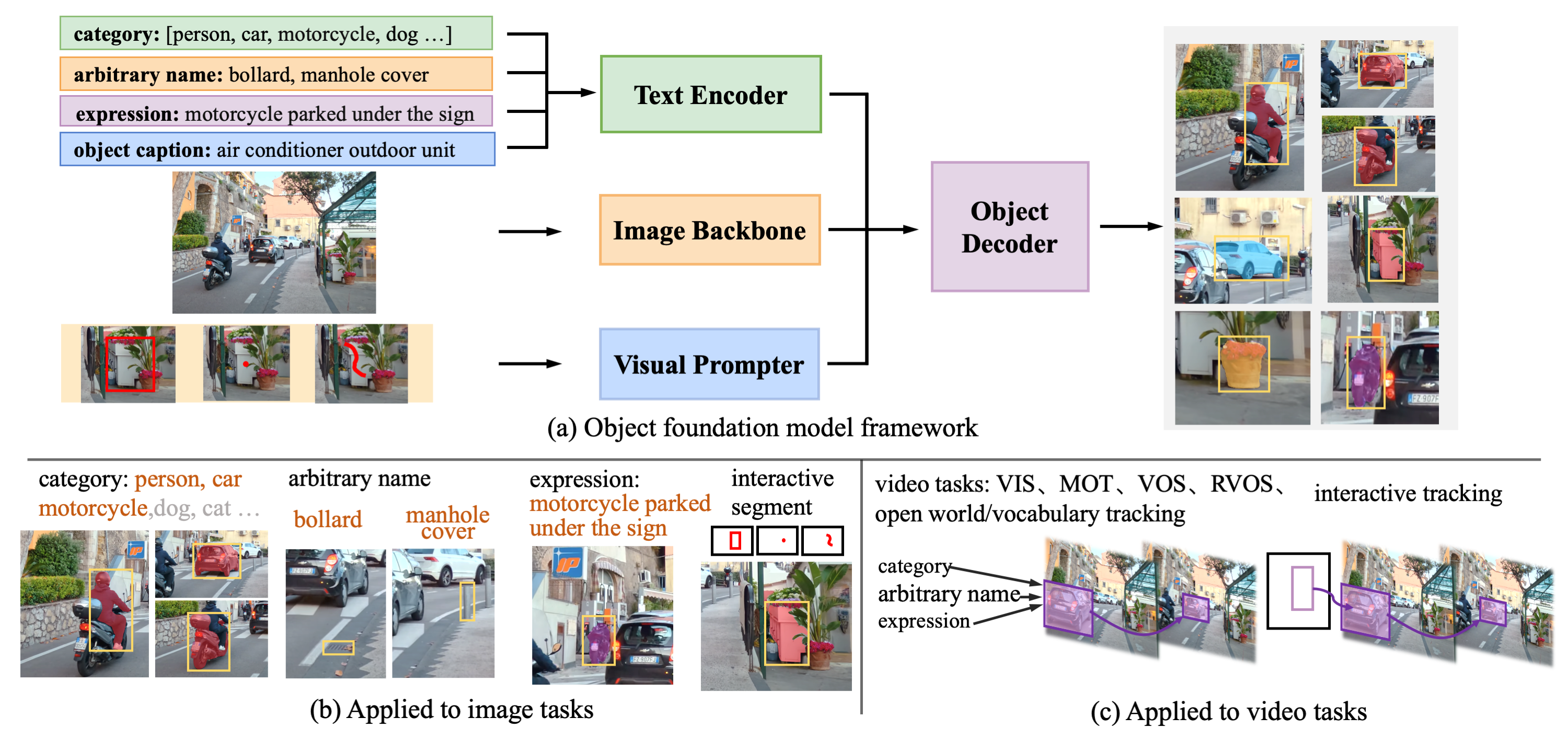

GLEE由图像编码器、文本编码器、视觉提示器和对象解码器组成,如图所示。文本编码器处理与任务相关的任意描述,包括1) 对象类别列表 2)任何形式的对象名称 3)关于对象的描述 4)指代表达。视觉提示器在交互式分割过程中将用户输入(如1) 点 2) 边界框 3) 涂鸦)编码为目标对象的相应视觉表示。然后,它们被集成到检测器中,根据文本和视觉输入从图像中提取对象。

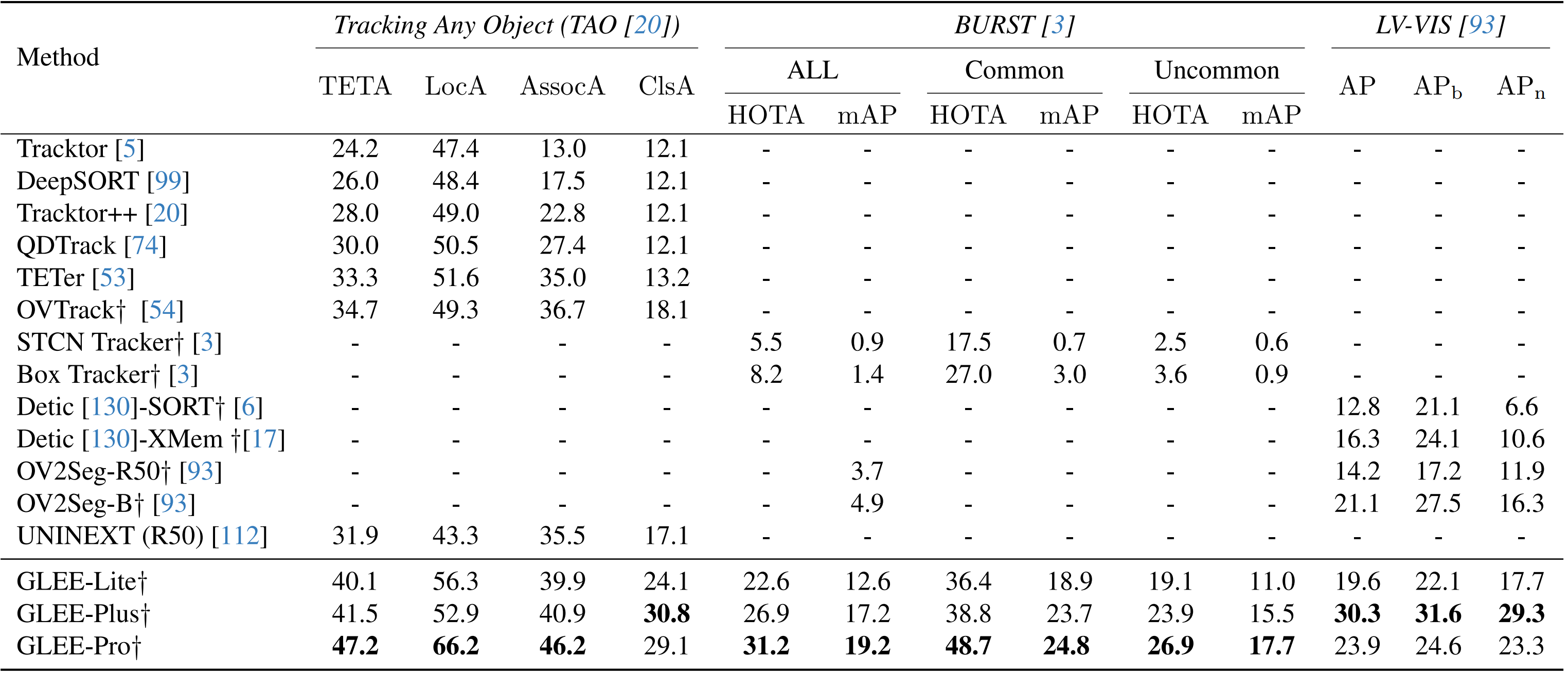

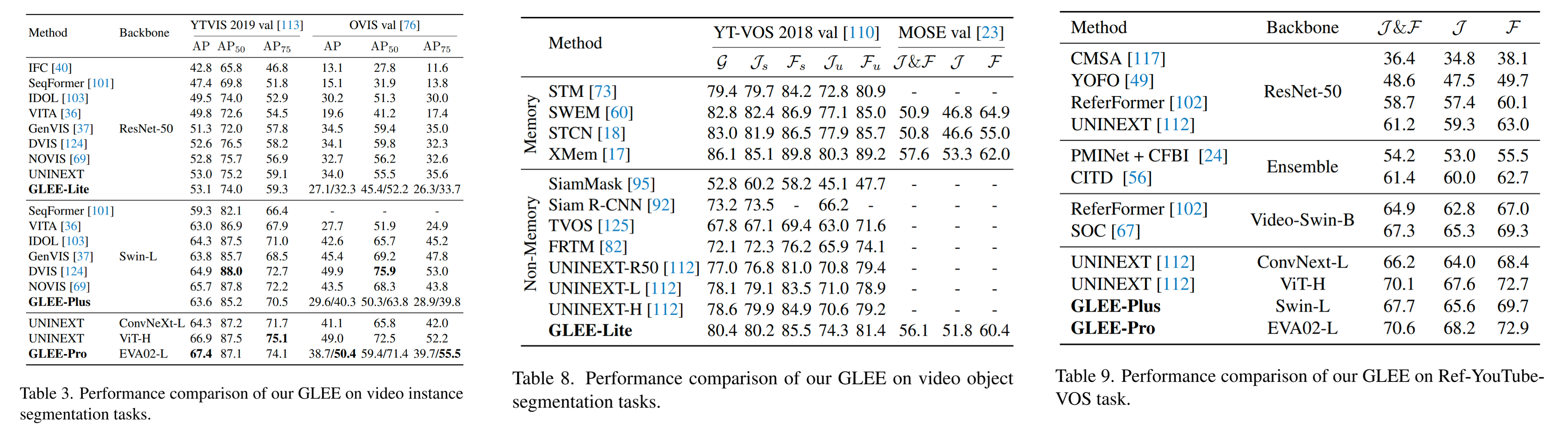

基于上述设计,GLEE可以无缝统一图像和视频中的广泛对象感知任务,包括对象检测、实例分割、定位、多目标跟踪(MOT)、视频实例分割(VIS)、视频对象分割(VOS)、交互式分割和跟踪,并支持开放世界/大词汇量图像和视频检测和分割任务。

结果

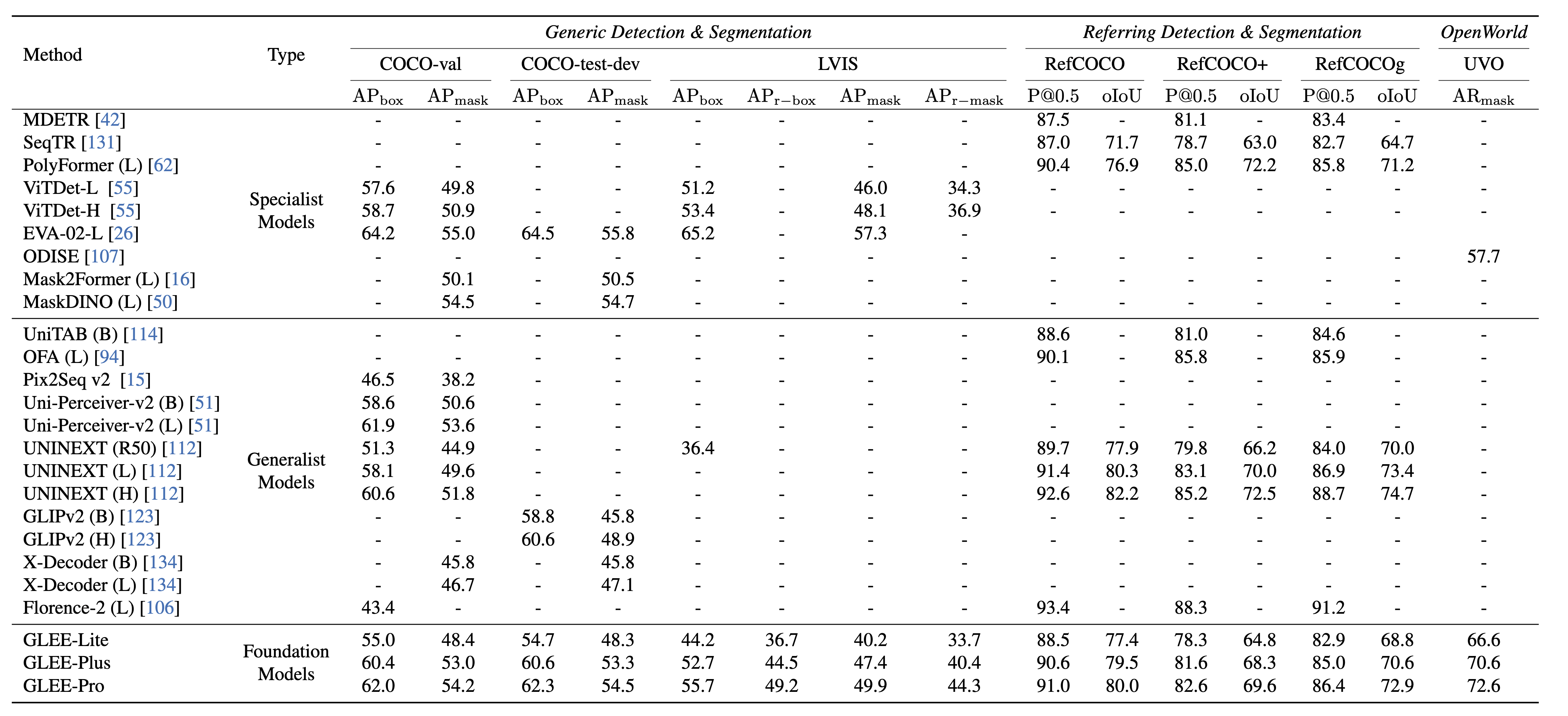

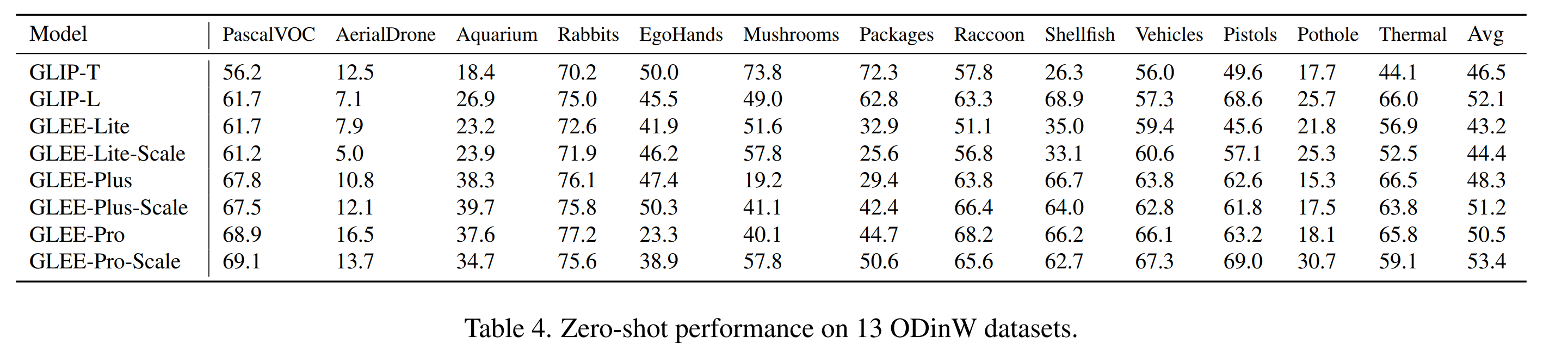

图像级任务

视频级任务

引用GLEE

@misc{wu2023GLEE,

author= {Junfeng Wu, Yi Jiang, Qihao Liu, Zehuan Yuan, Xiang Bai, Song Bai},

title = {General Object Foundation Model for Images and Videos at Scale},

year={2023},

eprint={2312.09158},

archivePrefix={arXiv}

}