DE⫶TR:使用Transformer的端到端目标检测

DETR(DEtection TRansformer)的PyTorch训练代码和预训练模型。 我们用Transformer替代了复杂的手工设计目标检测流程,并使用ResNet-50与Faster R-CNN相匹配,在COCO数据集上获得了42 AP的性能,同时计算量(FLOPs)减半,参数数量相同。仅用50行PyTorch代码即可实现推理。

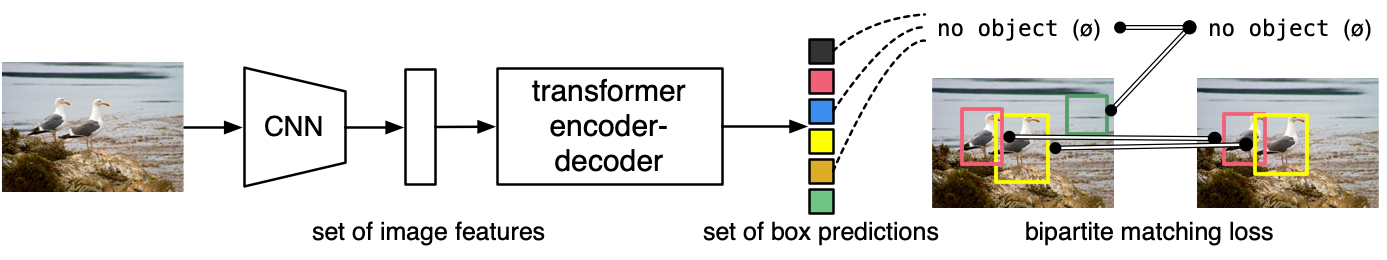

DETR简介。与传统计算机视觉技术不同,DETR将目标检测视为一个直接的集合预测问题。它包括一个基于集合的全局损失函数,通过二分图匹配强制生成唯一预测,以及一个Transformer编码器-解码器架构。 给定一组固定的少量学习到的目标查询,DETR推理物体之间的关系和全局图像上下文,直接并行输出最终的预测集合。由于这种并行特性,DETR非常快速且高效。

关于代码。我们认为目标检测不应比分类更困难,也不应需要复杂的库来进行训练和推理。 DETR实现和实验非常简单,我们提供了一个 独立的Colab笔记本 展示如何仅用几行PyTorch代码进行DETR推理。 训练代码遵循这一理念 - 它不是一个库, 而只是一个main.py文件,导入模型和准则定义, 使用标准训练循环。

此外,我们在d2/文件夹中提供了一个Detectron2封装器。有关更多信息,请参阅那里的readme。

详情请参阅Nicolas Carion、Francisco Massa、Gabriel Synnaeve、Nicolas Usunier、Alexander Kirillov和Sergey Zagoruyko的论文《使用Transformer的端到端目标检测》。

查看我们的博客文章以了解更多关于使用transformer进行端到端目标检测的信息。

模型库

我们提供基线DETR和DETR-DC5模型,并计划在未来包含更多模型。 AP是在COCO 2017 val5k上计算的,推理时间是在前100张COCO val5k图像上测量的, 使用torchscript transformer。

| 名称 | 骨干网络 | 训练轮数 | 推理时间 | 框AP | 链接 | 大小 | |

|---|---|---|---|---|---|---|---|

| 0 | DETR | R50 | 500 | 0.036 | 42.0 | 模型 | 日志 | 159Mb |

| 1 | DETR-DC5 | R50 | 500 | 0.083 | 43.3 | 模型 | 日志 | 159Mb |

| 2 | DETR | R101 | 500 | 0.050 | 43.5 | 模型 | 日志 | 232Mb |

| 3 | DETR-DC5 | R101 | 500 | 0.097 | 44.9 | 模型 | 日志 | 232Mb |

COCO val5k评估结果可以在这个gist中找到。

这些模型也可以通过torch hub获取, 要加载预训练的DETR R50模型,只需执行:

model = torch.hub.load('facebookresearch/detr:main', 'detr_resnet50', pretrained=True)

COCO全景分割val5k模型:

| 名称 | 骨干网络 | 框AP | 分割AP | PQ | 链接 | 大小 | |

|---|---|---|---|---|---|---|---|

| 0 | DETR | R50 | 38.8 | 31.1 | 43.4 | 下载 | 165Mb |

| 1 | DETR-DC5 | R50 | 40.2 | 31.9 | 44.6 | 下载 | 165Mb |

| 2 | DETR | R101 | 40.1 | 33 | 45.1 | 下载 | 237Mb |

查看我们的全景分割colab 以了解如何使用和可视化DETR的全景分割预测。

笔记本

我们提供了几个colab笔记本,帮助您了解DETR:

- DETR实践Colab笔记本:展示如何从hub加载模型、生成预测,然后可视化模型的注意力(类似于论文中的图表)

- 独立Colab笔记本:在这个笔记本中,我们演示如何用50行Python代码从头实现DETR的简化版本,然后可视化预测结果。如果您想更好地理解架构并在深入研究代码库之前进行探索,这是一个很好的起点。

- 全景分割Colab笔记本:演示如何使用DETR进行全景分割并绘制预测结果。

使用方法 - 目标检测

DETR没有额外的编译组件,包依赖最小化, 因此代码使用非常简单。我们提供了通过conda安装依赖项的说明。 首先,在本地克隆仓库:

git clone https://github.com/facebookresearch/detr.git

然后,安装PyTorch 1.5+和torchvision 0.6+:

conda install -c pytorch pytorch torchvision

安装pycocotools(用于COCO评估)和scipy(用于训练):

conda install cython scipy

pip install -U 'git+https://github.com/cocodataset/cocoapi.git#subdirectory=PythonAPI'

就这样,应该可以训练和评估检测模型了。

(可选)要进行全景分割,请安装panopticapi:

pip install git+https://github.com/cocodataset/panopticapi.git

数据准备

从 http://cocodataset.org 下载并解压 COCO 2017 训练集和验证集图像及其注释。 我们期望目录结构如下:

path/to/coco/

annotations/ # 注释 json 文件

train2017/ # 训练集图像

val2017/ # 验证集图像

训练

要在单个节点上使用 8 个 GPU 训练基线 DETR 模型 300 个 epoch,请运行:

python -m torch.distributed.launch --nproc_per_node=8 --use_env main.py --coco_path /path/to/coco

单个 epoch 需要 28 分钟,因此 300 个 epoch 的训练在单台配备 8 张 V100 显卡的机器上大约需要 6 天。 为了便于复现我们的结果,我们提供了 150 个 epoch 训练计划(单机 3 天)的结果和训练日志,达到了 39.5/60.3 AP/AP50。

我们使用 AdamW 优化器训练 DETR,transformer 的学习率设为 1e-4,backbone 的学习率设为 1e-5。 数据增强使用了水平翻转、缩放和裁剪。 图像被重新缩放,使最小边为 800,最大边为 1333。 transformer 使用 0.1 的 dropout 进行训练,整个模型使用 0.1 的梯度裁剪进行训练。

评估

要在单个 GPU 上评估 COCO val5k 数据集上的 DETR R50 模型,请运行:

python main.py --batch_size 2 --no_aux_loss --eval --resume https://dl.fbaipublicfiles.com/detr/detr-r50-e632da11.pth --coco_path /path/to/coco

我们在这个 gist 中提供了所有 DETR 检测模型的结果。 请注意,结果会因每个 GPU 的批次大小(图像数量)而有所不同。 非 DC5 模型使用批次大小 2 进行训练,DC5 模型使用批次大小 1, 因此如果使用每个 GPU 超过 1 张图像进行评估,DC5 模型的 AP 会显著下降。

多节点训练

通过 Slurm 和 submitit 可以进行分布式训练:

pip install submitit

在 4 个节点上训练基线 DETR-6-6 模型 300 个 epoch:

python run_with_submitit.py --timeout 3000 --coco_path /path/to/coco

使用方法 - 分割

我们展示了将 DETR 扩展到预测分割掩码相对简单。我们主要展示了强大的全景分割结果。

数据准备

对于全景分割,除了 coco 数据集(见上文的 coco 数据集)外,还需要全景注释。您需要下载并解压全景注释。 我们期望目录结构如下:

path/to/coco_panoptic/

annotations/ # 注释 json 文件

panoptic_train2017/ # 训练集全景注释

panoptic_val2017/ # 验证集全景注释

训练

我们建议分两个阶段训练分割:首先训练 DETR 检测所有边界框,然后训练分割头。 对于全景分割,DETR 必须学会检测stuff和things类别的边界框。您可以在单个节点上使用 8 个 GPU 训练 300 个 epoch:

python -m torch.distributed.launch --nproc_per_node=8 --use_env main.py --coco_path /path/to/coco --coco_panoptic_path /path/to/coco_panoptic --dataset_file coco_panoptic --output_dir /output/path/box_model

对于实例分割,您可以简单地训练一个普通的边界框模型(或使用我们提供的预训练模型)。

一旦您有了边界框模型检查点,您需要冻结它,然后单独训练分割头。 对于全景分割,您可以在单个节点上使用 8 个 GPU 训练 25 个 epoch:

python -m torch.distributed.launch --nproc_per_node=8 --use_env main.py --masks --epochs 25 --lr_drop 15 --coco_path /path/to/coco --coco_panoptic_path /path/to/coco_panoptic --dataset_file coco_panoptic --frozen_weights /output/path/box_model/checkpoint.pth --output_dir /output/path/segm_model

仅对于实例分割,只需从上述命令行中删除 dataset_file 和 coco_panoptic_path 参数即可。

许可证

DETR 根据 Apache 2.0 许可证发布。请查看 LICENSE 文件以获取更多信息。

贡献

我们欢迎您的 pull request!请查看 CONTRIBUTING.md 和 CODE_OF_CONDUCT.md 以获取更多信息。

Github

Github 文档

文档 论文

论文