ALLaVA:利用GPT4V合成数据打造轻量级视觉语言模型

⚡ALLaVA是一个项目,提供大规模GPT4V合成数据集用于训练轻量级视觉语言模型。⚡

🤗 ALLaVA-Phi3-mini-128k • 🤗 ALLaVA-StableLM2-1_6B • 🤗 ALLaVA-Phi2-2_7B

✨ 更新

- [2024/03/01]: **ALLaVA-3B-Longer(推荐)**和ALLaVA-3B的Hugging Face仓库已更新,现在支持使用

from_pretrained方法加载模型。 - [2024/02/29]: ALLaVA-4V数据集的Hugging Face仓库和下载脚本已更新。

📚 ALLaVA-4V数据

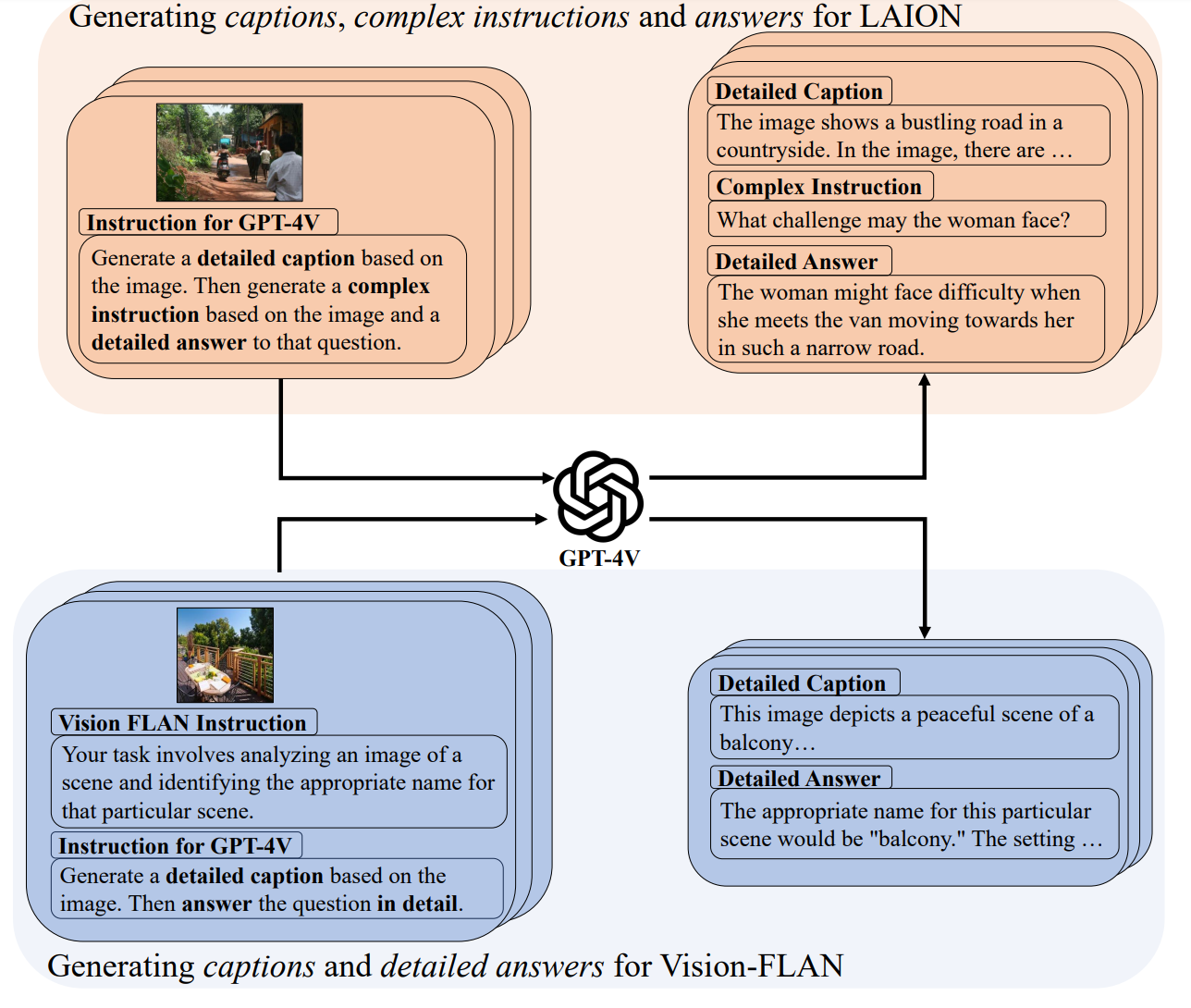

生成流程

- LAION

我们利用出色的GPT-4V生成图片说明和复杂推理问答对。提示词在这里。

- Vision-FLAN

我们利用出色的GPT-4V为原始指令生成图片说明和详细回答。提示词在这里。

- Wizard

我们使用GPT-4-Turbo重新生成Wizard_evol_instruct的回答。

数据集卡片

所有数据集可以在这里找到。 命名结构如下:

ALLaVA-4V

├── ALLaVA-Caption-4V

│ ├── ALLaVA-Caption-LAION-4V

│ └── ALLaVA-Caption-VFLAN-4V

├── ALLaVA-Instruct-4V

│ ├── ALLaVA-Instruct-LAION-4V

│ └── ALLaVA-Instruct-VFLAN-4V

├── Evol-Instruct-GPT4-Turbo-143K

Hugging Face数据集空间的文件夹结构:

ALLaVA-4V

├── allava_laion/

│ ├── ALLaVA-Caption-LAION-4V.json

│ ├── ALLaVA-Instruct-LAION-4V.json

| └── images.zip

├── allava_vflan/

│ ├── ALLaVA-Caption-VFLAN-4V.json

│ └── ALLaVA-Instruct-VFLAN-4V.json

├── allava_text/

│ └── Evol-Instruct-GPT4-Turbo-143K.json

我们不拥有"images.zip"文件中包含的任何图像的权利。我们应社区要求收集这些图像并上传此文件,以便于数据准备过程。

以下我们提供每个子集的详细信息。

| 名称 | 样本数量 | 图像来源 | 指令来源 | 答案来源 |

|---|---|---|---|---|

| ALLaVA-Caption-LAION-4V* | 505,588 | LAION (网络) | 手工制作 | GPT-4V |

| ALLaVA-Caption-VFLAN-4V** | 202,552 | Vision FLAN | 手工制作 | GPT-4V |

| ALLaVA-Instruct-LAION-4V* | 505,588 | LAION (网络) | GPT-4V | GPT-4V |

| ALLaVA-Instruct-VFLAN-4V** | 203,065 | Vision FLAN | Vision FLAN *** | GPT-4V |

| Evol-Instruct-GPT4-Turbo-143K | 143,000 | / | Wizard | GPT-4-Turbo |

*ALLaVA-Caption-LAION-4V 和 ALLaVA-Instruct-LAION-4V 使用相同的图像集。

**ALLaVA-Caption-VFLAN-4V 和 ALLaVA-Instruct-VFLAN-4V 使用相同的图像集。

***在 ALLaVA-Caption-VFLAN-4V 和 ALLaVA-Instruct-VFLAN-4V 中,我们还额外包含了30K个样本,这些样本是按照与LAION相同的方式蒸馏得到的(即蒸馏标题和复杂推理问答对)。我们将它们与其他指令来自原始VFLAN的数据混合在一起。

数据准备

LAION

在 ./download/download_laion.sh 中指定 laion_root 并运行

sh ./download/download_laion.sh

VFLAN

在 ./download/download_vflan.sh 中指定 vflan_root 并运行

sh ./download/download_vflan.sh

Evol-Instruct-GPT4-Turbo-143K

在 ./download/download_text.sh 中指定 text_root 并运行

sh ./download/download_text.sh

样本演示

ALLaVA-Caption-LAION-4V

{

"id": "allava_laion_cap_100277305",

"image": "allava_laion/images/100277305.jpeg",

"conversations": [

{

"from": "human",

"value": "<image>\n请用文字描述这张图片。"

},

{

"from": "gpt",

"value": "图片展示了一枚银色戒指,其设计类似于一片风格化的叶子。叶子设计被分成两个对称的半边,中间由一条沿着戒指环的缝隙分开。叶子图案的每一半都有纹理,呈现出细致的叶脉状纹路,使其看起来非常逼真。叶子设计的边缘镶嵌着小而透明的宝石,可能是钻石,为戒指增添了闪耀感。戒指的戒环较宽,支撑着大片的叶子图案,并且随着远离叶子设计的部分略微变窄。银色金属经过高度抛光,能明亮地反射光线,与叶子表面的纹理形成对比。这件作品的工艺展现了有机灵感与优雅触感的结合,这种优雅感来自于宝石的点缀。"

}

],

"original_caption": "190952cz Pandora热带棕榈叶戒指",

"url": "https://theartofpandora.com/wp-content/uploads/2016/10/190952CZ-1-600x600.jpg"

}

ALLaVA-Caption-VFLAN-4V

{

"id": "allava_vflan_cap_100000",

"image": "allava_vflan/images/images_191task_1k/PACS+guitar_image_category_classification_830_n03272010_10795-5.png",

"conversations": [

{

"from": "human",

"value": "<image>\n你会如何向一个看不见图片的人描述这张图片?"

},

{

"from": "gpt",

"value": "这张图片展示了一幅简单的电吉他线条画。吉他从图片左上角斜向右下角摆放。它有一个细长的琴颈,顶部有调音钮,整体呈现出一个风格化的"T"形状。吉他的琴身不规则,琴颈两侧各有一个切口,使其看起来不对称。琴身的特点是有锐角而不是曲线,这与大多数吉他不太一样。琴身上有四条横线,可能代表琴弦。这幅画是黑白的,没有阴影或颜色,看起来像是用一条连续的线手绘而成,没有太多细节。背景是纯白色的。"

}

]

}

ALLaVA-Instruct-LAION-4V

{

"id": "allava_laion_inst_100277305",

"image": "allava_laion/images/100277305.jpeg",

"conversations": [

{

"from": "human",

"value": "<image>\n宝石的加入如何影响了戒指的整体美感和可能的价值?"

},

{

"from": "gpt",

"value": "在叶子设计边缘加入宝石提升了戒指的美感,为其增添了一丝光彩和奢华感。这些小而透明的宝石能够捕捉光线,产生闪烁效果,与银色抛光表面和叶子纹理细节形成对比。这种闪耀的点缀可能增加了戒指作为配饰的视觉吸引力,使其更加引人注目。在价值方面,宝石(可能是钻石)的存在很可能提高了戒指的货币价值。宝石,尤其是钻石,因其美丽和耐久性而备受珍视,将它们加入珠宝作品通常意味着该物品的品质和档次更高,从而提升其市场价值。"

}

],

"original_caption": "190952cz Pandora热带棕榈叶戒指",

"url": "https://theartofpandora.com/wp-content/uploads/2016/10/190952CZ-1-600x600.jpg"

}

ALLaVA-Instruct-VFLAN-4V

{

"id": "allava_vflan_inst_9",

"image": "allava_vflan/images/images_191task_1k/VQA-E+visual_question_answering_574_COCO_train2014_000000119456.jpg",

"conversations": [

{

"from": "human",

"value": "<image>\n你将看到一张图片和一个与图片相关的问题。请根据图片中提供的信息回答问题。\n\n大脚怪在图片中吗?"

},

{

"from": "gpt",

"value": "图片中的生物并非大脚怪(也称为萨斯夸奇)。大脚怪在民间传说和神秘动物学中通常被描述为一种高大、双足行走的类人生物,具有类似猿猴的特征,身高约6到9英尺。而照片中的动物是四足行走的,其身体结构类似于猪,具有长毛和獠牙等野猪的特征。此外,图中没有任何双足行走的生物或类人形象,这些都不符合大脚怪的特征。图片的场景和视觉线索也与大脚怪常见的目击报告不符,后者通常描述其为在树林中站立的孤立身影。因此,根据图片中可见的视觉信息,可以得出结论:大脚怪并未出现在这张图片中。"

}

]

}

Evol-Instruct-GPT4-Turbo-143K

``` { "idx": "heR0vZB", "conversations": [ { "from": "human", "value": "作为一名名叫Aimee的在线平台教师,你拥有无可挑剔的资历,包括康奈尔大学工业和劳动关系学士学位、英语专业知识,以及中等水平的中文和西班牙语能力。此外,你在新加坡联合国妇女署担任STEAM教师的专业经验,磨练了你教导6-11岁儿童和各级学生的技能。你在口语英语和发音方面出色的教学能力,加上你作为一个见多识广、有耐心且富有吸引力的个人优势,使你成为寻求提高英语技能的学生的理想教师。你能否提供一个简短、精炼且独特的英文自我介绍,以要点形式呈现,吸引学生报名参加你的课程?" }, { "from": "gpt", "value": "当然,以下是你的英文自我介绍要点:\n\n- 你好!我是Aimee,很高兴成为你的在线英语教师!\n- 凭借康奈尔大学的学士学位和在新加坡联合国妇女署教授STEAM的经验,我知道如何帮助学生有效学习。\n- 我对语言充满热情,并具有中等水平的中文和西班牙语能力,所以我理解学习新语言的挑战。\n- 在我的课堂上,我专注于提高口语英语和发音,同时培养词汇和语法技能。\n- 但学习英语不必枯燥!我是一位富有吸引力和耐心的教师,喜欢让学习变得有趣和愉快。\n- 所以,无论你是初学者还是高级学生,我相信我都能帮助你提高英语技能并实现目标。让我们开始吧!" } ] } ```我们的模型ALLaVA-Phi3-mini-128k、ALLaVA-StableLM2-1_6B和ALLaVA-Phi2-2_7B在17项基准测试中取得了具有竞争力的结果。

| 模型 | Vicuna-80 | GQA | HallusionBench | MME-P | MMVP | TouchStone | TextVQA | MME-C | MathVista | MM-Vet | MMMU-val | SQA (图像) | LLaVA (实际应用) | MLLM-Bench | MMB-en | MMB-cn | SEEDBench (图像, v1) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 大型视觉语言模型 | |||||||||||||||||

| BLIP-2 | - | - | - | - | - | - | - | - | - | 22.4 | 34.4 | - | - | 3.0* | - | - | 49.7 |

| InstructBLIP | - | 49.5 | - | - | - | - | - | - | - | 25.6 | - | - | 58.2 | - | 44.0 | - | - |

| Qwen-VL-Chat | - | 57.5 | - | 1487.6 | - | - | 61.5 | 360.7 | - | 31.1 | - | 68.2 | - | - | 60.6 | 56.7 | 65.4 |

| LLaVA-1.5-7B | 13.8* | 62.0 | 36.6* | 1504.4* | 24.7* | 594.9* | 58.2 | 324.6* | 25.0* | 31.1 | 35.1* | 66.8 | 65.4 | 23.0* | 64.3 | 58.3 | 66.1 |

| LLaVA-1.5-13B | 22.5 | 63.3 | 36.5* | 1531.3 | 38.0* | 617.7* | 61.3 | 295.4 | 28.3* | 35.4 | 34.4* | 71.6 | 72.5 | - | 67.7 | 63.6 | 68.2 |

| LVIS-7B | - | 62.6 | - | - | - | - | 58.7 | - | - | 31.5 | - | - | 67.0 | 29.0* | 66.2 | - | - |

| LVIS-13B | - | 63.6* | - | - | - | - | 62.5* | - | - | 37.4* | - | - | 71.3* | - | 68.0* | - | - |

| ShareGPT4V-7B | 13.8* | 63.3 | 36.0* | 1540.1* | 34.0* | 637.2* | 60.4 | 346.1* | 24.7* | 37.6 | 35.4* | 68.4* | 72.6 | 30.2* | 68.8 | 61.0* | 69.7 |

| ShareGPT4V-13B | 17.5* | 64.8 | 39.0* | 1576.1* | 35.3* | 648.7* | 62.2 | 309.3* | 28.8* | 43.1 | 35.6* | 70.0* | 79.9 | 35.5* | 71.2 | 61.7* | 70.8 |

| 4B规模轻量级视觉语言模型 | |||||||||||||||||

| MobileVLM-v2 | 5.0* | 61.1 | 30.8* | 1440.5 | 18.7* | 541.0* | 57.5 | 261.8* | 28.3* | 26.1* | 30.8* | 70.0 | 53.2* | 15.7* | 63.2 | 43.2* | 64.5* |

| Mipha-3B | 16.2* | 63.9 | 34.3* | 1488.9 | 32.0* | 619.0* | 56.6 | 285.0* | 27.8* | 33.5* | 35.8* | 70.9 | 64.7* | 23.1* | 69.7 | 42.9* | 71.2* |

| TinyLLaVA | 15.6* | 62.1 | 37.2* | 1465.5* | 33.3* | 663.5* | 60.3 | 281.1* | 30.3* | 37.5 | 38.4 | 73.0 | 70.8* | 29.8* | 69.7* | 42.8* | 70.4* |

| 我们的模型 | |||||||||||||||||

| ALLaVA-Phi2 | 49.4 | 48.8 | 24.8 | 1316.2 | 36.0 | 632.0 | 49.5 | 301.8 | 27.4 | 32.2 | 35.3 | 67.6 | 69.4 | 43.6 | 64.0 | 40.8 | 65.2 |

| ALLaVA-StableLM2 | 38.8 | 49.8 | 25.3 | 1311.7 | 34.0 | 655.2 | 51.7 | 257.9 | 27.7 | 31.7 | 33.3 | 64.7 | 72.0 | 39.3 | 64.6 | 49.8 | 65.7 |

| ALLaVA-Phi3 | 56.9 | 52.2 | 48.1 | 1382.3 | 32.7 | 667.8 | 53.0 | 347.1 | 32.9 | 37.8 | 41.1 | 64.0 | 68.5 | 54.8 | 68.1 | 55.3 | 69.0 |

* 表示我们评估的结果。粗体数字是所有4B规模轻量级视觉语言模型中的最佳结果。每个基准测试的详细信息请参见我们技术报告中的表4。

🏭 推理

所有模型都可以使用.from_pretrained()方法从HuggingFace加载。

查看示例脚本以获取样本输入和输出。

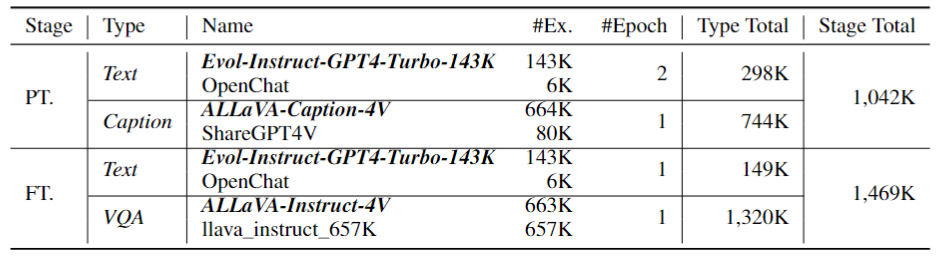

🏋️♂️ 训练

数据

ALLaVA 分别使用 100 万和 150 万数据进行预训练和微调。

代码

训练代码主要基于 LLaVA。 我们衷心感谢他们为开源大语言视觉模型做出的宝贵贡献。

超参数

| 全局批次大小 | ZeRO 阶段 | 优化器 | 最大学习率 | 最小学习率 | 调度器 | 权重衰减 |

|---|---|---|---|---|---|---|

| 256 (预训练) / 128 (微调) | 1 | AdamW | 2e-5 | 2e-6 | CosineAnnealingWarmRestarts | 0 |

语言模型主干和投影器是可训练的,而视觉编码器保持冻结。 两个阶段中每个模块的可训练性都是相同的。

🙌 贡献者

项目负责人: Guiming Hardy Chen

数据: Shunian Chen, Junying Chen, Xiangbo Wu

评估: Ruifei Zhang

部署: Xiangbo Wu, Zhiyi Zhang

指导: Zhihong Chen, Benyou Wang

其他: Jianquan Li, Xiang Wan

📝 引用

如果您发现我们的数据有用,请考虑引用我们的工作!我们是来自深圳市大数据研究院和香港中文大学(深圳)的 FreedomIntelligence

@misc{chen2024allava,

title={ALLaVA: Harnessing GPT4V-synthesized Data for A Lite Vision-Language Model},

author={Guiming Hardy Chen and Shunian Chen and Ruifei Zhang and Junying Chen and Xiangbo Wu and Zhiyi Zhang and Zhihong Chen and Jianquan Li and Xiang Wan and Benyou Wang},

year={2024},

eprint={2402.11684},

archivePrefix={arXiv},

primaryClass={cs.CL}

}