:books: 论文 | :hugs: HuggingFace 合集 |

:speech_balloon: 讨论页面

冰川代码模型简介

我们推出了一系列仅解码器的冰川代码模型,用于代码生成任务(如修复bug、解释代码、记录代码),这些模型接受由116种编程语言编写的代码进行训练。对冰川代码模型家族进行全面评估,显示我们的模型在各种任务中都能达到公开源码大语言模型中的最先进水平。

冰川代码模型的主要优势包括:

- 全能型代码大语言模型:冰川代码模型在不同类型的代码相关任务中都达到了具有竞争力或最先进的性能,包括代码生成、解释、修复、编辑、翻译等,展现了其解决多样化编码任务的能力。

- 可靠的企业级大语言模型:我们所有的模型都是在遵循IBM的人工智能伦理原则并由IBM的法务团队指导的许可数据上进行训练的,以确保可信的企业级使用。我们以Apache 2.0许可证发布所有冰川代码模型,供研究和商业使用。

冰川代码模型家族有两个主要变体:

- 冰川代码基础模型:针对代码相关任务(如代码修复、代码解释、代码合成)设计的基础模型。

- 冰川代码指令模型:使用Git提交与人工指令,以及开源合成代码指令数据集进行微调的指令跟随模型。

基础模型和指令模型均有3B、8B、20B和34B参数规模可选。

数据收集

我们准备代码预训练数据的过程包括几个阶段。首先,我们收集公开可用的数据集(如GitHub Code Clean、Starcoder数据)、公共代码仓库和GitHub问题。其次,我们根据文件扩展名过滤出对应编程语言的代码数据。然后,我们还会过滤掉低质量的代码。第三,我们采用极端的去重策略,包括精确和模糊去重,以删除具有(近)相同代码内容的文档。最后,我们应用HAP内容过滤器,降低模型生成仇恨、辱骂或粗俗语言的可能性。我们还确保通过用相应的令牌(如⟨NAME⟩、⟨EMAIL⟩、⟨KEY⟩、⟨PASSWORD⟩)替换个人身份信息(PII)(如姓名、电子邮箱、密钥、密码)来编辑PII内容。我们还使用ClamAV扫描所有数据集,以识别和删除源代码中的恶意软件。除了收集用于模型训练的代码数据,我们还整理了几个公开可用的高质量自然语言数据集,以提高模型在语言理解和数学推理方面的能力。

预训练

冰川代码基础模型在300亿至400亿个标记的代码数据和与代码相关的自然语言数据集上进行训练。数据采用字节对编码(BPE)进行标记,使用与StarCoder相同的标记器。我们使用高质量数据分两个阶段进行训练:

- 第1阶段(仅代码训练):在第1阶段,3B和8B模型在包含116种语言的4万亿个代码标记的数据上进行训练。20B参数模型在3万亿个标记的代码上进行训练。34B模型在1.4万亿个标记的数据上进行训练,这是在1.6万亿个标记的20B模型检查点的基础上进行深度扩展得到的。

- 第2阶段(代码+语言训练):在第2阶段,我们增加了来自技术、数学和网络文档等各个领域的高质量公开数据,以进一步提高模型的性能。我们在第2阶段训练所有模型50万亿个标记(代码80%,语言20%)。

指令微调

冰川代码指令模型在以下类型的指令数据上进行微调:1) 从CommitPackFT获取的代码提交;2) 高质量数学数据集,具体使用了MathInstruct和MetaMathQA;3) 代码指令数据集,如Glaive-Code-Assistant-v3、Self-OSS-Instruct-SC2、Glaive-Function-Calling-v2、NL2SQL11和一小部分合成API调用数据集;4) 高质量的语言指令数据集,如HelpSteer和经过许可过滤的Platypus开源版本。

评估结果

我们对我们的代码模型进行了广泛的评估,涵盖了包括但不限于HumanEvalPack、MBPP和MBPP+在内的各种基准测试。这些基准测试涵盖了多种编程语言(如Python、JavaScript、Java、Go、C++、Rust)中的不同编码任务。

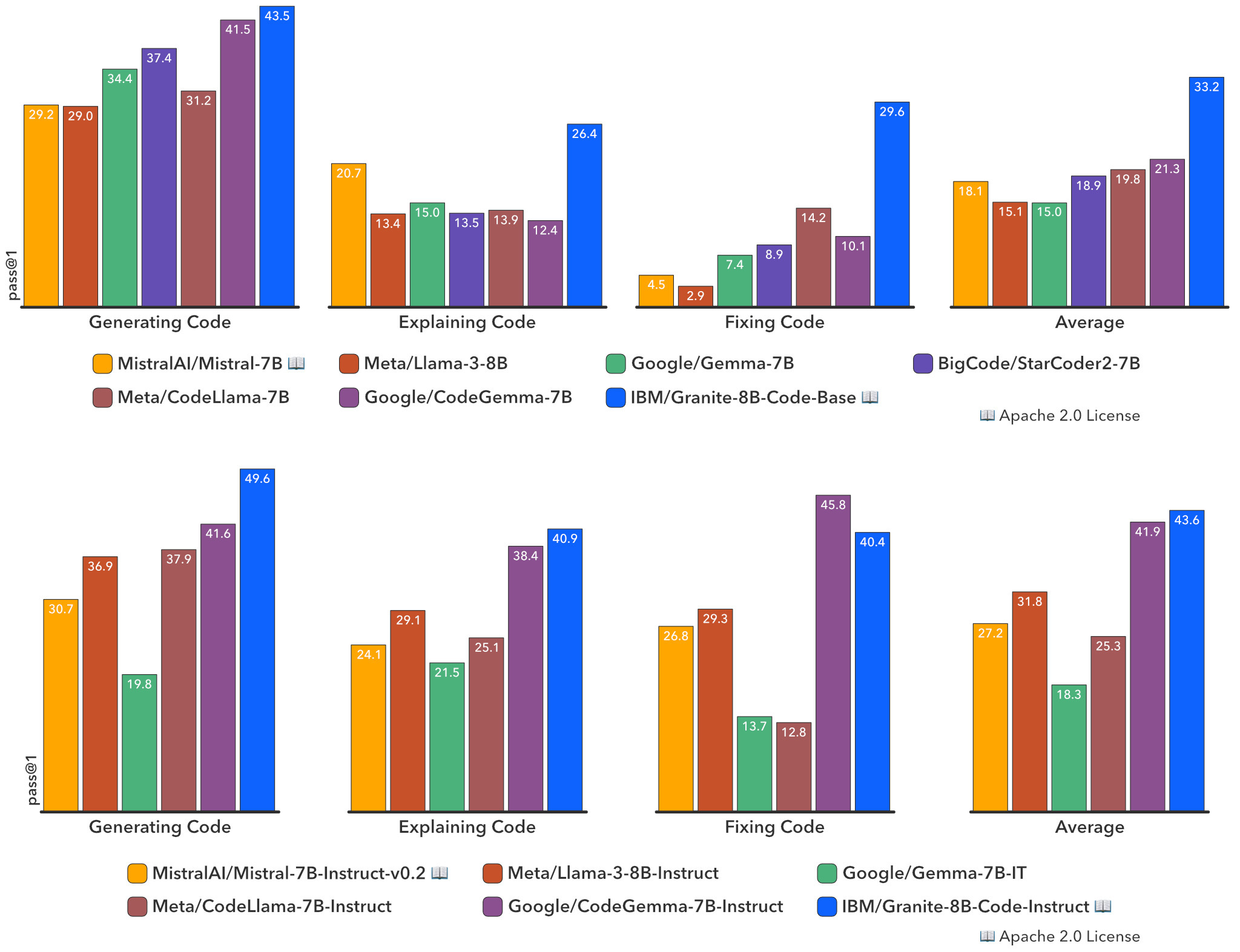

我们的研究发现,Granite Code模型在各种模型大小上都优于强大的开源模型。下图说明了Granite-8B-Code-Base在三个编码任务中如何优于Mistral-7B、LLama-3-8B和其他开源模型。我们在论文中提供了进一步的评估结果。

如何使用我们的模型?

要使用任何我们的模型,请从以下列表中选择合适的model_path:

ibm-granite/granite-3b-code-baseibm-granite/granite-3b-code-instructibm-granite/granite-8b-code-baseibm-granite/granite-8b-code-instructibm-granite/granite-20b-code-baseibm-granite/granite-20b-code-instructibm-granite/granite-34b-code-baseibm-granite/granite-34b-code-instruct

推理

from transformers import AutoModelForCausalLM, AutoTokenizer

device = "cuda" # 或 "cpu"

model_path = "ibm-granite/granite-3b-code-base" # 从上述列表中选择

tokenizer = AutoTokenizer.from_pretrained(model_path)

# 如果在CPU上运行,请删除device_map

model = AutoModelForCausalLM.from_pretrained(model_path, device_map=device)

model.eval()

# 根据需要更改输入文本

input_text = "def generate():"

# 将文本令牌化

input_tokens = tokenizer(input_text, return_tensors="pt")

# 将令牌化输入转移到设备

for i in input_tokens:

input_tokens[i] = input_tokens[i].to(device)

# 生成输出令牌

output = model.generate(**input_tokens)

# 将输出令牌解码为文本

output = tokenizer.batch_decode(output)

# 循环遍历批次以打印,在本例中批次大小为1

for i in output:

print(i)

微调

我们使用Dolomite Engine进行所有模型的微调(或指令调优)。我们为微调ibm-granite/granite-3b-code-base提供了示例脚本。要微调模型,只需遵循这些步骤:

git clone https://github.com/ibm-granite/dolomite-engine/

cd dolomite-engine

# 您可能需要修改configs/granite-example/training.yml

sh scripts/finetune.sh configs/granite-example/training.yml

# 一旦模型训练完成,转换为HuggingFace兼容的safetensors

sh scripts/export.sh configs/granite-example/export.yml

[!TIP] 如果您想使用不需要填充的transformer来节省内存占用和训练期间的FLOPS,请按照Dolomite Engine README中的说明进行更多详细信息。

如何为该项目贡献?

模型卡

每个模型变体的模型卡都可在其各自的HuggingFace存储库中获得。请访问我们的集合。

如何下载我们的模型?

所选择的模型(在本例中为granite-3b-code-base)可以使用以下命令克隆:

git clone https://huggingface.co/ibm-granite/granite-3b-code-base

许可证

所有Granite Code模型都采用Apache 2.0许可证发布。

您是否想提供反馈?

请在访问我们的集合时告诉我们您对我们的代码模型系列的意见。选择您想提供反馈的模型存储库。然后,转到社区选项卡,点击新建讨论。或者,您也可以在我们的GitHub讨论页面上发布任何问题/意见。