简体中文 | English

自托管AI

本项目的API接口兼容openai,使用openai的各种开源项目可以轻松适配。此外,我还呼吁大家以类似方式开发兼容的API接口,有助于相关应用的发展。

前往release下载打包文件

使用update.bat进行更新(不包括模型)

定义ngrok_token环境变量以将API暴露到互联网上

使用示例

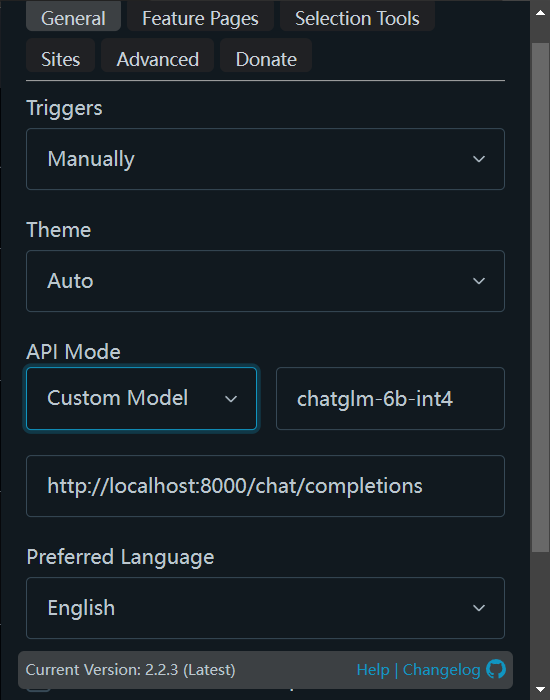

前往https://github.com/josStorer/chatGPTBox,并切换到以下API模式以快速体验:

聊天

-

- 8MB在线安装程序

- 查看更多在RWKV-Runner

-

- 离线

- 此包基于 ChatGLM,开源于 Apache-2.0 许可。内置模型是 https://huggingface.co/silver/chatglm-6b-int4-slim 的精简版。

- 解压后,双击对应的模型文件运行。例如,

llama.bat运行 llama 模型,或chatglm.bat运行 chatglm 模型。

- 自托管

- 点击上面的链接前往 Huggingface,复制 space,切换 CPU 为第二个8核以快速体验,此时API地址为

[你的名字]-[仓库名字].hf.space,例如,如果我复制并设置名称为test,那么我的URL将是https://josstorer-test.hf.space/chat/completions

- 点击上面的链接前往 Huggingface,复制 space,切换 CPU 为第二个8核以快速体验,此时API地址为

- 与 ChatGPTBox 一起使用时,模型名称需要设置为

chatglm-6b-int4

- 离线

-

- 离线

- 此包基于 llama.cpp。内置命令行交互程序是我修改的版本,支持Windows上的 unicode 输入,内置模型来自Chinese-LLaMA-Alpaca

- 在 WSL 或 Linux 环境中运行

get_llama_model.sh获取模型。如果你已经有模型,直接替换models/llama.cpp/ggml-model-q4_0.bin文件。 - 解压后,双击对应的模型文件运行。例如,

llama.bat运行 llama 模型,或chatglm.bat运行 chatglm 模型。

- 与 ChatGPTBox 一起使用时,模型名称需要设置为

llama-7b-int4

- 离线

画图

- stable-diffusion-webui

- 此项目自带一键安装程序,下载链接:https://github.com/AUTOMATIC1111/stable-diffusion-webui/releases/download/v1.0.0-pre/sd.webui.zip

- 其他系统的安装步骤:https://github.com/AUTOMATIC1111/stable-diffusion-webui#installation-and-running

- 对于 Windows,下载并解压上面的安装程序后,双击

update.bat,然后运行run.bat。此后,你可以直接运行run.bat进行后续启动(需要至少一个模型下载以正常启动)。 - 你可以在https://civitai.com/找到要使用的模型并下载它。将模型放置在

webui\models\Stable-diffusion目录中,将 VAE 模型放置在webui\models\VAE目录中。 - 接下来,打开浏览器并访问

http://127.0.0.1:7860/。 - 你可能需要在

设置 -> 稳定扩散 -> SD VAE中设置下载的 VAE。

集成应用

-

- 此项目自带一些一键安装程序,下载链接:https://github.com/oobabooga/text-generation-webui#one-click-installers。只需选择与系统对应的 zip 文件并下载。