RouteLLM

RouteLLM是一个用于服务和评估LLM路由器的框架。

我们的核心功能包括:

- 可直接替换OpenAI的客户端(或启动一个兼容OpenAI的服务器),将简单的查询路由到更便宜的模型。

- 提供开箱即用的经过训练的路由器,我们已证明这可以将成本降低高达85%,同时在广泛使用的基准测试(如MT Bench)上保持95%的GPT-4性能。

- 基准测试还表明,这些路由器达到了与商业产品相同的性能,同时成本降低超过40%。

- 轻松扩展框架以包含新的路由器,并比较多个基准测试中路由器的性能。

安装

从PyPI安装

pip install "routellm[serve,eval]"

从源代码安装

git clone https://github.com/lm-sys/RouteLLM.git

cd RouteLLM

pip install -e .[serve,eval]

快速入门

让我们来看看如何替换现有的OpenAI客户端,以在LLM之间路由查询,而不是仅使用单一模型。

- 首先,让我们用

mf路由器初始化RouteLLM控制器来替换我们的OpenAI客户端。默认情况下,RouteLLM将使用性能最佳的配置:

import os

from routellm.controller import Controller

os.environ["OPENAI_API_KEY"] = "sk-XXXXXX"

# 替换为您的模型提供商,这里我们使用Anyscale的Mixtral

os.environ["ANYSCALE_API_KEY"] = "esecret_XXXXXX"

client = Controller(

routers=["mf"],

strong_model="gpt-4-1106-preview",

weak_model="anyscale/mistralai/Mixtral-8x7B-Instruct-v0.1",

)

上面,我们选择gpt-4-1106-preview作为强模型,anyscale/mistralai/Mixtral-8x7B-Instruct-v0.1作为弱模型,并相应地设置API密钥。您可以通过更新模型名称来在不同的模型对或提供商之间进行路由,如模型支持中所述。

想要路由到本地模型?请查看路由到本地模型。

- 每个路由请求都有一个成本阈值,用于控制成本和质量之间的权衡。我们应该根据收到的查询类型来校准这个阈值,以最大化路由性能。例如,让我们使用Chatbot Arena的数据来校准我们的阈值,使50%的查询调用GPT-4。

> python -m routellm.calibrate_threshold --routers mf --strong-model-pct 0.5 --config config.example.yaml

对于mf的50.0%强模型调用,阈值 = 0.11593

这意味着我们应该使用0.11593作为阈值,这样大约50%的查询(那些最需要GPT-4的查询)将被路由到它(详见阈值校准)。

- 现在,让我们在生成补全时更新

model字段,以指定要使用的路由器和阈值:

response = client.chat.completions.create(

# 这告诉RouteLLM使用MF路由器,成本阈值为0.11593

model="router-mf-0.11593",

messages=[

{"role": "user", "content": "你好!"}

]

)

就是这样!现在,请求将根据需求在强模型和弱模型之间路由,在保持高质量响应的同时节省成本。

根据您的用例,您可能需要考虑使用不同的模型对、修改配置或基于收到的查询类型校准阈值以提高性能。

服务器和演示

除了使用Python SDK,您还可以启动一个兼容OpenAI的服务器,该服务器可与任何现有的OpenAI客户端配合使用,步骤类似:

> export OPENAI_API_KEY=sk-XXXXXX

> export ANYSCALE_API_KEY=esecret_XXXXXX

> python -m routellm.openai_server --routers mf --strong-model gpt-4-1106-preview --weak-model anyscale/mistralai/Mixtral-8x7B-Instruct-v0.1

INFO: 应用程序启动完成。

INFO: Uvicorn运行在 http://0.0.0.0:6060 (按CTRL+C退出)

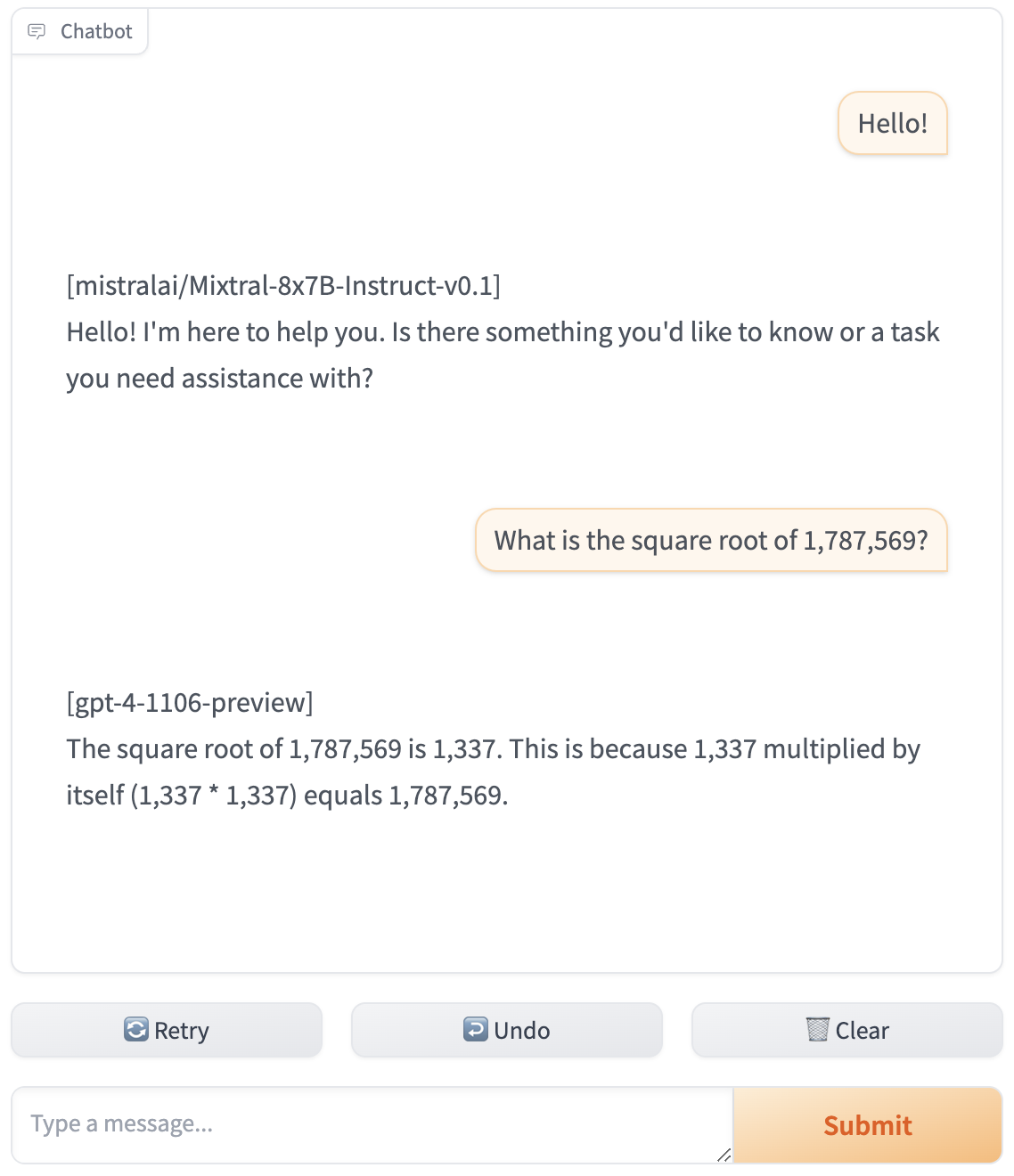

服务器启动后,您可以启动一个本地路由器聊天机器人,看看不同的消息是如何被路由的。

python -m examples.router_chat --router mf --threshold 0.11593

模型支持

在上面的例子中,GPT-4和Mixtral 8x7B被用作模型对,但您可以使用strong-model和weak-model参数来修改这一点。

我们利用LiteLLM来支持来自广泛的开源和闭源模型的聊天补全。通常,您需要设置API密钥并使用适当的模型名称指向提供商。或者,您也可以通过在模型名称前加上openai/前缀并设置--base-url和--api-key标志来使用任何兼容OpenAI的端点。

请注意,无论使用哪种模型对,目前仍需要OPENAI_API_KEY来为mf和sw_ranking路由器生成嵌入。

为热门提供商设置API密钥的说明:

- 使用Ollama的本地模型:请参阅此指南

- Anthropic

- Gemini - Google AI Studio

- Amazon Bedrock

- Together AI

- Anyscale Endpoints

对于其他模型提供商,请在这里查找说明或提出问题。

动机

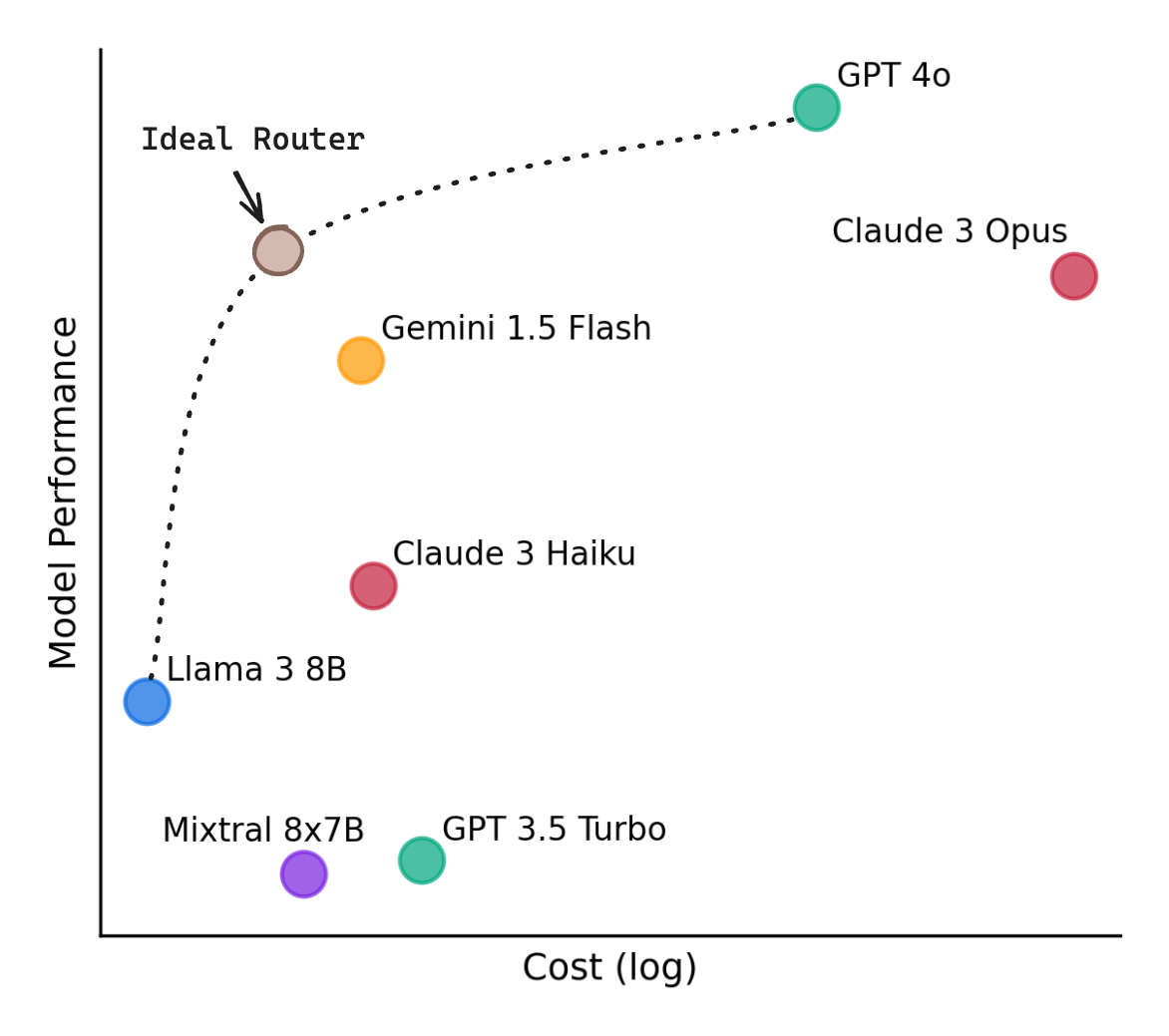

不同的LLM在成本和能力方面差异很大,这导致在部署它们时面临一个困境:将所有查询路由到最有能力的模型会导致最高质量的响应,但可能非常昂贵,而将查询路由到较小的模型可以节省成本,但可能导致较低质量的响应。

LLM路由为此提供了一个解决方案。我们引入了一个路由器,它会查看查询并将简单的查询路由到较小、较便宜的模型,从而在保持质量的同时节省成本。我们专注于在2个模型之间进行路由:一个更强大、更昂贵的模型和一个更便宜但更弱的模型。每个请求还与一个成本阈值相关联,该阈值决定了该请求的成本质量权衡 - 更高的成本阈值会导致更低的成本,但可能会导致质量较低的响应。

本仓库中的研究是与Anyscale合作进行的,我们对他们的帮助和支持表示感谢。

服务器

RouteLLM提供了一个轻量级的兼容OpenAI的服务器,用于基于不同路由策略路由请求:

python -m routellm.openai_server --routers mf --config config.example.yaml

--routers指定服务器可用的路由器列表。例如,这里服务器启动时有一个可用的路由器:mf(参见下面的路由器列表)。--config指定路由器的配置文件路径。如果未指定,服务器将默认使用我们性能最佳的配置(详见配置)。

对于大多数用例,我们推荐使用mf路由器,因为我们已评估它非常强大且轻量。

向服务器发出请求时,客户端使用model字段以以下格式指定每个请求使用的路由器和成本阈值:router-[路由器名称]-[阈值]。例如,使用model为router-mf-0.5指定请求应使用mf路由器,阈值为0.5。

阈值校准

用于路由的阈值控制成本和质量之间的权衡。有意义的阈值范围因路由器类型和您收到的查询而异。因此,我们建议使用您收到的查询样本以及您希望路由到更强模型的查询百分比来校准阈值。

默认情况下,我们支持基于公开的Chatbot Arena数据集校准阈值。例如,要为mf路由器校准阈值,使50%的调用路由到更强的模型:

> python -m routellm.calibrate_threshold --task calibrate --routers mf --strong-model-pct 0.5 --config config.example.yaml

对于mf的50.0%强模型调用,阈值 = 0.11593

这意味着应将mf路由器的阈值设置为0.1159,以使大约50%的调用路由到强模型,即使用model字段为router-mf-0.1159。

然而,请注意,由于我们基于现有数据集校准阈值,路由到每个模型的调用百分比将根据实际收到的查询而有所不同。因此,我们建议在与您收到的查询类型相似的数据集上进行校准。

评估

RouteLLM还包括一个评估框架,用于衡量不同路由策略在基准测试上的性能。

要在基准测试上评估路由器,您可以使用以下命令:

python -m routellm.evals.evaluate --routers random sw_ranking bert --benchmark gsm8k --config config.example.yaml

--routers指定要评估的路由器列表,例如,在这种情况下为random和bert。--benchmark指定用于评估路由器的具体基准测试。我们目前支持:mmlu、gsm8k和mt-bench。

评估结果将打印到控制台。路由器性能的图表也会在当前目录生成(可使用 --output 覆盖路径)。为避免重复计算结果,默认情况下会缓存特定基准测试上路由器的结果。可以使用 --overwrite-cache 标志来覆盖此行为,该标志接受要覆盖缓存的路由器列表。

我们所有基准测试的结果都已被缓存。对于 MT Bench,我们使用所需模型对的预计算判断。对于 MMLU 和 GSM8K,我们利用 SGLang 计算所需模型对的结果 - 如果您想评估不同的模型对,可以在基准测试目录中找到完整代码。

默认情况下,使用 GPT-4 和 Mixtral 作为评估的模型对。要修改使用的模型对,请使用 --strong-model 和 --weak-model 标志进行设置。

路由器

RouteLLM 开箱即用地支持 4 种在 gpt-4-1106-preview 和 mixtral-8x7b-instruct-v0.1 模型对上训练的路由器。

完整的路由器列表:

mf:使用在偏好数据上训练的矩阵分解模型(推荐)。sw_ranking:使用加权 Elo 计算进行路由,每个投票根据其与用户提示的相似度进行加权。bert:使用在偏好数据上训练的 BERT 分类器。causal_llm:使用在偏好数据上微调的基于 LLM 的分类器。random:随机路由到任一模型。

虽然这些路由器是在 gpt-4-1106-preview 和 mixtral-8x7b-instruct-v0.1 模型对上训练的,但我们发现这些路由器对其他强弱模型对也有很好的泛化能力。因此,您可以替换用于路由的模型对,而无需重新训练这些模型!

我们还在以下笔记本中提供了有关如何训练基于 LLM 的分类器的详细说明。

有关完整详情,请参阅我们的论文。

配置

路由器的配置在 Controller 的 config 参数中指定,或通过使用 --config 标志传入 YAML 文件的路径。它是从路由器名称到用于路由器初始化的关键字参数的顶级映射。

config.example.yaml 文件中提供了一个示例配置 - 它提供了使用 GPT-4 作为评判来增强 Arena 数据训练的路由器的配置。所使用的模型和数据集都托管在 Hugging Face 上的 RouteLLM 和 LMSYS 组织下。

贡献

我们欢迎贡献!如果您有任何建议或改进,请随时开启问题或提交拉取请求。

添加新路由器

要向 RouteLLM 添加新路由器,请在 routers.py 中实现抽象 Router 类,并将新路由器添加到 ROUTER_CLS 字典中。然后,您可以立即在服务器或评估框架中使用新路由器。

只需实现一个方法:calculate_strong_win_rate,它接收用户提示并返回强模型在给定提示条件下的胜率 - 如果此胜率大于用户指定的成本阈值,则请求将路由到强模型。否则,将路由到弱模型。

添加新基准测试

要向 RouteLLM 添加新基准测试,请在 benchmarks.py 中实现抽象 Benchmark 类,并更新 evaluate.py 模块以正确初始化新的基准测试类。理想情况下,应预先计算基准测试的结果,以避免每次评估运行时都重新生成结果 -- 请参见现有基准测试以了解如何执行此操作的示例。

引用

本仓库中的代码基于论文的研究。如果您发现该仓库有帮助,请引用。

@misc{ong2024routellmlearningroutellms,

title={RouteLLM: Learning to Route LLMs with Preference Data},

author={Isaac Ong and Amjad Almahairi and Vincent Wu and Wei-Lin Chiang and Tianhao Wu and Joseph E. Gonzalez and M Waleed Kadous and Ion Stoica},

year={2024},

eprint={2406.18665},

archivePrefix={arXiv},

primaryClass={cs.LG},

url={https://arxiv.org/abs/2406.18665},

}

Github

Github Huggingface

Huggingface 论文

论文