WhisperX

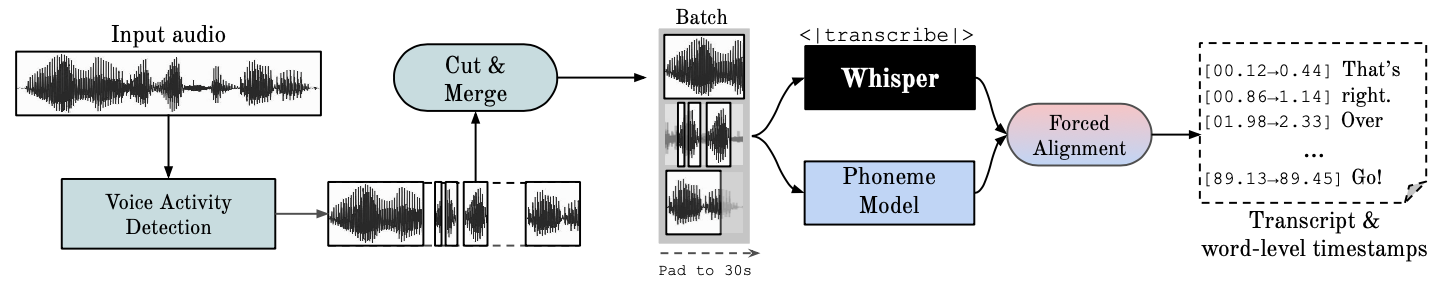

该存储库提供快速的自动语音识别(使用large-v2模型可达到实时速度的70倍),并支持单词级时间戳和说话人分离。

- ⚡️ 批处理推理,使用whisper large-v2模型可达到实时速度的70倍

- 🪶 使用faster-whisper后端,large-v2模型的beam_size=5时仅需<8GB GPU内存

- 🎯 使用wav2vec2对齐技术实现精确的单词级时间戳

- 👯♂️ 使用pyannote-audio的说话人分离技术实现多说话人ASR(说话人ID标签)

- 🗣️ VAD预处理,减少幻听并实现批处理,不影响WER

Whisper是由OpenAI开发的ASR模型,在大规模多样化音频数据集上进行训练。虽然它能产生高度准确的转录结果,但对应的时间戳是在句子级别,而非单词级别,可能会有几秒钟的误差。OpenAI的whisper原生不支持批处理。

基于音素的ASR是一套经过微调的模型,用于识别区分词语的最小语音单位,例如"tap"中的p音素。一个流行的示例模型是wav2vec2.0。

强制对齐指的是将正字法转录与音频记录对齐的过程,以自动生成音素级别的分段。

**语音活动检测(VAD)**是检测人类语音是否存在的过程。

说话人分离是将包含人类语音的音频流按每个说话人的身份分割成同质段的过程。

新特性🚨

- 在Ego4d转录挑战赛中获得第一名 🏆

- _WhisperX_被INTERSPEECH 2023接收

- v3版本每句话一个转录段:使用nltk sent_tokenize实现更好的字幕效果和更好的说话人分离

- v3版本发布,开源70倍加速。使用faster-whisper后端实现批处理whisper!

- v2版本发布,代码清理,导入whisper库,默认开启VAD过滤,与论文一致。

- 论文发布🎓👨🏫!请查看我们的ArxiV预印本了解WhisperX的基准测试和详细信息。我们还介绍了更高效的批处理推理,使large-v2模型达到*实时速度的60-70倍。

设置 ⚙️

已在PyTorch 2.0和Python 3.10上测试(使用其他版本风险自负!)GPU执行需要系统安装NVIDIA库cuBLAS 11.x和cuDNN 8.x。请参考CTranslate2文档。

1. 创建Python3.10环境

conda create --name whisperx python=3.10

conda activate whisperx

2. 安装PyTorch,例如Linux和Windows CUDA11.8:

conda install pytorch==2.0.0 torchaudio==2.0.0 pytorch-cuda=11.8 -c pytorch -c nvidia

查看其他方法请点击此处。

3. 安装此存储库

pip install git+https://github.com/m-bain/whisperx.git

如果已安装,请更新包到最新提交

pip install git+https://github.com/m-bain/whisperx.git --upgrade

如果希望修改此包,请克隆并以可编辑模式安装:

$ git clone https://github.com/m-bain/whisperX.git

$ cd whisperX

$ pip install -e .

你可能还需要安装ffmpeg、rust等。请按照openAI的说明进行操作:https://github.com/openai/whisper#setup。

说话人分离

要启用说话人分离,请在--hf_token参数后包含你的Hugging Face访问令牌(读取权限),你可以从这里生成,并接受以下模型的用户协议:分割和说话人分离-3.1(如果你选择使用说话人分离2.x,请按照此处的要求操作。)

注意

截至2023年10月11日,whisperX中使用pyannote/Speaker-Diarization-3.0存在已知的性能问题。这是由于faster-whisper和pyannote-audio 3.0.0之间的依赖冲突造成的。请查看此问题了解更多详情和可能的解决方法。

使用方法 💬(命令行)

英语

在示例片段上运行whisper(使用默认参数,whisper small模型)添加--highlight_words True以在.srt文件中可视化单词时间。

whisperx examples/sample01.wav

使用WhisperX强制对齐wav2vec2.0 large的结果:

与原始whisper的开箱即用结果相比,许多转录内容不同步:

为了提高时间戳准确性,以更高的GPU内存为代价,使用更大的模型(更大的对齐模型并不一定有帮助,参见论文),例如:

whisperx examples/sample01.wav --model large-v2 --align_model WAV2VEC2_ASR_LARGE_LV60K_960H --batch_size 4

为转录添加说话人ID标签(如果知道说话人数量,可以设置--min_speakers 2 --max_speakers 2):

whisperx examples/sample01.wav --model large-v2 --diarize --highlight_words True

在CPU而不是GPU上运行(也适用于Mac OS X):

whisperx examples/sample01.wav --compute_type int8

其他语言

音素ASR对齐模型是特定语言的,对于经过测试的语言,这些模型会自动从torchaudio管道或huggingface中选择。

只需传入--language代码,并使用whisper的--model large。

目前提供了{en, fr, de, es, it, ja, zh, nl, uk, pt}的默认模型。如果检测到的语言不在此列表中,你需要从huggingface模型中心找到一个基于音素的ASR模型并在你的数据上进行测试。

例如:德语

whisperx --model large-v2 --language de examples/sample_de_01.wav

查看此处的更多其他语言示例。

Python使用方法 🐍

import whisperx

import gc

device = "cuda"

audio_file = "audio.mp3"

batch_size = 16 # 如果GPU内存不足,请降低

compute_type = "float16" # 如果GPU内存不足,改为"int8"(可能降低准确性)

# 1. 使用原始whisper进行转录(批处理)

model = whisperx.load_model("large-v2", device, compute_type=compute_type)

# 将模型保存到本地路径(可选)

# model_dir = "/path/"

# model = whisperx.load_model("large-v2", device, compute_type=compute_type, download_root=model_dir)

audio = whisperx.load_audio(audio_file)

result = model.transcribe(audio, batch_size=batch_size)

print(result["segments"]) # 对齐前

# 如果GPU资源不足,删除模型

# import gc; gc.collect(); torch.cuda.empty_cache(); del model

# 2. 对齐whisper输出

model_a, metadata = whisperx.load_align_model(language_code=result["language"], device=device)

result = whisperx.align(result["segments"], model_a, metadata, audio, device, return_char_alignments=False)

print(result["segments"]) # 对齐后

# 如果GPU资源不足,删除模型

# import gc; gc.collect(); torch.cuda.empty_cache(); del model_a

# 3. 分配说话人标签

diarize_model = whisperx.DiarizationPipeline(use_auth_token=YOUR_HF_TOKEN, device=device)

# 如果已知,添加最小/最大说话人数量

diarize_segments = diarize_model(audio)

# diarize_model(audio, min_speakers=min_speakers, max_speakers=max_speakers)

result = whisperx.assign_word_speakers(diarize_segments, result)

print(diarize_segments)

print(result["segments"]) # 段落现在已分配说话人ID

演示 🚀

如果您无法使用自己的GPU,请使用上面的链接试用WhisperX。

技术细节 👷♂️

关于批处理和对齐的具体细节、VAD的影响以及选择的对齐模型,请参阅预印本论文。

为减少GPU内存需求,可尝试以下方法(2和3可能会影响质量):

- 减小批处理大小,例如

--batch_size 4 - 使用较小的ASR模型

--model base - 使用较轻的计算类型

--compute_type int8

与OpenAI的Whisper的转录差异:

- 无时间戳转录。为启用单次批处理,Whisper推理执行时使用

--without_timestamps True,确保批处理中每个样本只进行一次前向传递。但这可能导致与默认Whisper输出的差异。 - 基于VAD的分段转录,不同于OpenAI的缓冲转录。在WhisperX论文中,我们展示了这种方法可以降低WER,并实现准确的批处理推理。

--condition_on_prev_text默认设置为False(减少幻觉)

限制 ⚠️

- 不包含对齐模型词典中字符的转录词(如"2014."或"£13.60")无法对齐,因此不会给出时间。

- Whisper和WhisperX对重叠语音的处理都不是很好。

- 说话人分离效果远非完美。

- 需要特定语言的wav2vec2模型。

贡献 🧑🏫

如果您精通多种语言,可以通过在Hugging Face上寻找音素模型(或训练自己的模型)并在目标语言的语音上测试它们来为这个项目做出重大贡献。如果结果看起来不错,请发送拉取请求并提供一些展示其成功的示例。

为保持这个项目的发展,我们也非常感谢发现错误和提交拉取请求,因为它已经偏离了最初的研究范围。

待办事项 🗓

-

多语言初始化

-

基于语言检测的自动对齐模型选择

-

Python使用

-

整合说话人分离

-

模型刷新,适用于低GPU内存资源

-

Faster-whisper后端

-

添加最大行数等(参见OpenAI的whisper utils.py)

-

句子级别分段(nltk工具箱)

-

改进对齐逻辑

-

更新示例,包含说话人分离和单词高亮

-

字幕.ass输出 <- 恢复这个功能(在v3中被移除)

-

添加基准测试代码(TEDLIUM用于速度/WER和单词分割)

-

允许使用silero-vad作为替代VAD选项

-

改进说话人分离(词级别)。比最初想象的更难...

联系/支持 📇

如有疑问,请联系maxhbain@gmail.com。

致谢 🙏

这项工作和我的博士研究得到了VGG(视觉几何组)和牛津大学的支持。

当然,这是基于OpenAI的Whisper构建的。 借鉴了PyTorch强制对齐教程中的重要对齐代码。 并使用了出色的pyannote VAD / 说话人分离 https://github.com/pyannote/pyannote-audio

来自pyannote audio的宝贵VAD和说话人分离模型

来自faster-whisper和CTranslate2的优秀后端

在经济上支持这项工作的人们 🙏

最后,感谢这个项目的开源贡献者,他们保持项目的发展并识别错误。

引用

如果您在研究中使用了这个项目,请引用以下论文:@article{bain2022whisperx,

title={WhisperX: Time-Accurate Speech Transcription of Long-Form Audio},

author={Bain, Max and Huh, Jaesung and Han, Tengda and Zisserman, Andrew},

journal={INTERSPEECH 2023},

year={2023}

}

Github

Github Huggingface

Huggingface 文档

文档 论文

论文