Transformer Lab

在本地下载、交互和微调模型。

查看文档 »

观看演示

·

报告错误

·

提出建议

·

加入Discord

·

关注Twitter

注意:Transformer Lab正在积极开发中。请加入我们的Discord或关注我们的Twitter以获取更新。我们非常重视您的问题、反馈和贡献!

立即下载

关于项目

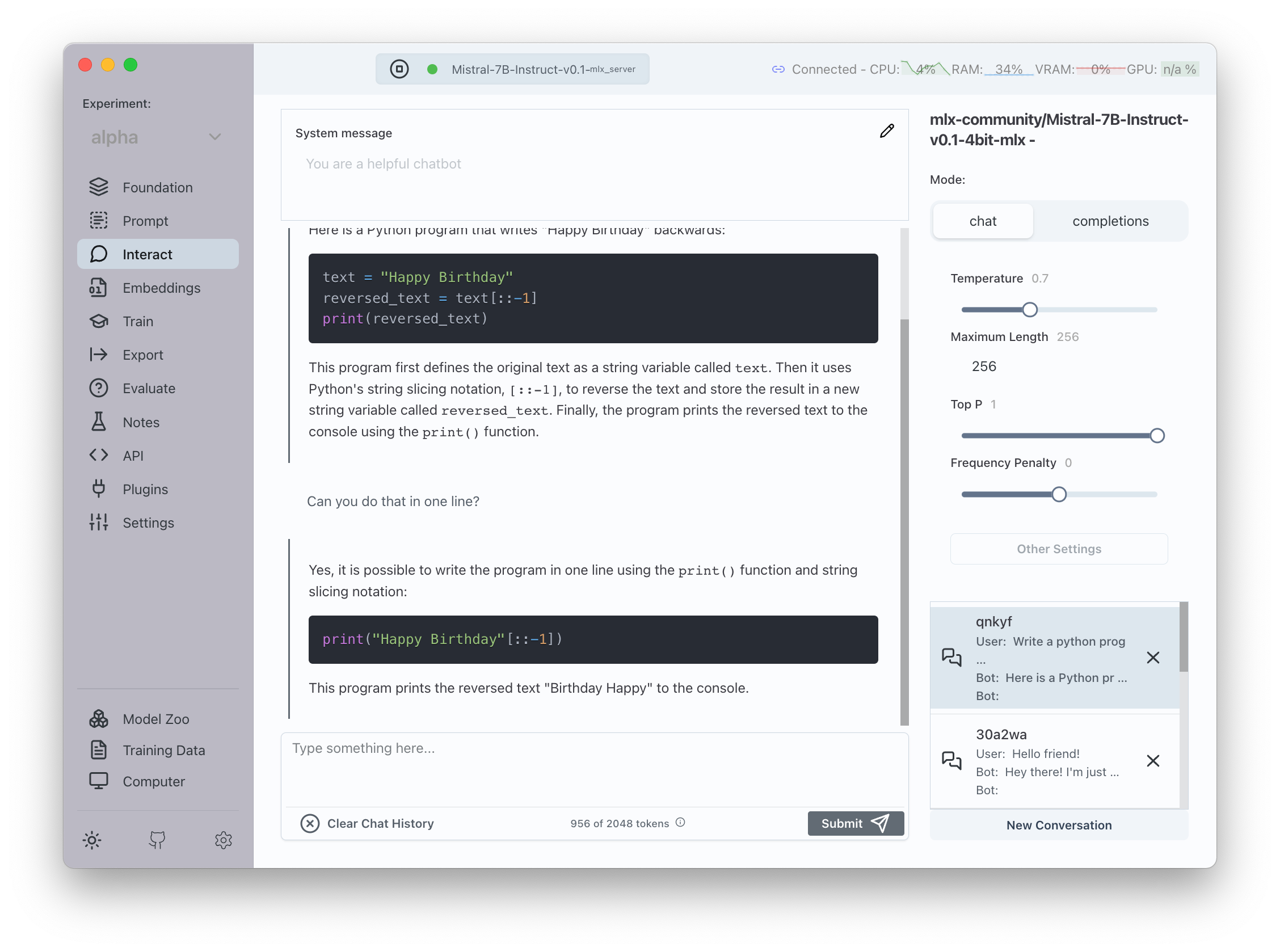

Transformer Lab是一款允许任何人实验大型语言模型的应用程序。

Transformer Lab允许您:

- 💕 一键下载数百个流行模型:

- Llama3、Phi3、Mistral、Mixtral、Gemma、Command-R等数十种模型

- ⬇ 从Huggingface下载任何LLM

- 🎶 在不同硬件上微调/训练

- 在Apple Silicon上使用MLX进行微调

- 在GPU上使用Huggingface进行微调

- ⚖️ RLHF和偏好优化

- DPO

- ORPO

- SIMPO

- 奖励建模

- 💻 跨操作系统使用LLM:

- Windows应用

- MacOS应用

- Linux

- 💬 与模型对话

- 聊天

- 补全

- 预设(模板)提示

- 聊天历史

- 调整生成参数

- 🚂 使用不同的推理引擎

- Apple Silicon上的MLX

- Huggingface Transformers

- vLLM

- Llama CPP

- 🧑🎓 评估模型

- 📖 RAG(检索增强生成)

- 拖放文件界面

- 适用于Apple MLX、Transformers和其他引擎

- 📓 构建训练数据集

- 从HuggingFace上的数百个常用数据集中提取

- 通过拖放提供您自己的数据集

- 🔢 计算嵌入

- 💁 完整的REST API

- 🌩 在云端运行

- 您可以在桌面/笔记本电脑上运行用户界面,而引擎在远程或云机器上运行

- 或者您可以在单台机器上本地运行所有内容

- 🔀 跨平台转换模型

- 在Huggingface、MLX、GGUF之间转换

- 🔌 插件支持

- 轻松从现有插件库中获取

- 编写您自己的插件以扩展功能

- 🧑💻 嵌入式Monaco代码编辑器

- 编辑插件并查看幕后发生的情况

- 📝 提示编辑

- 轻松编辑系统消息或提示模板

- 📜 推理日志

- 在进行推理或RAG时,查看发送给LLM的原始查询日志

您可以通过简单的跨平台GUI完成以上所有操作。

入门

点击此处下载Transformer Lab。

阅读此页面以了解如何安装和使用。

使用的技术

开发者

从头开始构建

要自行构建应用程序,请拉取此仓库,并按照以下步骤操作:

npm install

npm start

打包生产版本

为本地平台打包应用程序:

npm run package

许可证

根据AGPL V3许可证分发。有关更多信息,请参阅LICENSE.txt。

引用

如果您在研究或应用中发现Transformer Lab有用,请使用以下BibTeX引用:

@software{transformerlab,

author = {Asaria, Ali},

title = {Transformer Lab: 实验大型语言模型},

month = December,

year = 2023,

url = {https://github.com/transformerlab/transformerlab-app}

}

联系方式

- @aliasaria - Ali Asasria

- @dadmobile - Tony Salomone

访问官网

访问官网 Github

Github Huggingface

Huggingface 文档

文档