robosuite

最新更新

-

[2022/11/15] v1.4:后端迁移到DeepMind官方的MuJoCo Python绑定,机器人纹理,以及错误修复 :robot: [发布说明] [文档]

-

[2021/10/19] v1.3:光线追踪和基于物理的渲染工具 :sparkles: 以及访问额外的视觉模态 🎥 [视频亮点] [发布说明] [文档]

-

[2021/02/17] v1.2:添加了可观察的传感器模型 :eyes: 和动力学随机化 :game_die: [发布说明]

-

[2020/12/17] v1.1:重构基础设施并标准化模型类,使环境原型设计更加容易 :wrench: [发布说明]

robosuite是一个由MuJoCo物理引擎驱动的机器人学习仿真框架。它还提供了一套用于可复现研究的基准环境。当前版本(v1.4)提供长期支持,使用DeepMind的官方MuJoCo绑定。该项目是通过仿真环境推进机器人智能(ARISE)倡议的一部分,旨在降低人工智能和机器人学交叉领域前沿研究的入门门槛。

数据驱动算法,如强化学习和模仿学习,为机器人学提供了强大而通用的工具。这些学习范式,在深度学习新进展的推动下,在各种机器人控制问题中取得了一些令人兴奋的成功。然而,可复现性的挑战和机器人硬件的有限可及性(尤其是在疫情期间)阻碍了研究进展。robosuite的首要目标是为研究人员提供:

- 一套标准化的基准任务,用于严格评估和算法开发;

- 模块化设计,为设计新的机器人仿真环境提供极大的灵活性;

- 高质量实现的机器人控制器和现成的学习算法,以降低入门门槛。

该框架最初由斯坦福视觉与学习实验室(SVL)的研究人员自2017年底开始开发,作为机器人学习研究的内部工具。现在它由SVL和德克萨斯大学机器人感知与学习实验室(RPL)积极维护和用于机器人学研究项目。我们欢迎社区为这个项目做出贡献。详情请查看我们的贡献指南。

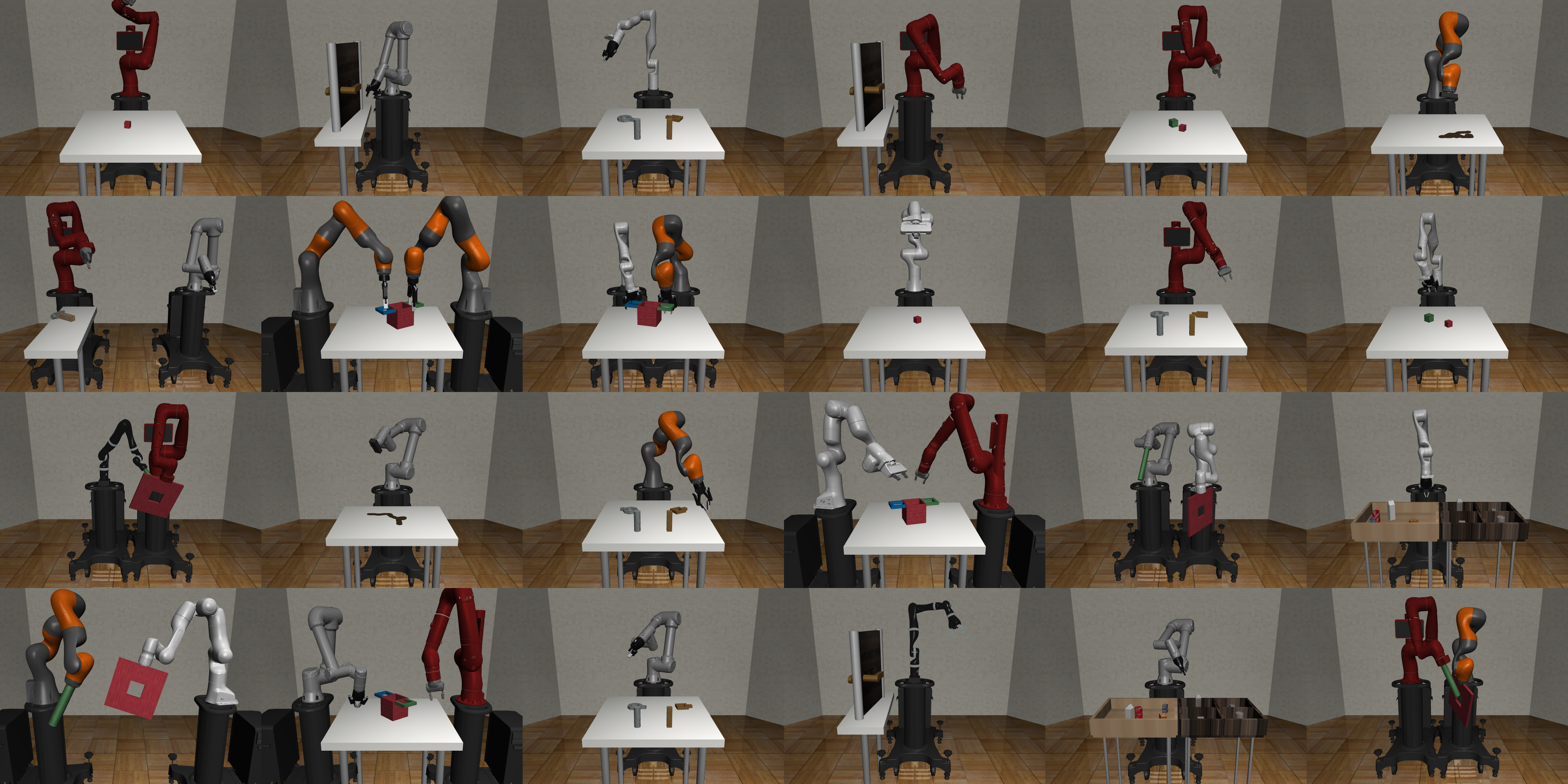

这个版本的robosuite包含七个机器人模型、八个夹持器模型、六种控制器模式和九个标准化任务。它还提供了用于通过程序生成构建新环境的模块化API设计。我们在下面强调这些主要特性:

- 标准化任务:一套多样性大、复杂度不同的标准化操作任务,以及用于可复现研究的强化学习基准结果;

- 程序生成:用于以编程方式创建新环境和新任务的模块化API,可组合机器人模型、场景和参数化3D对象;

- 机器人控制器:多种类型的控制器来命令机器人,如关节空间速度控制、逆运动学控制、操作空间控制,以及用于远程操作的3D运动设备;

- 多模态传感器:异构类型的感知信号,包括低级物理状态、RGB相机、深度图和本体感受;

- 人类示范:用于收集人类示范、重放示范数据集和利用示范数据进行学习的工具。查看我们的姊妹项目robomimic;

- 真实感渲染:与先进图形工具的集成,提供模拟场景的实时真实感渲染。

引用

如果您在发表的作品中使用了这个框架,请引用robosuite:

@inproceedings{robosuite2020,

title={robosuite: A Modular Simulation Framework and Benchmark for Robot Learning},

author={Yuke Zhu and Josiah Wong and Ajay Mandlekar and Roberto Mart\'{i}n-Mart\'{i}n and Abhishek Joshi and Soroush Nasiriany and Yifeng Zhu},

booktitle={arXiv preprint arXiv:2009.12293},

year={2020}

}