StreamingT2V

本仓库是 StreamingT2V 的官方实现。

StreamingT2V:一致、动态且可扩展的长视频文本生成技术

Roberto Henschel*, Levon Khachatryan*, Daniil Hayrapetyan*, Hayk Poghosyan, Vahram Tadevosyan, Zhangyang Wang, Shant Navasardyan, Humphrey Shi

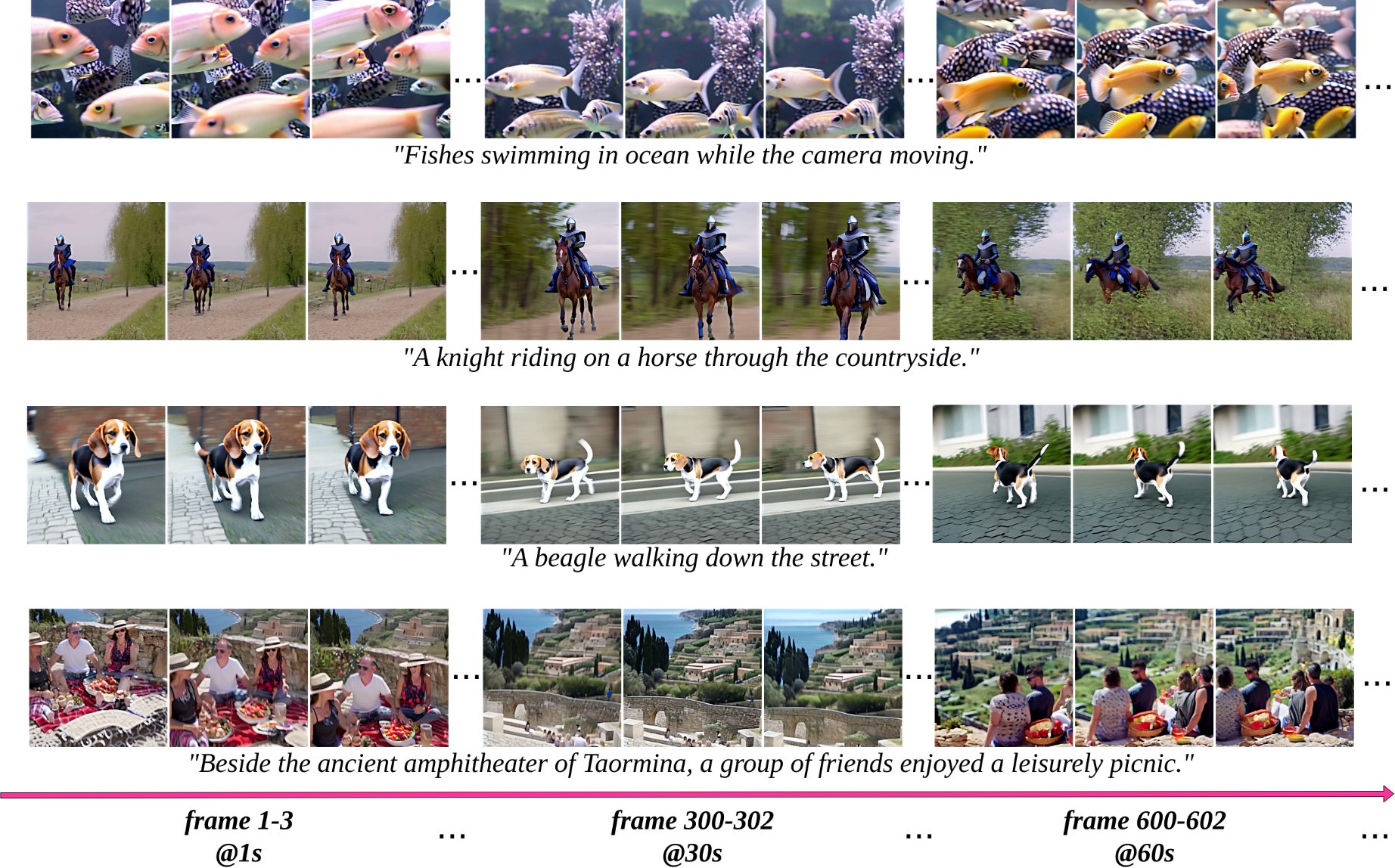

StreamingT2V 是一种先进的自回归技术,能够创建具有丰富运动动态且没有停滞的长视频。它确保了整个视频的时间一致性,与描述性文本紧密对齐,并保持高帧级图像质量。我们的演示包括成功生成长达 1200 帧、时长 2 分钟的视频示例,并可进一步延长。重要的是,StreamingT2V 的有效性不受所使用的特定文本生成视频模型的限制,这表明基础模型的改进可能会产生更高质量的视频。

新闻

- [2024/03/21] StreamingT2V 论文发布!

- [2024/04/05] 代码和模型发布!

- [2024/04/06] 我们的 Hugging Face 演示第一版发布!

设置

- 克隆此仓库并进入:

git clone https://github.com/Picsart-AI-Research/StreamingT2V.git

cd StreamingT2V/

- 使用Python 3.10和CUDA >= 11.6安装依赖项

conda create -n st2v python=3.10

conda activate st2v

pip install -r requirements.txt

- (可选) 如果系统中缺少FFmpeg,请安装

conda install conda-forge::ffmpeg

- 从HF下载权重并将它们放入

t2v_enhanced/checkpoints目录。

推理

文本到视频

cd t2v_enhanced

python inference.py --prompt="一只猫在街上奔跑"

要使用其他基础模型,请添加--base_model=AnimateDiff参数。使用python inference.py --help查看更多选项。

图像到视频

cd t2v_enhanced

python inference.py --image=../__assets__/demo/fish.jpg --base_model=SVD

推理时间

以ModelscopeT2V为基础模型

| 帧数 | 快速预览推理时间 (256x256) | 最终结果推理时间 (720x720) |

|---|---|---|

| 24帧 | 40秒 | 165秒 |

| 56帧 | 75秒 | 360秒 |

| 80帧 | 110秒 | 525秒 |

| 240帧 | 340秒 | 1610秒 (~27分钟) |

| 600帧 | 860秒 | 5128秒 (~85分钟) |

| 1200帧 | 1710秒 (~28分钟) | 10225秒 (~170分钟) |

以AnimateDiff为基础模型

| 帧数 | 快速预览推理时间 (256x256) | 最终结果推理时间 (720x720) |

|---|---|---|

| 24帧 | 50秒 | 180秒 |

| 56帧 | 85秒 | 370秒 |

| 80帧 | 120秒 | 535秒 |

| 240帧 | 350秒 | 1620秒 (~27分钟) |

| 600帧 | 870秒 | 5138秒 (~85分钟) |

| 1200帧 | 1720秒 (~28分钟) | 10235秒 (~170分钟) |

以SVD为基础模型

| 帧数 | 快速预览推理时间 (256x256) | 最终结果推理时间 (720x720) |

|---|---|---|

| 24帧 | 80秒 | 210秒 |

| 56帧 | 115秒 | 400秒 |

| 80帧 | 150秒 | 565秒 |

| 240帧 | 380秒 | 1650秒 (~27分钟) |

| 600帧 | 900秒 | 5168秒 (~86分钟) |

| 1200帧 | 1750秒 (~29分钟) | 10265秒 (~171分钟) |

所有测量均使用NVIDIA A100 (80 GB) GPU进行。当帧数超过80时,采用随机混合。对于随机混合,chunk_size和overlap_size的值分别设为112和32。

Gradio

相同功能也可作为gradio演示使用

cd t2v_enhanced

python gradio_demo.py

结果

详细结果可在项目页面找到。

许可证

我们的代码以CreativeML Open RAIL-M许可证发布。

我们在演示中包含了ModelscopeT2V、AnimateDiff和SVD,用于研究目的并展示StreamingT2V框架包含不同T2V/I2V模型的灵活性。对于这些组件的商业使用,请参考它们的原始许可证。

BibTeX

如果您在研究中使用了我们的工作,请引用我们的出版物:

@article{henschel2024streamingt2v,

title={StreamingT2V: 从文本生成一致、动态和可扩展的长视频},

author={Henschel, Roberto 和 Khachatryan, Levon 和 Hayrapetyan, Daniil 和 Poghosyan, Hayk 和 Tadevosyan, Vahram 和 Wang, Zhangyang 和 Navasardyan, Shant 和 Shi, Humphrey},

journal={arXiv预印本 arXiv:2403.14773},

year={2024}

}

访问官网

访问官网 Github

Github Huggingface

Huggingface 论文

论文