SparseTrack

SparseTrack是一个简单而强大的多目标跟踪器。

刘泽林,王兴刚,王成,刘文予,白翔

新闻

- 为跟踪添加了yolov8检测器,请参考v8分支。

摘要

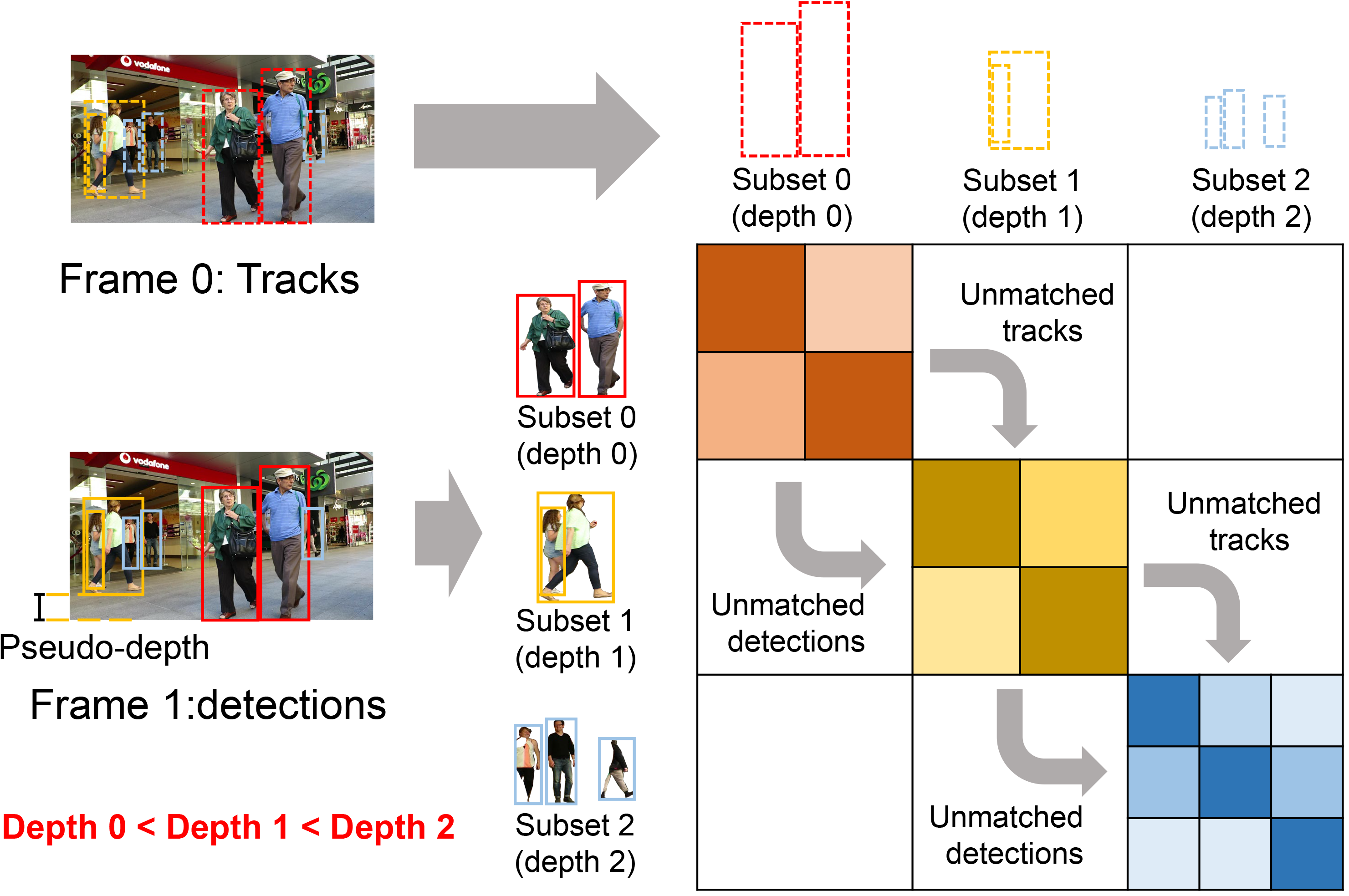

探索稳健高效的关联方法一直是多目标跟踪(MOT)中的重要问题。尽管现有的跟踪方法已经取得了令人印象深刻的性能,但拥挤和频繁遮挡仍然对多目标跟踪构成了挑战性问题。我们揭示,对密集场景进行稀疏分解是提高遮挡目标关联性能的关键步骤。为此,我们提出了一种伪深度估计方法,用于从2D图像中获取目标的相对深度。其次,我们设计了一种深度级联匹配(DCM)算法,该算法可以利用获得的深度信息将密集目标集转换为多个稀疏目标子集,并按从近到远的顺序对这些稀疏目标子集进行数据关联。通过将伪深度方法和DCM策略整合到数据关联过程中,我们提出了一种新的跟踪器,称为SparseTrack。SparseTrack为解决具有挑战性的拥挤场景MOT问题提供了一个新的视角。仅使用IoU匹配,SparseTrack在MOT17和MOT20基准测试上达到了与最先进(SOTA)方法相当的性能。

跟踪性能

MOT挑战赛测试集结果

| 数据集 | HOTA | MOTA | IDF1 | MT | ML | FP | FN | IDs |

|---|---|---|---|---|---|---|---|---|

| MOT17 | 65.1 | 81.0 | 80.1 | 54.6% | 14.3% | 23904 | 81927 | 1170 |

| MOT20 | 63.4 | 78.2 | 77.3 | 69.9% | 9.2% | 25108 | 86720 | 1116 |

DanceTrack测试集对比

| 方法 | HOTA | DetA | AssA | MOTA | IDF1 |

|---|---|---|---|---|---|

| SparseTrack | 55.5 (+7.8) | 78.9 (+7.9) | 39.1 (+7.0) | 91.3 (+1.7) | 58.3 (+4.4) |

| ByteTrack | 47.7 | 71.0 | 32.1 | 89.6 | 53.9 |

注意:

- 所有推理实验都在1块NVIDIA GeForce RTX 3090 GPU上进行。

- 每个实验使用与ByteTrack相同的检测器和模型权重。

- SparseTrack仅依赖IoU距离关联,不使用任何外观嵌入、可学习运动和注意力组件。

安装

依赖

本项目是Detectron2的实现版本,需要编译OpenCV和Boost。

编译GMC(全局运动补偿)模块

步骤1:下载pbcvt,将python_module.cpp复制到**<pbcvt/src/>**路径。

步骤2:在pbcvt/CMakeLists.txt文件中添加相关的OpenCV模块。具体操作如下:在CMakeLists.txt文件中找到"find_package(OpenCV COMPONENTS REQUIRED)"这一行,将其替换为"find_package(OpenCV COMPONENTS core highgui video videoio videostab REQUIRED)"。

步骤3:在编译pbcvt之前修改Makefile文件中的编译路径。主要修改包括更新以下条目:CMAKE_SOURCE_DIR、CMAKE_BINARY_DIR、cmake_progress_start。

步骤4:编译pbcvt。例如,您可以运行以下脚本:

cmake -DPYTHON_DESIRED_VERSION=3.X -DPYTHON3_INCLUDE_DIR=/home/lzl/miniconda3/envs/d2/include/python3.9 -DPYTHON3_NUMPY_INCLUDE_DIRS=/home/lzl/miniconda3/envs/d2/lib/python3.9/site-packages/numpy -DPYTHON3_LIBRARY=/home/lzl/miniconda3/envs/d2/lib/libpython3.9.so # 然后运行: make

步骤5:请将通过pbcvt编译的"pbcvt.xxxxxx.so"文件复制到**<ROOT/SparseTrack/tracker/>**目录。

安装

git clone https://github.com/hustvl/SparseTrack.git

cd SparseTrack

pip install -r requirements.txt

pip install Cython

pip install cython_bbox

数据准备

下载MOT17、MOT20、CrowdHuman、Cityperson、ETHZ,并将它们放在ROOT/下,结构如下:

ROOT

|

|——————SparseTrack(repo)

| └—————mix

| └——————mix_17/annotations

| └——————mix_20/annotations

| └——————ablation_17/annotations

| └——————ablation_20/annotations

|——————MOT17

| └——————train

| └——————test

└——————crowdhuman

| └——————Crowdhuman_train

| └——————Crowdhuman_val

| └——————annotation_train.odgt

| └——————annotation_val.odgt

└——————MOT20

| └——————train

| └——————test

└——————Citypersons

| └——————images

| └——————labels_with_ids

└——————ETHZ

| └——————eth01

| └——————...

| └——————eth07

└——————dancetrack

└——————train

└——————train_seqmap.txt

└——————test

└——————test_seqmap.txt

└——————val

└——————val_seqmap.txt

然后,您需要将数据集转换为COCO格式并混合不同的训练数据:

cd <ROOT>/SparseTrack

python3 tools/convert_mot17_to_coco.py

python3 tools/convert_mot20_to_coco.py

python3 tools/convert_crowdhuman_to_coco.py

python3 tools/convert_cityperson_to_coco.py

python3 tools/convert_ethz_to_coco.py

python3 tools/convert_dance_to_coco.py

创建不同的训练混合数据:

cd <ROOT>/SparseTrack

# 在CrowdHuman和MOT17半个训练集上训练,在MOT17半个验证集上评估。

python3 tools/mix_data_ablation.py

# 在CrowdHuman和MOT20半个训练集上训练,在MOT20半个验证集上评估。

python3 tools/mix_data_ablation_20.py

# 在MOT17、CrowdHuman、ETHZ、Citypersons上训练,在MOT17训练集上评估。

python3 tools/mix_data_test_mot17.py

# 在MOT20和CrowdHuman上训练,在MOT20训练集上评估。

python3 tools/mix_data_test_mot20.py

模型库

参见ByteTrack.model_zoo。我们使用了在MOT17、MOT20上训练的公开可用的ByteTrack模型库,以及YOLOX目标检测的消融研究模型。

此外,我们在MOT20训练集一半和Crowdhuman上进行了联合训练,并在MOT20验证集一半上进行了评估。模型如下:yolox_x_mot20_ablation

在DanceTrack上训练的模型可以在以下位置获取:谷歌云盘:yolox_x_dancetrack或百度网盘:yolox_x_dancetrack,提取码:sptk

训练

所有训练都在统一的脚本上进行。你需要在register_data.py中更改VAL_JSON和VAL_PATH,然后按如下方式运行:

# 在MOT17、CrowdHuman、ETHZ、Citypersons上训练,在MOT17训练集上评估。

CUDA_VISIBLE_DEVICES=0,1,2,3 python train.py --num-gpus 4 --config-file mot17_train_config.py

# 在MOT20、CrowdHuman上训练,在MOT20训练集上评估。

CUDA_VISIBLE_DEVICES=0,1,2,3 python train.py --num-gpus 4 --config-file mot20_train_config.py

注意: 对于MOT20,你需要将边界框裁剪在图像内。

在data_augment.py的第138-139行,mosaicdetection.py的第118-121行和第213-221行,以及boxes.py的第115-118行添加裁剪操作。

跟踪

所有跟踪实验脚本都按以下方式运行。首先将模型权重放在**<ROOT/SparseTrack/pretrain/>中,并在register_data.py中更改VAL_JSON和VAL_PATH**。

# 在mot17训练集或测试集上跟踪

CUDA_VISIBLE_DEVICES=0 python3 track.py --num-gpus 1 --config-file mot17_track_cfg.py

# 在mot20训练集或测试集上跟踪

CUDA_VISIBLE_DEVICES=0 python3 track.py --num-gpus 1 --config-file mot20_track_cfg.py

# 在mot17验证集一半上跟踪

CUDA_VISIBLE_DEVICES=0 python3 track.py --num-gpus 1 --config-file mot17_ab_track_cfg.py

# 在mot20验证集一半上跟踪

CUDA_VISIBLE_DEVICES=0 python3 track.py --num-gpus 1 --config-file mot20_ab_track_cfg.py

在dancetrack测试集上跟踪

步骤1:请注释掉sparse_tracker.py中的第368-373行,并将低分匹配阶段的阈值从0.3修改为0.35(在sparse_tracker.py的第402行)。

步骤2:运行:

CUDA_VISIBLE_DEVICES=0 python3 track.py --num-gpus 1 --config-file dancetrack_sparse_cfg.py

引用

如果你发现SparseTrack在你的研究或应用中有用,请考虑给我们一个星标🌟并引用它,使用以下BibTeX条目。

@inproceedings{SparseTrack,

title={SparseTrack: Multi-Object Tracking by Performing Scene Decomposition based on Pseudo-Depth},

author={Liu, Zelin and Wang, Xinggang and Wang, Cheng and Liu, Wenyu and Bai, Xiang},

journal={arXiv preprint arXiv:2306.05238},

year={2023}

}

致谢

大部分代码借鉴自YOLOX、FairMOT、ByteTrack、BoT-SORT、Detectron2。 非常感谢他们的出色工作。

Github

Github 论文

论文