[新消息]

-

LeYOLO现已在HuggingFace上发布!您可以直接从HuggingFace模型中心下载LeYOLO权重:

lhollard/leyolo-nano

摘要

论文链接:https://arxiv.org/abs/2406.14239

深度神经网络的计算效率对于目标检测至关重要,特别是当新模型优先考虑速度而非高效计算(FLOP)时。这种演变在某种程度上使嵌入式和移动导向的人工智能目标检测应用落后。在本文中,我们专注于基于FLOP的高效目标检测计算的神经网络架构设计选择,并提出了几项优化措施来提高基于YOLO模型的效率。

首先,我们引入了一种受倒置瓶颈和信息瓶颈原理理论洞察启发的高效骨干网络缩放方法。其次,我们提出了快速金字塔架构网络(FPAN),旨在促进快速多尺度特征共享,同时减少计算资源。最后,我们提出了一种解耦网络中的网络(DNiN)检测头,专为分类和回归任务提供快速而轻量级的计算。

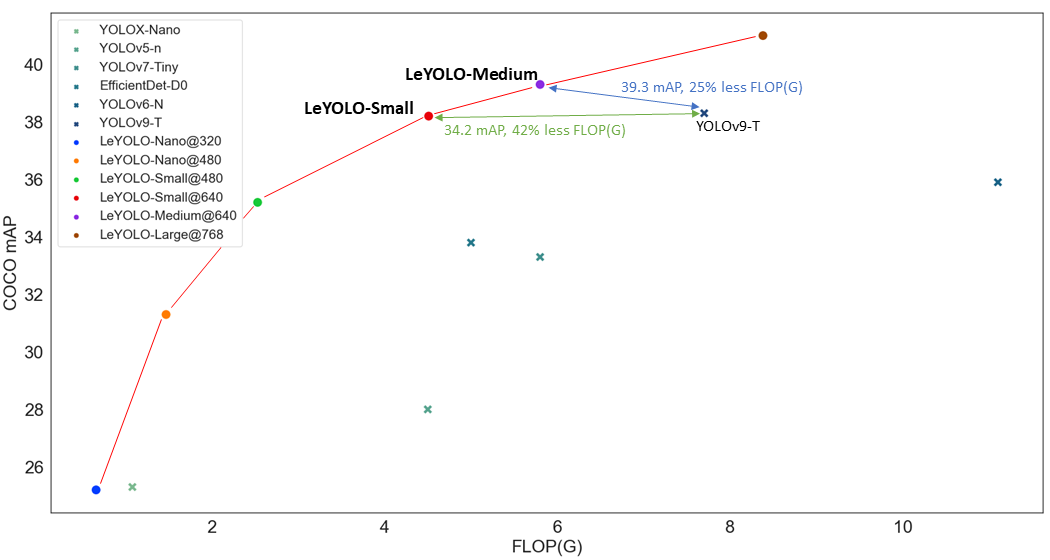

基于这些优化并利用更高效的骨干网络,本文为目标检测和以YOLO为中心的模型提出了一种新的缩放范式,称为LeYOLO。我们的贡献在各种资源约束下始终优于现有模型,实现了前所未有的准确性和FLOP比。值得注意的是,LeYOLO-Small在COCO验证集上实现了38.2%的竞争性mAP分数,仅需4.5 FLOP(G),与最新的最先进YOLOv9-Tiny模型相比,计算负载减少了42%,同时实现了相似的准确性。我们的新型模型系列实现了之前未达到的FLOP与准确性比率,提供了从超低神经网络配置(< 1 GFLOP)到高效但要求严格的目标检测设置(> 4 GFLOPs)的可扩展性,在0.66、1.47、2.53、4.51、5.8和8.4 FLOP(G)下分别实现了25.2、31.3、35.2、38.2、39.3和41 mAP。

LeYOLO结果

LeYOLO系列模型在MSCOCO验证数据集上的结果。 预训练权重可在weights文件夹中找到。

| 模型 | mAP | 图像尺寸 | FLOP (G) |

|---|---|---|---|

| LeYOLONano | 25.2 | 320 | 0.66 |

| LeYOLONano | 31.3 | 480 | 1.47 |

| LeYOLOSmall | 35.2 | 480 | 2.53 |

| LeYOLOSmall | 38.2 | 640 | 4.51 |

| LeYOLOMedium | 39.3 | 640 | 5.80 |

| LeYOLOLarge | 41.0 | 768 | 8.40 |

可重复性

通过使用cfg文件重现LeYOLO结果。 我们没有使用昂贵或花哨的训练方法,只使用了经典和默认的Ultralytics训练配方。 我们使非计算机科学家能够使用简单的训练方法快速重现他们的研究训练!

LeYOLO安装和快速入门

安装

- 警告!可能需要升级pip

python3 -m pip install --upgrade pip

- 进入根文件夹

pip install -e .

快速入门

使用CLI或Python接口来使用LeYOLO / YOLOv8

- 最小示例可以在minimal.ipynb笔记本中找到。

Python

from ultralytics import YOLO

#加载LeYOLO模型

model = YOLO("weights/LeYOLOSmall.pt")

#使用Ultralytics的计算机视觉方法

model.train(data="coco8.yaml", epochs=3)

model.val()

model.export(format="onnx")

特别鸣谢

我们只有在Ultralytics团队自YOLOv5以来的出色工作的基础上才能完成这项工作。LeYOLO完全集成了Ultralytics,他们的支持和文档全面指导了训练、推理、验证和导出机制。

有关更多详细信息,请参阅Ultralytics文档:https://www.ultralytics.com。

联系方式

有任何问题或意见?请联系lilian.hollard@univ-reims.fr

兰斯香槟-阿登大学 - CEA, LRC DIGIT, LICIIS

精确自然科学学院 - Moulin de la Housse校区 BP 1039 - 51687 Reims Cedex 2 - 2/3号楼 - 法国 https://www.univ-reims.fr

Github

Github Huggingface

Huggingface 论文

论文